白:“张三不满意李四没有表扬自己”“张三不满意李四没有批评自己”

这个是情感倾向性决定“自己”共指关系的例子。虽然,default建立得很脆弱。外面有个风吹草动就可能洗牌。比如张三和李四绑死了是一伙儿的 等等语境引入的预设。

“把鸡咬死的虫子扔了” “把鸡咬死的狐狸跑了”

李:好例。

微瑕是,鸡吃虫 论咬吗?虫无骨 没咬劲儿。

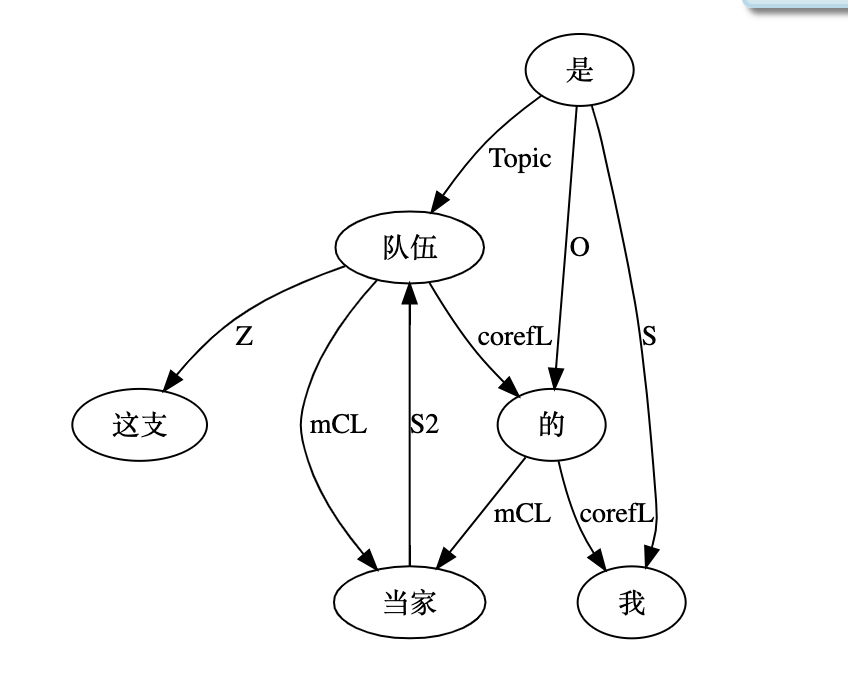

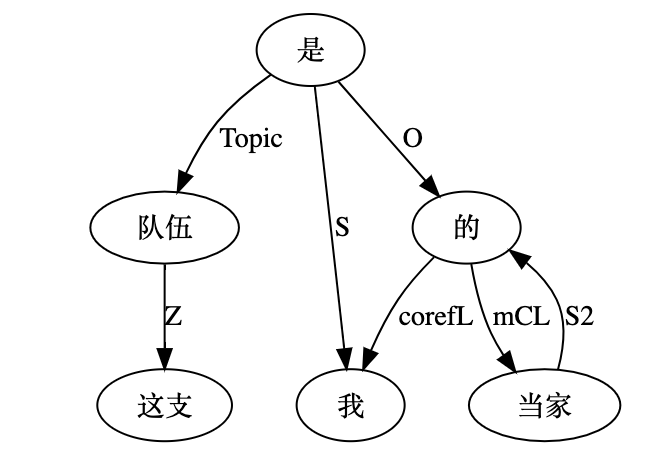

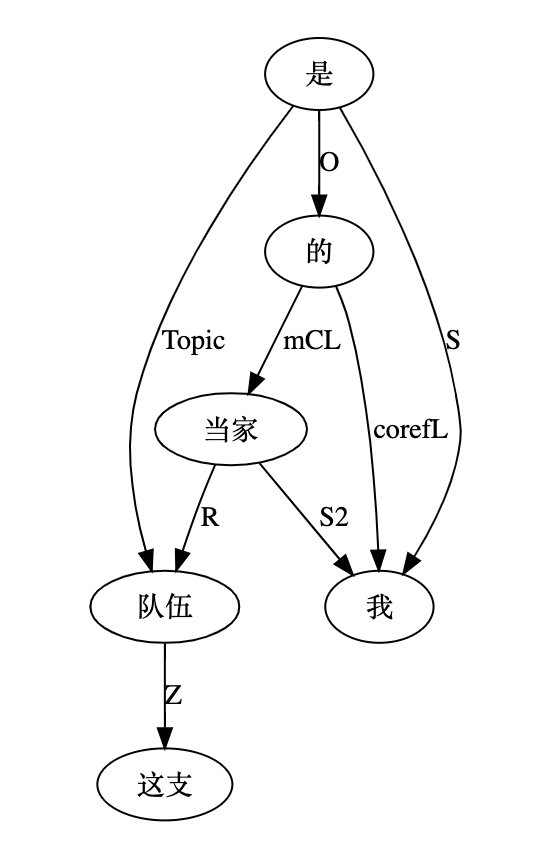

白:“中国北京是首都”当中的“中国”是啥成分?“这支队伍我是当家的”当中“这支队伍”是啥成分?

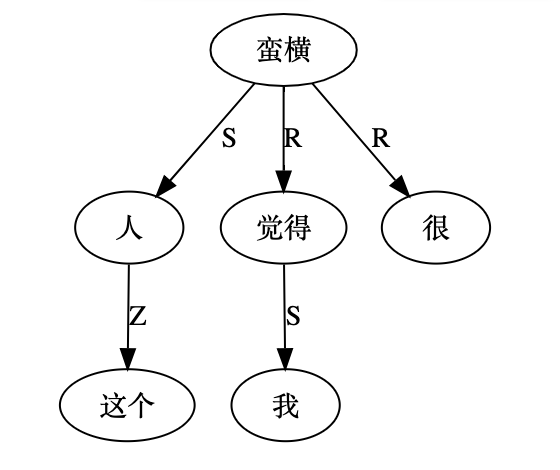

“这个人我感觉很蛮横”“这个人我感觉很舒服”

插入语一旦确立,应该封闭与外部建立hidden links的通道。什么“你知道、我认为、他觉得……”当中的你我他,都不要再花心了,安守本份即可。

李:

"有点乱,有点乱......"

想起周华健的“今天我有点烦 有点烦”。“当家”与“队伍”挂上是对的,可貌似关系颠倒了,这 S2/mCL 肯定是个?,需要 “de- de-” 的。

白:队伍和当家摘开,并不明智。

李:debug 过火了耶。句法负面影响了语义。应该弱化句法。

昨天/前天 说了,这 Topic 如果是人名, 默认就是“呼语”,如果不是人,那就是状语,什么状语?很可能表示 scope(范围)。

把“的字结构”也做过火了,结果 “的” 成了 S2(hidden subject), 反而 “我”没有直接做“当家”的主语,虽然道理上可以通过与 “的” 的 coreference 推导出来。

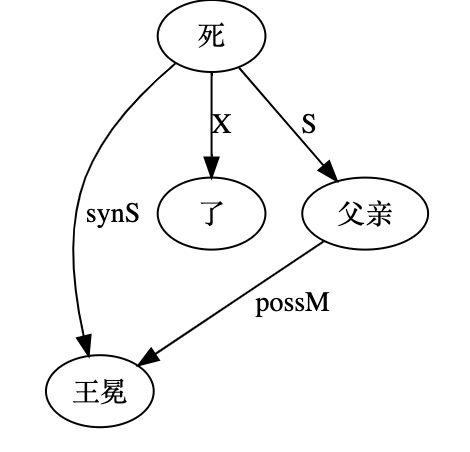

白:王冕死了父亲,王冕也是状语?

李:不是。王冕是句法主语(synS),不是 Topic 降格。

白:“人” 给 “队伍” 当家,这坑都在。“的”不占名额,回指到定语从句里没事的。 空出一个坑留给“队伍”。

李:那个坑感觉不强烈?“当家” 需要一个 范围。可啥东西不要范围?就跟时间 地点似的,啥事儿都发生在时空及其范围之中。

“当家” 词法上是动宾 感觉饱和了,其实不然 它词义是 manage,与其说范围,不如说需要 manage 一个对象。但是词法饱和(“家”已经做了“当”的词法宾语)的残留影响还在,所以这个句法宾语的坑只好退化为范围状语,逻辑语义上其实是【对象】的。

白:不一样。在真正一个家庭里当家,范围是默认的。在一个“拟家庭化”的组织里当家(掌权),这个组织就是需要凸显的范围。这是隐喻固化导致的,跟一般动词的范围不可同日而语。从非标配坑提升到了标配坑,于是就获得了参与句法构建的资格。

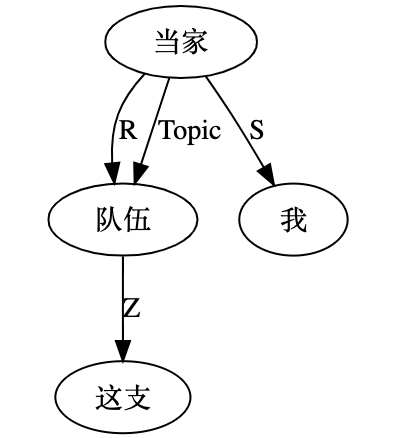

李:成葫芦了:

白:这就靠谱了。还可以画成公鸡?

李:传统 parsing 怎么可能做到这个深度?PennTree 的标注太浅,PSG 的本性也无力表达到这种深度。

群里面专门修过乔姆斯基语言学课程的朋友说说,对于这种语义谓词隐藏较深的,乔姆斯基句法是怎么最终达到他的 logical form 的?还是根本就不管,当不存在?逻辑形式的核心类似一个SVO: <我 - 当家 - 队伍>。

“这支队伍我当家”。

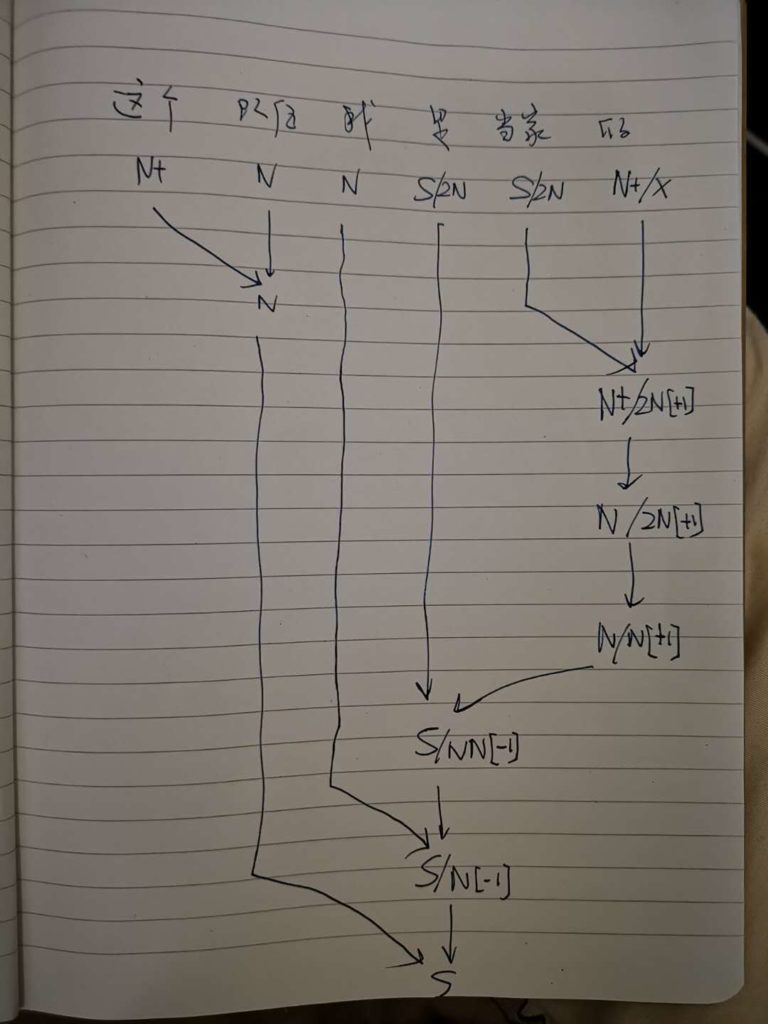

白:这样就可以啊:

李:N[+1] 变成 N[-1] 啊,狸猫换太子的感觉。+1 是左,-1 是右,这个指针运算还蛮溜的。

白:这是把“是”当S+使,把“的”当+S使。偏移量。残坑出自“当家”。辖域合并不交叉,指针还原就交叉了。

李:传统语言学里面的 subcat 没有这么丰富细致,CG 细化过来的,主要是词典功夫。乔老爷好像在 subcat 上没强调细化。

subcat 的范畴细化 还不够,因为范畴细化 不加上语义相谐的支持 仍然导致伪歧义泛滥。在专家词典学派看来,范畴细化+语义相谐 成为一体了,那就要求词典成为知识库,等于是把语言学词典转变为 HowNet 了。HPSG 其实就是在专家词典学派这条道上,想走 没完全走通 就式微了。

白老师是分开了范畴细化与语义相谐。可是展示的 parsing 全部是范畴细化,相谐的工作机理语焉不详。所以 看白老师的 parse 图,结论是,就这些子范畴,运算起来,这路是 “应该” 通的。其他不应该通,但实际上也通了(伪歧义等),就不在雷达上。

白:这是what,不是how。what我希望更多的人理解和支持。how的商业属性就太强了。当然,这是结果,过程中不仅使用了这些。

李:就是。

what 似乎也不齐全,只是展示结构的 what,没有展示结构的功能性(角色)。所以,作为学习,这里有两个空白需填补,一个是 how,尤其是语义相谐机制,怎么招之即来挥之即去的。另一个是逻辑语义,逻辑语义怎么在句法或逻辑的链接基础上得出的。当然这二者是相关的,前者是条件,后者是结论。目前展示的结构树图就是个架子和桥梁。

白:这是一套资源向两个方向的延展。向句法方向就是前者,向语义方向就是后者。而且是句法方向退一步,语义方向进两步。

但是认真地说,本例,真的不需要语义相谐性,纯句法层面就搞定。

李:不是说本例。所以说是 (语义相谐是)招之即来 挥之即去耶。

那个 “专家的” 或 “大数据的” 语义,像个鬼影。说是要做个不是 HowNet 的 HowNet(《知网》),数据驱动的。怎么做?

这与最近NLP主流特火的预训练 也许殊途同归?预训练是个好东西,听上去就是阳光大道。就是不知道今后几年的使用中 会遇到什么坎儿。

白:新一代NowNet,早晚要做。但是不能跟场景两张皮,必须通盘顶层设计。

李:架构上,我看好预训练,关注它的走向。道理也简单 我们一直孜孜以求的就是把语言学和领域先分开,然后再连接,各司其职。预训练就是先分开,而且不用标注语料,这个语言模型等于是在无穷语料上架设。所有的语义相谐和常识理论上都应该在预训练的模型里面(间接)反映了。

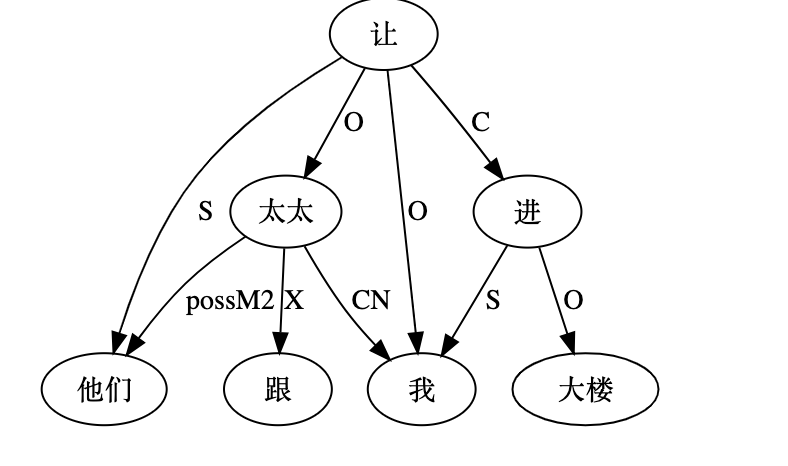

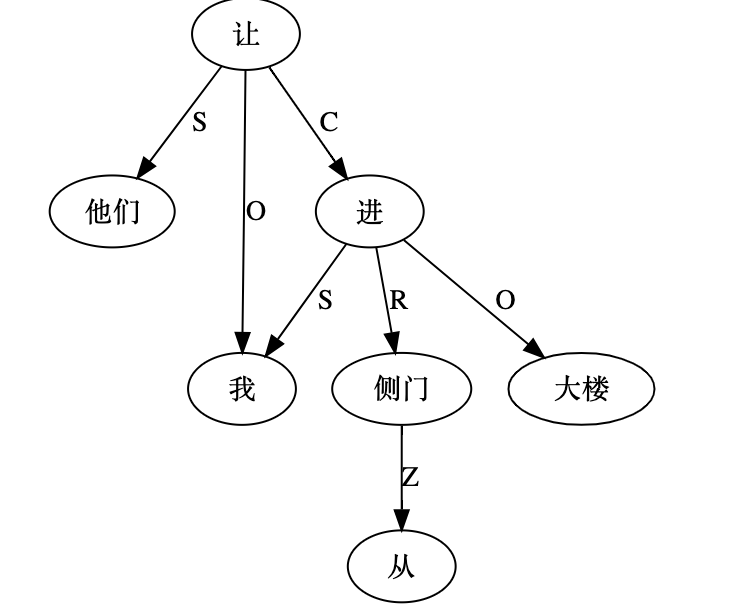

白:“他们让我从侧门进大楼”“他们让我跟太太进大楼”

“侧门”(N/N)的宿主是“大楼”,“太太”(N/N)的宿主是“我”。这要动用本体了。这俩的对比很有意思,纯句法肯定搞不定。

李:

白:侧门和大楼没挂上,侧门的宿主是building。所以building下位一定相谐。大楼小区之类。

李:知道。HowNet 都有,但不好贯彻。

不确定要多大的语义相谐合适。如果大面上说 只要是 part 就与不是 part 的 physical object 相连,那是手到擒来的事儿,怕的是副作用。会不会连得太多,因为 part 和 physical object 都是范围很大的本体概念,概括一大批语词。如果说,细化到 “楼” 与 “门”的本体,就非常相谐,没有顾虑,那就需要一个完整的 hownet 本体知识,可是 我对 hownet 的使用 目前是限制的,不想进入语义泥淖太深。HowNet 董老师自己用 得心应手,其他人用 就颇不易。

白:知识必须是机器可读的。

李:hownet 是机器可读的,或者说 形式化的。

白:机器可读的最好办法就是向一个丰富的技术栈靠拢,否则自己从头建立技术栈,得不偿失。但是董老师对此并不感冒。

李:subcat 以及 sub-subcat 的语义关联,有点组合爆炸的味道。本体自己从细到粗就是一个不小的集合(上千的 vocabulary),本体与本体的相谐 就是组合爆炸。如果组合粗线条 不会爆炸 但失去精准,如果细化 把 HowNet 全部引进,相应的规则集也有个组合爆炸的细化过程,有可能不好管理和维护。总之 现在是控制使用,不想步子迈得太大。

白:还是要区分what和how,what本身无所谓组合爆炸,只有how没做好才组合爆炸。向句法这一端延伸,只用到少量资源。机制必须是轻量级的,重了适得其反。

时代呼唤具有更好场景对接能力和顶层设计理念的新一代“类知网”基础资源。

李:语义常识是一个多大的坑啊,淹死人不偿命啊。谁设计 谁来组织去做?个人还是开源社区?最后 谁用?怎么用?除了设计 白老师可以统率 后面这些问题都还不好回答。

白:要分层,基础层给专业层用,专业层给用户场景用,但是必须统一规划。知网也没搞成开源社区。这东东,不容易协调利益。除非使用区块链。关于知识长什么样如果没有统一的顶层设计,本体和场景一定是两张皮。

【相关】