白:

hownet坑的供给比较充分,但是也很难说一定不会超出上限。(董老师可以试试“这场火多亏消防队来得及时”)

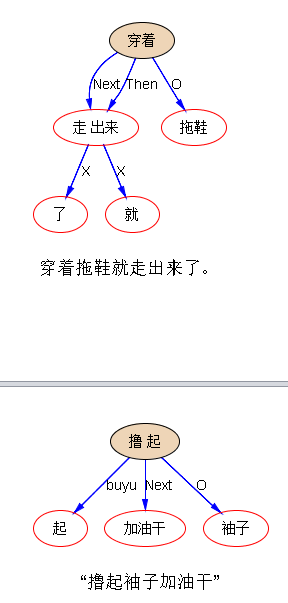

有很多其他类型,比如,“穿着拖鞋就走出来了”。不知道该贴啥标签。还有“撸起袖子加油干”。这两个例子中,在时间上,伴随行为本身在前,伴随行为的遗留状态持续时段包含核心行为持续时段。比如,撸袖子的动作在前,然后遗留状态持续,然后加油干持续,然后加油干结束(或有),然后放下袖子(或有)。

李:

with sentiment:

at least for semantic landing to sentiment, the parse gives decent support。

宋:

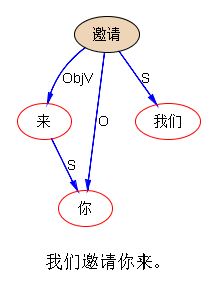

O和ObjV是什么关系?

李:

宾语和宾语补足语

白:

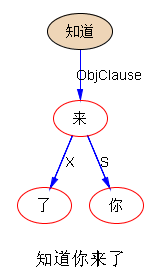

比如:知道你来了。你是O,来了是objV

李:

not really

宋:

@wei 你的论元关系分析,相当炉火纯青了。

李:

宋老师果酱。

白:

这俩的区别?“消防队来得及时”为啥不可以是objClause?

李:

“多亏” 直接 link “消防队”,“知道” 不直接 link “你”,only linking to the event

白:

我是问,是否直接link,准则是什么?有什么必要区分这两者?

李:

语言学家的多数有共识。词典subcats 印象也是区分的,落地时候也发现有益。

白:

但很多研究汉语语法的人并不认为汉语有“宾语补足语”的。准则是什么呢?一词一议?

sentiment传递?

“我讨厌他总出差”

这里的“总出差”成了objV,“他”是O。“讨厌”的负面属性可以传递给O,是吗?如果这样,O必须是objV的逻辑S,否则,“我讨厌花摆在阳台上(,掉下来砸到人怎么办?)”

里面的“花”就要受牵连了。

李:

对。

我讨厌ipod

我讨厌iPod老死机

我讨厌花儿

我讨厌花儿老养不活

这事儿真细究的话,属于 subcats 同形打架:带 clause 的句型与带宾补的句型。

白:

“我喜欢厕所门朝北开”

问题是要给宾补一个存在的理由。理由不存在,打架就不存在了。

李:

几乎所有的汉语文法(英语文法亦大同小异)都区别下面三种句型:(1)动宾式;(2)兼语式;(3)宾语从句式。动+宾+宾补的 representation 反映的是兼语式句型。兼语是一种简省的说法,不是一个单纯的(atomic)的关系成分标签。兼语说的是既当V1的宾语又当V2的主语。表面上看,只要我们连上了 O,也连上了 S,所谓的宾补V2 也就间接连上了 V1,因此 把 V2 直接联系上 V1 作为宾补似乎没有必要。问题是,那样的 representation 不能表达 V2 在结构configuration上是低于 V1 的。事实上,这是一个典型的 right branching recursion,V2 是一个 VP(V-bar according to X-bar theory),V1 只是一个 lexical V (V no bar),V2 代表的 VP 整体都是包含在 V1 所辖的边界内。帮助 V1 构成一个更大的 VP。V2 的 VP 也可以是一个兼语式 (递归)。

白:

对。兼语句前后句的坑共享没有疑问。有疑问的是后句不必是前句的objV。在能清晰表达坑共享的前提下,V2有必要成为V1的直接成分吗?如果是,那就做小句宾。如果不是,就是松散的两个谓词做兼语式。为什么要弄出个第三条道路?

李:

小句宾 与 兼语式 有相同的地方,有不同的地方,也有灰色地带。

白:

我知道你来。我喜欢你来。

这是一样的结构。

李:

不能拿灰色说事儿。“得悉”,只能带小句,不能带兼语,这是黑白分明的 case。

得悉你来

* 得悉你

灰色地带最突出的案例在英语的 minimal pair:

I demand him to leave immediately.

I demand that he leave immediately.

白:

这是生成时才用得到的区别,分析时可忽略。

李:

英语句法上泾渭分明的两个句型,在逻辑语义深层其实是大同小异的,很灰色。

白:

汉语里没必要弄出第三条道路

李:

不一定只有生成才需要区分。语义落地也可能得益。如果没有宾补的直接联系,我问 O,就不能区分单纯的 O 和带宾补的 O,如果所有的兼语都变成 宾语小句。

白:

我派你去,就是“我派你”“你去”不需要让“去”从属于“派”。

或者说,“派”不需要给“去”预留一个坑。

李:

那就切断了动词 V1 与兼语的直接联系。必须通过 V2 才能间接联系到兼语。

白:

错,萝卜共享就是联系

李:

有时候我们不在乎是 宾语 还是 兼语,我们就没办法用同一个子树句型做抽取。譬如,“多亏”:

多亏老李。

多亏老李送我回来。

这两句要找感谢的对象,就无需区分 宾语和兼语。

白:

这没什么不好。多亏我处理成副词。“多亏了”也是一个副词

李:

如果第一句是 VO 第二句是 V+Clause,就必须用两个句型才能捕捉。

白:

多亏老李,是副词升格为动词。

李:

关键是,有时候我们需要区分宾语和兼语,有时候我们不要区分,为了同时照顾这两种需要,把兼语处理成子句是不妥的。

白:

可以不从句法上区分,而从词典来区分。

李:

退一万步,多一个宾补的直接联系,只有好处,没有坏处。

白:

我的处理是要么包进来要么切断。多了歧义打架需要处理,而这本来可以是伪歧义。

李:

是真歧义,那就该处理。是伪歧义,也可以硬走一线,系统内是可以保持一致性的。你这里所谓伪歧义的情形实际是灰色地带,或两可地带,系统内部可以规定走哪一线,内部协调即可。伪歧义的真正困扰是系统无法区分,随机走路径。如果有办法确定性地走一条路径,理论上的伪歧义在实践中就化解了。传统 parser 的伪歧义困扰是,伪歧义与真歧义混淆在一起,使得真歧义无法 stand out (being identified)。这里的情形不是。

白:

中间没有N的,也有助动词和补语两种可能性。助动词带的谓宾真包进来,补语我处理成共享萝卜的对等合并,与所谓核心动词并无隶属关系。只不过形式上把根让渡给前面核心动词而已。

看看前面的例子,“我喜欢厕所朝北开门”,什么特征决定了“厕所朝北开门”是小句宾?

李:

不好说。

假如有一家厕所公司专门建厕所,就好像苹果公司造 iPhone 一样,“喜欢厕所朝北开门” 与 “喜欢iPhone照相清晰” 有什么根本区别?再如,“喜欢厕所清洁卫生”。

与其花力气区分灰色地带的兼语 from 子句,不如一条路走到黑,对灰色的那些词规定一条路径。到落地的时候,如果需要,再进一步 fine-tune 来决定。如果是 sentiment 落地,就可以这样来 fine-tune:“喜欢”的兼语必须是产品或其他实体专名,才可以让其得到 positive sentiment,这是从严的 fine tuning。从宽的 fine-tuning 可以要求兼语不能是带有贬义色彩的名词,assuming “厕所”是这种类别。但是这种 fine-tuning 的拿捏,只对做“兼语”的名词需要,如果“喜欢”所带的不是兼语,而是纯粹的名词宾语,那么不管宾语是王八蛋还是杀人犯,喜欢的 positive sentiment 还是落在宾语身上。

“当年的德国,很多人喜欢甚至崇拜希特勒。” 对于希特勒,这是 positive sentiment。但是,cf:

“我喜欢希特勒被处以绞刑,而不是自杀身亡,逃避人民的审判。”

这句中的“喜欢”,对于 希特勒 就不是 positive sentiment,因为 parser 把希特勒parse成有宾补的O(即兼语),而不是纯粹的 O

白:

喜欢厕所朝北开门 与 喜欢iPhone照相清晰 有什么根本区别?---这话也是我想说的,但我认为它们都是小句宾句式,与兼语无关。

李:

我要说的是,对于这样的 cases,要不一律处理成兼语。要不一律处理成小句宾语,只要 consistent 即可。

白:

希特勒那句,也是小句宾,没兼语什么事儿

什么情况下sentiment可以穿透到下面一层的成分,不是由句法决定,而是由另外因素决定。

李:

“我喜欢少年希特勒努力发奋。” 这句呢,也是小句?

白:

是

李:

我要说的是,对于有灰色地带的那些词和句型,可以人为规定一条路径。

区分:“我喜欢少年希特勒努力发奋” 和 “我喜欢老年希特勒被处绞刑”,一个是对“希特勒”是褒义,一个不是。

白:

褒义针对整体,是否传导到部分,it depends, 针对整体都是褒义。

李:

说的是部分。我喜欢【human】和 我喜欢【human】VP,对于这个 human,默认是褒义的。

白:

要区分的只是能传导到部分的褒义和不能传导到部分的褒义。我喜欢【human】vp 是天经地义的,喜不喜欢其中的【human】,不由句法决定。

在我这里不默认。而且默认sentiment设定,和搞出一个句法类别,也是两回事。

李:

默认有很多便利。偷懒的时候,默认在统计上对数据质量有好处。默认这东西,不用白不用,尤其是从工程和实用上考量。我目前的 “喜欢” 的 sentiment 规则,不论中文英文,都是走默认的道路:管它后面的 NP 带不带 VP,只要 NP 是 entity,就默认是 positive 落地了。这个 practice 在实践中有莫大的好处。 “喜欢希特勒 VP” 这样的可能的例外极其罕见,以致于根本不必在默认之外再费力气去区分。而 “喜欢厕所VP”不算例外,无害:depending on 厕所是否看成是 entity,或者被排除在语义落地的雷达之外;或者落地了,也是正确的。

白:

充其量是个heuristic

我喜欢张老师讲古代史,不喜欢张老师讲现代史

李:

这个不是反例,前半句是 褒,后半句是 贬,都落地到 张老师身上。

白:

加分减分都没问题。问题是逻辑推论有没有。喜欢张老师和不喜欢张老师如果都是逻辑推论就有问题。讲逻辑的人是分得很清楚的,喜欢,对事不对人。sentiment也是很清楚的,一个给张老师加分,一个给张老师减分。但是确实没有“喜欢张老师”和“不喜欢张老师”这两个逻辑推论。

李:

回到原来的 arguments,如果 (1)我喜欢张老师;与 (2)我喜欢张老师讲古代史,是两个不同的 parses,sentiment 落地的时候,就必须有两个规则来对付这两个不同的结构

白:

这个很难吗?我不觉得。爱屋及乌,爱小句及小句逻辑主。一句话的事情.

李:

天下无难事。

但是,对于如此基本而普遍的 sentiment 的表达(love类 和 hate 类),本来可以直接搞定,非要绕一个弯儿再搞定。本来一组规则,非要增加一倍的工作量去写规则,去维护,这是很不合算的。

即便不谈 sentiment 这个具体的落地应用,抽象来说策略,这个争论的本质就是:两个句型有相同的部分,有不同的部分,如何处理?其实没有普世标准,就是系统内的一致性和方便性,系统内协调。

白:

不是这样的,就是一个sentiment penetration属性赋值yes还是no的问题,直接写在相关动词的词典里。其他都不受影响。标配赋值no,需要设yes的明示。

李:

我喜欢他。

我喜欢他老实。

我喜欢他做好事。

换一个角度看,第一句和第二、三句在“我喜欢他”这个部分是一样的。后面的 AP 和 VP 也可以看成是喜欢的某个部分或方面(aspect)(或理由),这个角度是先对人后对事儿。与你的“喜欢”应该对事不对人,或由事及人,具有等效的逻辑性。即便我说“我喜欢X”,常识告诉我们,世界上没有完美的X。“喜欢X” 后面隐藏着后面的 likable aspects,X 与 aspects 是整体与部分的关系。

白:

我喜欢他,我喜欢他老实,我喜欢他的老实。VS

我喜欢这本书,我喜欢这本书出版,我喜欢这本书的出版。

也就我们这种领域,讨论一个语言学概念的立和废,也要扯上系统甚至应用。

李:

是从部分的角度来推及整体,还是从整体的角度推及部分,不过是角度不同。

白:

如果一个arg,是这样。角度不同。两个坑就未必了。

李:

就好比半瓶水,一个角度看到了半瓶水,另一个角度看到了半瓶空气,都是有效的逻辑。

白:

我喜欢这本书出版,和我喜欢这本书,不是延展后者的关系。我们还可以说,我喜欢这本书春节后再出版。喜欢的重点既不在书也不在出版,而是在出版的时间。可以既不喜欢书,也不喜欢出版,只是对那个出版时间情有独钟。一个坏人干了件好事,我们总可以喜欢那件好事吧。不需要扯上喜欢坏人。

一个出版商可能对某本书恶心到吐,但是那本书的出版可以帮他赚大钱。他喜欢“那本书出版”但不喜欢“那本书”也是情理之中的。heuristic可以进入系统,但进入语言学是否合适要画个问号。进入系统也有“诛心”之嫌。喜欢坏人干的某件好事,被当成支持坏人的证据,这样的系统大家都要当心了。

李:

喜欢坏人干的某件好事,被当成支持坏人的证据,在情感分析上没有错。在大数据分析的时候,点点滴滴皆证据。坏人干了好事儿,只要被提到,就给这个坏人加了一分(褒)。这一点儿也不影响对于这个坏人的舆情分析全貌。恰恰相反,这才是真实的舆情。如果坏人干了好事儿被提及 m 次,坏人干了坏事儿提到了 n 次,纯粹厌恶坏人的情绪表达提到了 o 次,纯粹喜欢坏人的情绪表达提到了 p 次(p 通常接近零),那么这个坏人的褒贬指数,就是 (m+p) 与 (n+o)的比例。请放心,p 基本是 0,而 m 也会远远小于 n,这个大众舆情不仅靠谱,而且真实,bias free。

宋:

我喜欢希特勒自杀。

李:

宋老师的这个例子前面已经论及。回顾一下就是:情感分析中,“喜欢”的默认规则的确可能把它算成是对“希特勒”的正面评价。因为这个默认规则是把宾语和兼语同等看待,不去问后面的宾补 VP。理论上,这个结构根本就不是【宾语+宾补】的结构,而是【宾语子句】的结构,但是由于区分二者对于“喜欢”这样的词,有一定的难度,所以我们可以在 parsing 阶段一律当成兼语结构处理和表达。这样一来,默认的sentiment规则就会犯错。

犯错怎么办?如果这种案例极其罕见,不值得做,那就算了,因为默认的sentiment规则在绝大多数的场合是保证了数据质量的。如果觉得还是值得做,那就在默认sentiment规则之上再做一条规则去 override 默认。这条规则不需要改变 parser,而是利用 parsing 在这类结构上的 consistency(错也错得可以预测) ,将错就错,矫枉过正,把这个错纠正过来。换句话说,这个策略等于是休眠唤醒,不过这个休眠唤醒不是在 parsing 的后期进行,而是在 sentiment 语义落地的时候进行,其效果等价于把【兼语式】重新分析为【宾语小句】,切断“喜欢”与“希特勒”的语义直接联系。

不知道我说清了没有。可能有人会问:既然在语义落地时候要做类似休眠唤醒的工作,为什么不索性在parsing里面(parsing的后期,语义模块)里面做休眠唤醒呢?理论上,提前做休眠唤醒,使得parsing更精准,可以benefit不仅仅这个 sentiment 的语义落地,还可以 benefit 其他的语义落地和应用的场合。但是,实践中在哪个阶段做合算,不是那么简单。因为休眠唤醒这些事儿大多是长尾现象,鸡零狗碎,做不胜做。在还不能确认到底有多少好处前,往往顾不过来在 parsing 中统一处理好。而且很多时候,做了也白做,你需要用到那个落地或那批落地也许根本就用不到。

Anyway,point is,落地的时候是可以包容 parsing 的错误和不足做包容性产品开发(adaptive dev),只要 parsing 是可预测的数据结构,是有内部直通车的,而不是 offshelf 拿来的 parser,缺乏足够的内部支持和协调。Having said that,如果确实事先可以 identify 一些带有普遍性的休眠唤醒现象,以及可以惠及很多可能的语义落地应用,而且也有足够的时间和资源去做这些细线条的深度语义工作,那么不要等到落地就在提前在 deep parser 的语义模块里面做好,当然是更理想的情况。

白:

对坏人的褒贬判断,对事不对人自然左右不了大局,没什么可担心的。问题是拿对事不对人的表述做以坏人为参照的站队分析,这就很可怕了。

李:

可怕啥?或者就是大海里的一颗老鼠屎,丝毫没有影响。或者就是,用休眠唤醒杜绝它(它=“拿对事不对人的表述做以坏人为参照的站队分析”)。休眠唤醒之所以可以进行,是因为 parser,已经准备好了结构基础:要啥有啥,哪怕这个 parse 是不完善的。要 O 有 O,要 宾补 有 ObjV,要逻辑 S 有对于 V2 的逻辑 S,四通八达的路径都在。driving word “喜欢”也在,可以词驱动。所有的结构的节点词的信息,包括 ontology 都在,包括 “希特勒” 是个独裁者、通常是坏人这样的信息也都在。有了直通车,啥事儿做不成?什么案子不能翻?什么深度休眠不能唤醒?什么具有统计性的“可怕”的后果不可以杜绝?

白:

分析成小句宾,诛心或误伤的责任就不在分析器的开发者。而在后道工序。否则人家会说,都是你分析的我喜欢希特勒,我哪儿喜欢了?一颗老鼠屎,也那个。对于小句宾来说,没分析出我喜欢希特勒,这大不一样。但是小句宾结构与“喜欢”结合,大概率被穿透,这句话可以说,之后也是要啥有啥。谁用了谁负责,但分析器的开发者也没说错话。

李:

话说到这份上了,其实也没有多少进一步需要辩护各自做法的 arguments 了。选择这个兼语的表达,肯定不是因为明明知道处理成宾语小句更好,而不为之。一定是自有苦衷和盘算。

白:

我若干年前也用过这样的表达。最典型就是“我是县长派来的”,把其中的“来”也作为“派”的一个arg。后来发现,其实去掉它没什么损失。因为“派”和“来”共享了一个萝卜,所有联系都在里面了。

李:

隐约的感觉是,去掉它在逻辑语义深层没有损失,可能的损失是句法表层的痕迹(语法学界叫做 configuration info,就是 X-bar 理论里面的 bar 的信息)。

白:

这是有很多其他途径可以记录的

李:

留住它就是留下了这种 bar 的痕迹,就好比我们利用小词解构了实词之间的句法语义关系以后,我们并不把小词当敲门砖丢弃,而是用 X 挂上一样。虽然 理论上,这些小词对于深层语义已经没有意义。另一个例子是主动被动,到了逻辑语义的核心,这个 voice 的不同色彩,没有地位,可是语言分析中,留下表层的 voice 信息,还是可能对语义落地和应用有好处的。

【相关】