李:

欢迎金老师。从理转文 学语言学的 往往功力深厚 别具一格。白老师 还有语言所的前辈范继淹先生 都是证明。

白:

这里是NLP的一大窝点,每天都有扯不完的话题。

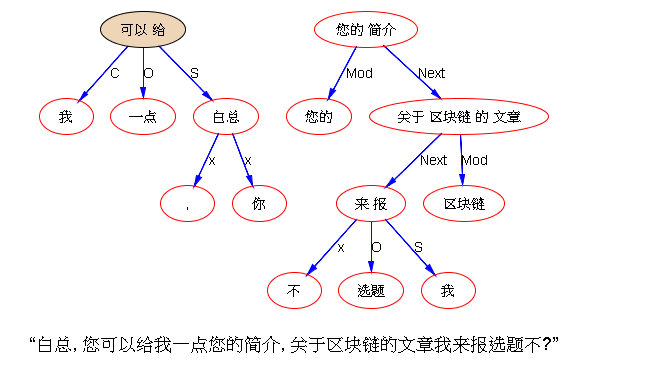

“白总,您可以给我一点您的简介,关于区块链的文章我来报选题不?”

看看这个“可以……不”之间经过了多么漫长的旅途。

李:

这个“可以不”肯定是搭配不上了,硬做也不值得,主要还是看看怎么凑合吧?当然是用 Next 把局部parses先patch起来,这样至少通道是有的,想做功的话,余地在。

白:

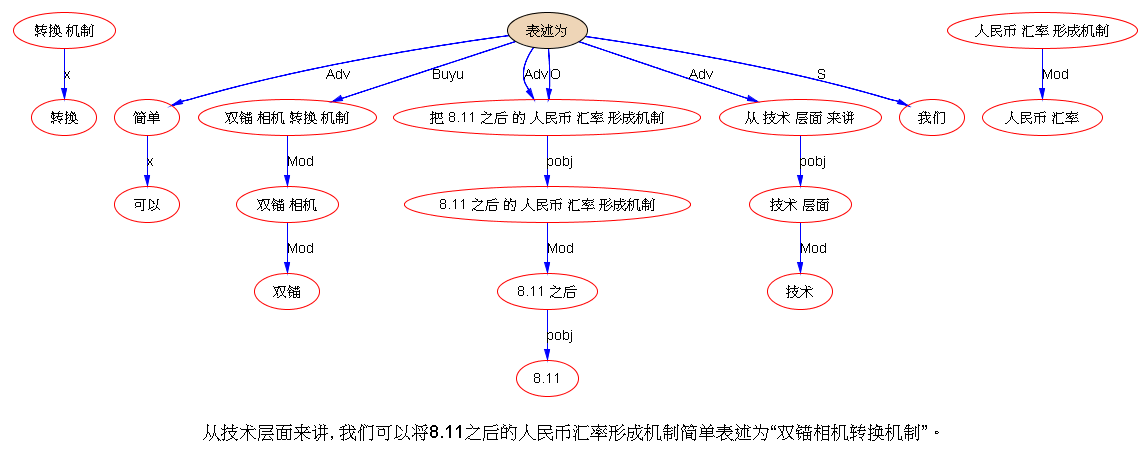

从技术层面来讲,我们可以将8.11之后的人民币汇率形成机制简单表述为“双锚相机转换机制”。

这里的“相机”,谁的机译系统能翻对?

李:

not bad

白:

全是camera

李:

不是 camera 是啥?不懂术语。

谷歌这次及格了。涉及汉语的MT,谷歌总是比百度差或略差。谷歌干脆 license 百度得了,至少中文MT。

白:

take actions accordingly

这哪是术语。地道的中文。

李:

那就是我中文不行。哦,相机-见机 而行

双锚相机是什么相机?

白:

在没有camera的时候,就有这个“相机”

李:

但是大数据把它冲得快没影了

白:

我朋友圈转发了FT这篇文章,一看便知。

李:

相机是现代高频词。一个不懂行的人,看到这一段虽然不懂,但是心里在问:

“双锚相机是个什么相机?”

白:

双锚,也不修饰“相机”,他俩都是状语,修饰“转换”。

李:

那是你懂。对于不懂domain的人 不是这样的。

cf:“单反相机转换机制”

白:

双锚vs单反,完美的对仗。

李:

如果汉字保留“像机”不用“相机”,可能不至于。

一个 real life MT 很难为了一个几乎从来不用的 WSD 的选项,做啥特别的功夫。不单不合算,而且太容易弄巧成拙了。对于 trained model, SMT 根本就没有这个data;对于规则MT,也不大值得做。拉倒好了。

白:

这种逻辑,等于告诉用户,你就从了吧。

李:

对于极小概率的现象,如果真要做,那就尽可能词典化。词典化或 expert lexicon,没有啥副作用,可以应对长尾。任何概括化的努力,都容易亏本。

白:

极小概率累计起来就是长尾

马:

谋求单反相机起义。造一个,哈哈

白:

在不同formalism下,亏本与否可能结论大不相同。比如,如果formalism天然就是词例化的,就不存在弄巧成拙的问题。满世界都是拙。

张:

极小概率的词典化是规则系统最可爱而可贵的品质和能力

李:

可不,满世界都是拙,高高在上的精英规则就可以很光鲜。词例化 or expert lexicon 也还是不时需要与上面的合作。譬如句型的变式。合作的方式有不同。有句法语义一体的合作方式,也有先句法后语义的合作方式。各有利弊。

张:

这种拙是大局观,是大智若愚

我们这里有个小组正在天晕地暗研究知网的MT~~~

李:

愚公移山呗

挖一块儿 少一块儿 而山不加增 ......

张:

两位大师何时有空一来论剑?@白 @wei

李:

没去过东北,都说东北有三宝。

张:

白到骨,wei入髄

wei来we妙; wei说I 赞

李:

张老师那地儿 迟早是该去看看

李: 似乎是调通了,但还是选择不做“相机”。非不能也,是不为也,你懂的

有一个 catch: 将 ----> 把: “将” 等于 “把”(介词),但更歧义(modal V),好在前面有 “可以”。

【相关】