李:

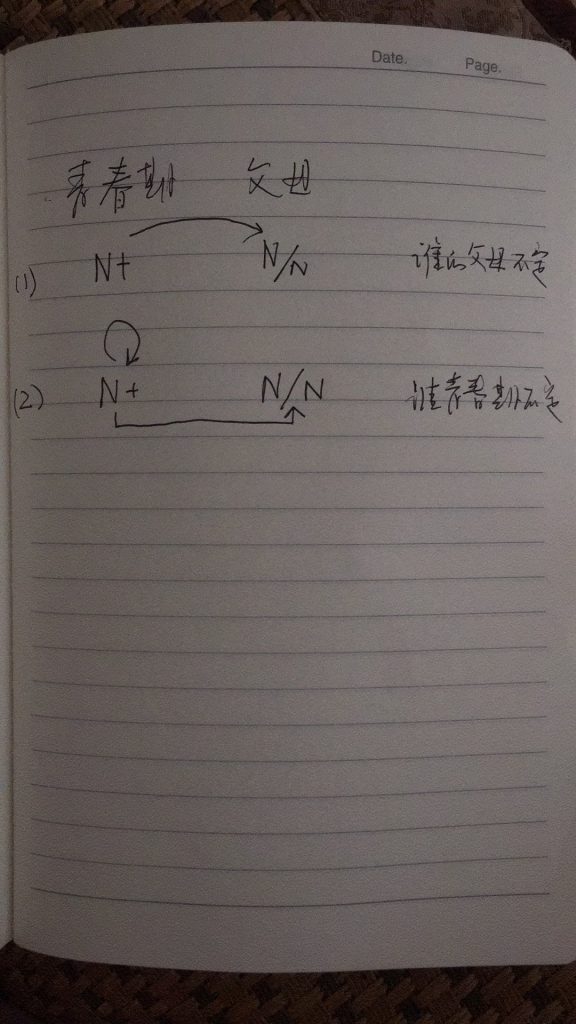

咱们可以聊聊为什么叫 center 递归,很多人不做区分。自然语言中,right branching 递归很常见,也常可以超过三层。说的人,听的人,都不感觉是负担。道理就在,虽然“左括号”在不确定的位置,但他们都归于统一的右边界。这样一来就不需要栈(该死的栈!)结构的机制来对付它,有限状态就可以了。乔姆斯基没法拿这个常见的所谓递归来批判有限状态,因此他不得不举 center 递归作为杀手锏。可问题是,自然语言几乎没有什么center 递归。

雷:

The man who the woman who had lost all the keys was calling all day finally came

白:

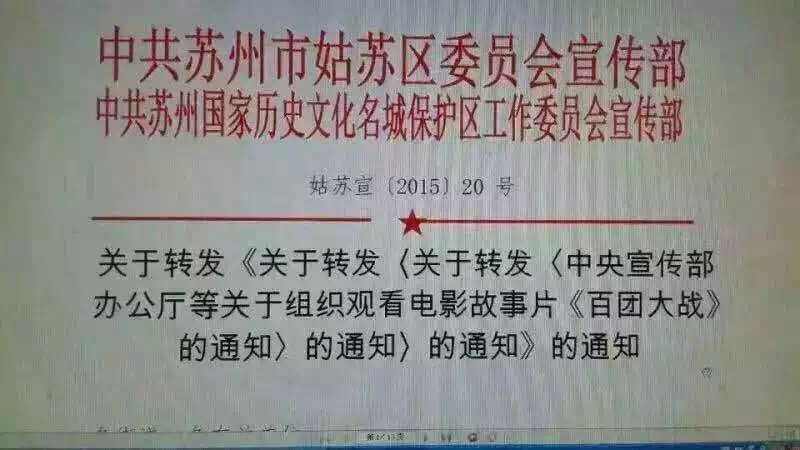

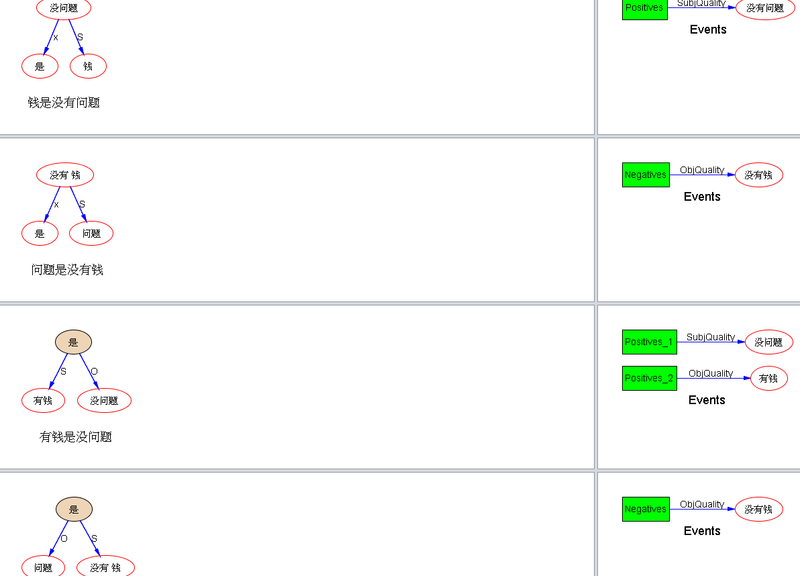

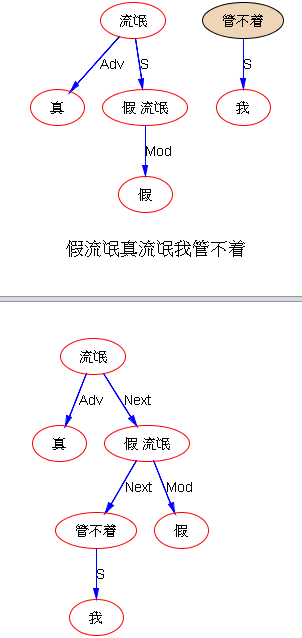

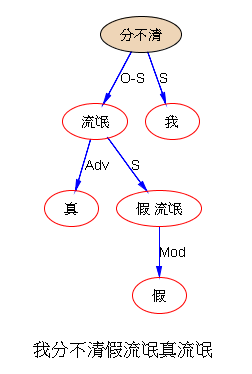

关于印发关于学习落实关于进一步深化改革的决定的若干意见的通知…… center recursion的中文例子

李:

这些是人话吗?亏老乔是语言学祖师爷!乔老爷反复给我们洗脑:这不仅是人话,而且是人话的本质。

这就是牵强附会,登峰造极地牵强附会。

雷:

right branching 递归是线性的,而center embedding不是线性的

李:

这里面就形成了这么个trap,信服他的人,一个是源于他的权威性, 另一方面是把常见的右递归当成了支持乔老爷的证据。乔形式上没有误导,因为他是严谨的、聪明的,但实际上达到了误导的效果。这就是“递归教”的 fallacy.

雷:

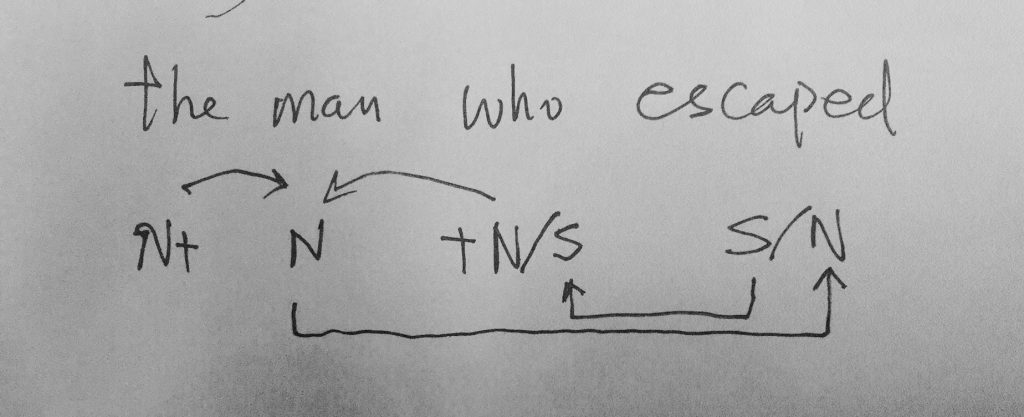

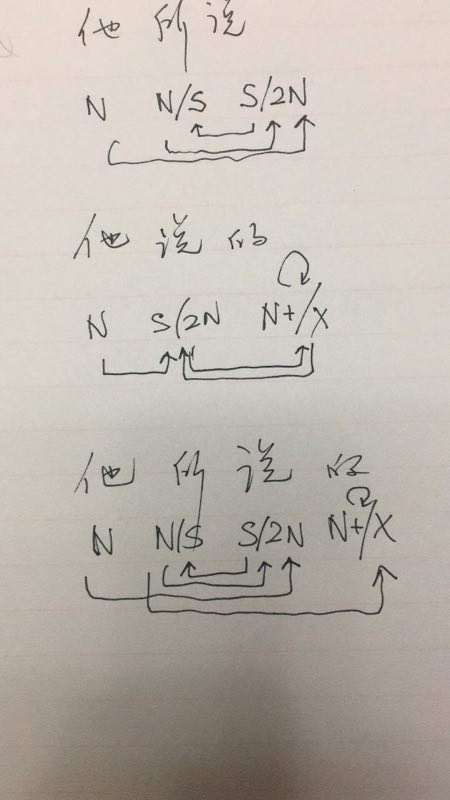

这个是right branching sentence:

The dog slept on the doorstep of the house in which it lived.

李:

右递归太常见了,听上去也不牵强。典型的句式是 vp 的嵌套:

to ask sb to beg sb to order sb to …

雷:

我来理解一下你的意思:center embedding recursive sentences 不存在,或不出三层,所以是finate state的?

李:

不是不存在,是如此罕见与牵强,而且也从来不超过三层,除非你是恶作剧,因此它绝非语言本性。

雷:

不足为道,本来就是线性的。CFG的parsing在理论上是cubic,就是因为这个center embedding

白:

这么多计算手段怎么会被center recursion憋死,自动机加几个计数器就可以线性了,只要计数器不爆表。

李:

拿恶作剧和语言游戏作为语言能力的证据,是乔老爷的最大忽悠。

雷:

我觉得这是数学家和哲学家的通例:形式上的完美。而我们做NLU的,从来就不把这个当真,是不是?

李:

既然最多不过三层, 那么多层有限状态即可轻松应对,三层就是 3x,当然还是线性

雷:

语言学系的人不到计算机系串门

李:

世界上有人把简单的问题复杂化,递归便是一例。

雷:

呵呵,因为我们不是数学家出身?我同意你的说法:就只有几层,有方法可以对付,不必搬出递归来。

李:

他那些理论真地是折磨人,云山雾罩的。有时候感觉,全世界语言学家被他玩得够苦。我还算幸运,我们系比较开通,学句法的时候躲开了乔姆斯基,拿hpsg来充数。hpsg 至少比 gb 接地气,尽管它像个要争宠的小妾,每一个分析都要以乔老爷的主流作为假想对象,反复辩白,妾身清白。

雷:

加州那边不受什么影响吧,走的是另一个路子,如, cognitive grammar, Fillmore

李:

Fillmore 了不起,但过分细琐. Framenet 很好的概念但不实用,以前写【语义三巨人】专门论过。因为它处于语义和语用之间,不尴不尬。

雷:

我专门研究过framenet,觉得还是不够细,同你的琐碎不是一回事。是每个动词的用法还不够全,还有就是Verbnet。感觉是虎头蛇尾,后面都是学生做的,真正要用起来还不够全面。

李:

我看法正相反。我也仔细研究过它。以后找机会展开与你辩论。

白:

伟哥看过来,你的中递归

QJ:

咋了,堆栈溢出了?

雷:

呵呵,一山一寺酒一壶,三层。

李:

还真有这么狗血的不是人话的东西存在。服了我党苏州委员会。

另,再看里面的括号的中递归形式:《 ..<...<...《...》...>...>...》,凭什么这样用括号呢?双单单双......。如果双单都用,应该是交错而行,否则索性一双到底或者一单到底。

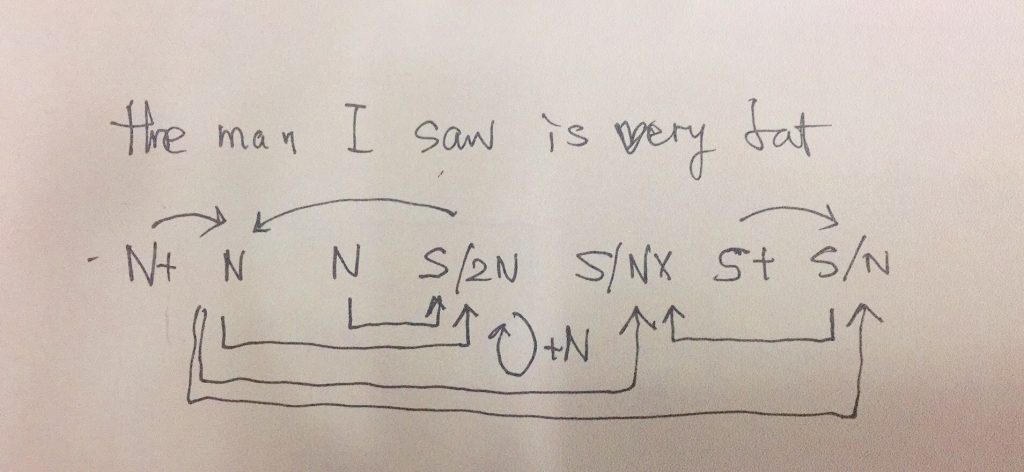

wiki 上给的英文中递归(center recursion)的狗血例子是:

A man that a woman loves

A man that a woman that a child knows loves

A man that a woman that a child that a bird saw knows loves

A man that a woman that a child that a bird that I heard saw knows loves

An interesting theoretical point is that sentences with multiple center embedding are grammatical, but unacceptable. Such examples are behind Noam Chomsky's comment that, “Languages are not 'designed for parsability' … we may say that languages, as such, are not usable.” (Chomsky, 1991)

from https://en.wikipedia.org/wiki/Center_embedding

乔老爷的 grammaticality 论,unacceptable 还 grammatical,如此偏执,也只有乔老爷这样的人神才敢了。还有这个 languages are not designed for parsability 的论点,直接与语言的交际通讯本质相抵触。

The linguist Fred Karlsson provided empirical evidence in 2007 that the maximal degree of multiple center-embedding of clauses is exactly 3 in written language. He provided thirteen genuine examples of this type from various Indo-European languages (Danish, English, German, Latin, Swedish). No real examples of degree 4 have been recorded. In spoken language, multiple center-embeddings even of degree 2 are so rare as to be practically non-existing (Karlsson 2007).

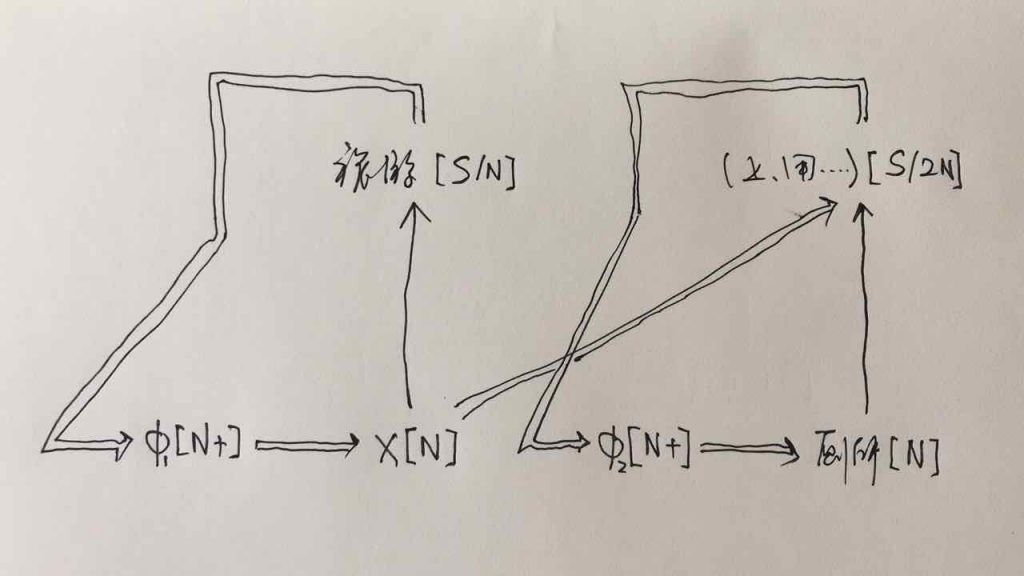

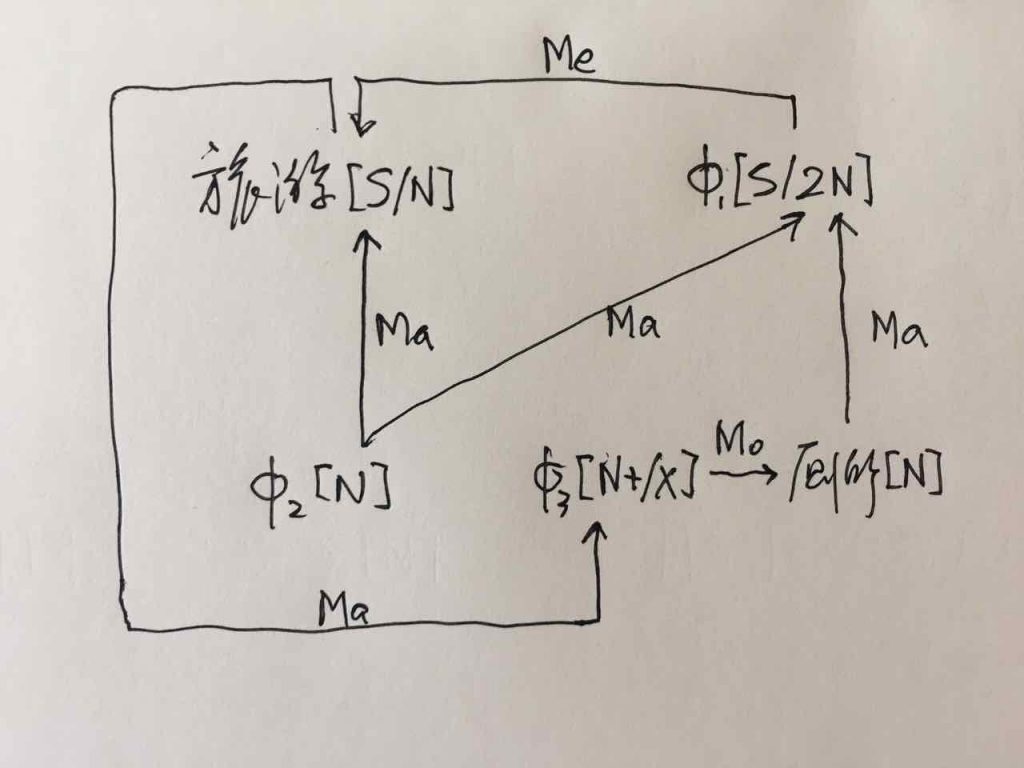

也就是说,这种东西统计上是不存在的。是臆想出来的语言学问题,然后把整个 parsing community 给绕进去。雷司令为此搭进去好几年时光,试图去求解它,终于发现只要有中递归就不存在线性算法。

白:

去掉中递归,计算复杂性从接近立方级一下子变成了线性。吃水不忘挖井人啊……

云:

不过计算机语言里这种递归比比皆是啊,尤其是 recursive decedent parser。

白:

人的短时记忆不允许。7加减2,常委数量,也就是三到四对括号,再多了就晕菜。这个可以佐证伟哥的统计结论。

雷:

不怕一万,就怕万一,冷不丁的来

白:

嗯,那就反刍呗。in memory不要搞

李:

还有一个狗血的语言学问题,也是乔老爷造的孽:所谓 binding theory。本来是语言中很小的一个现象,结果被无限夸大,引发了无数论文和论战。由 Binding theory 的三条原则而来的有那么点实践意义的规则,我15年前指导一个实习生,用了不到两个小时就实现并调试完成,后来一直没遇到什么有统计意义的挑战。

可见,一个简单的工程问题,可以怎样地被理论家无限复杂化,烦琐哲学害死人。伟大的理论家害死一代学人。

白:

学人仍然是学人,谁也没被害死,只是又想当学人又想搞工程的被害死而已。这是两种不同的打开方式,老乔根本就当另一种打开方式不存在。

宋:

自然语言规则必须受到人类认知能力的约束,否则就称不上自然语言了。

白:

认知能力有个体差异,也有亚文化差异。

宋:

7加减2应该就是人类共同的认知约束。

白:

内存不够就拿笔作记号呗。

李:

有意思的是,谁创造的标点符号,三层括号:

{ ... [ ...(...)...] ...}

怎么就明白大中小三层就足够了?

白:

摆明了就常委的菜下饭。

多一层也不该憋死人,难受一点而已。艺术一点,难受的程度可以小一点。

李:

已经有人做过大数据调查,多一层也不行,没有超过三层的。

白:

我还是坚持分析要更鲁棒,生成坚决不说。

宋:

自然语言一般来说应该是能听懂的话。如果线形的语音流无法使一般人听明白,非得要落到文字上,左右来回扫描,甚至要用笔做记号,就不自然了。

白:

公文不一定。公文是官场亚文化催生出来的东东。

宋:

非自然语言的确切信息的表达,表格是一例,图形也是一例,再复杂就要用数学公式,必须有足够的数学修养才能看明白。

白:

人能意识到的“回文”,可绝不止7加减2。“上海自来水来自海上”轻轻松松就打到上限。

李:

9-gram,还在 7+2 的极限内。来个 19-gram 的回文,就真服了。人脑就是块豆腐,这方面说过大天去,也无补。人成为万物之灵,绝对不是因为有个记忆能力,或以记忆机制做底的语言递归能力。

首发科学网 【泥沙龙笔记:再聊乔老爷的递归陷阱】 & 《泥沙龙笔记:狗血的语言学》

【相关】

【语义三巨人】

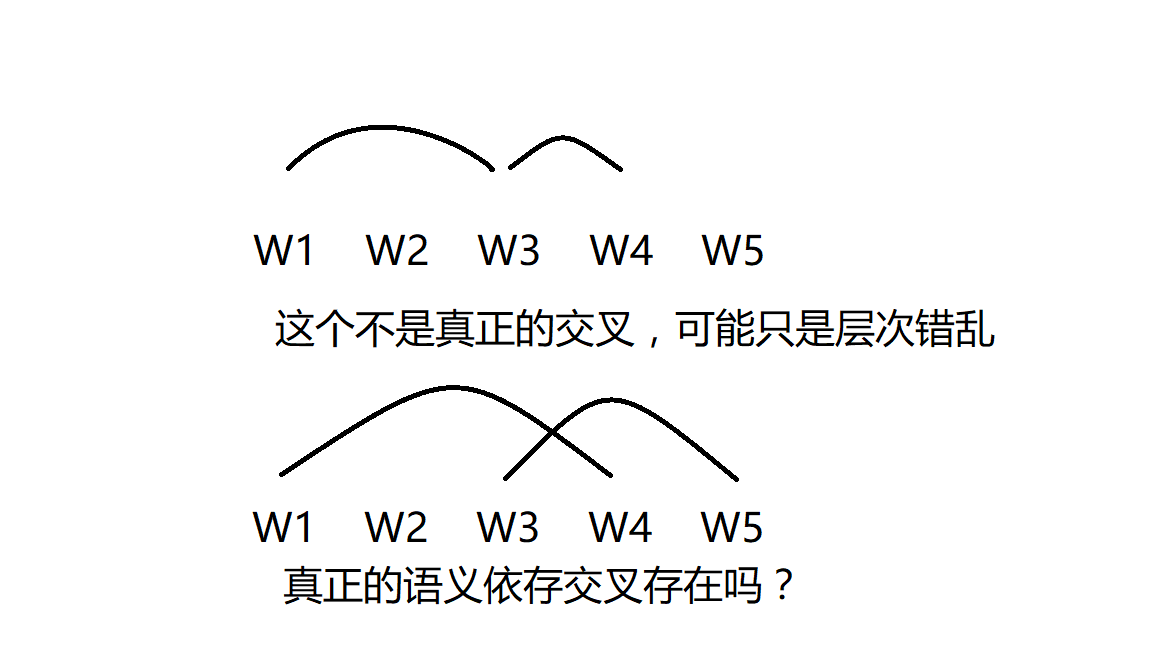

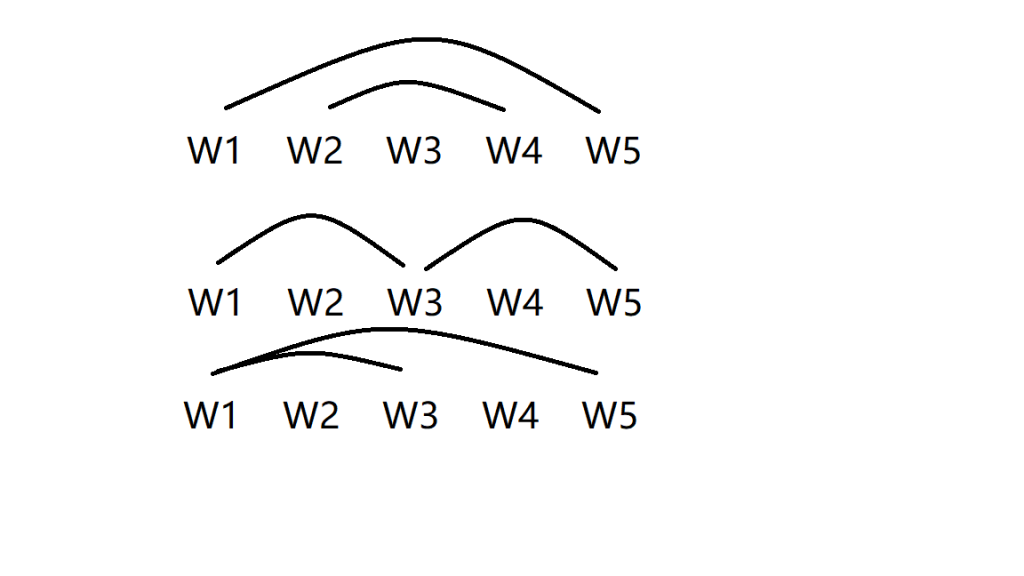

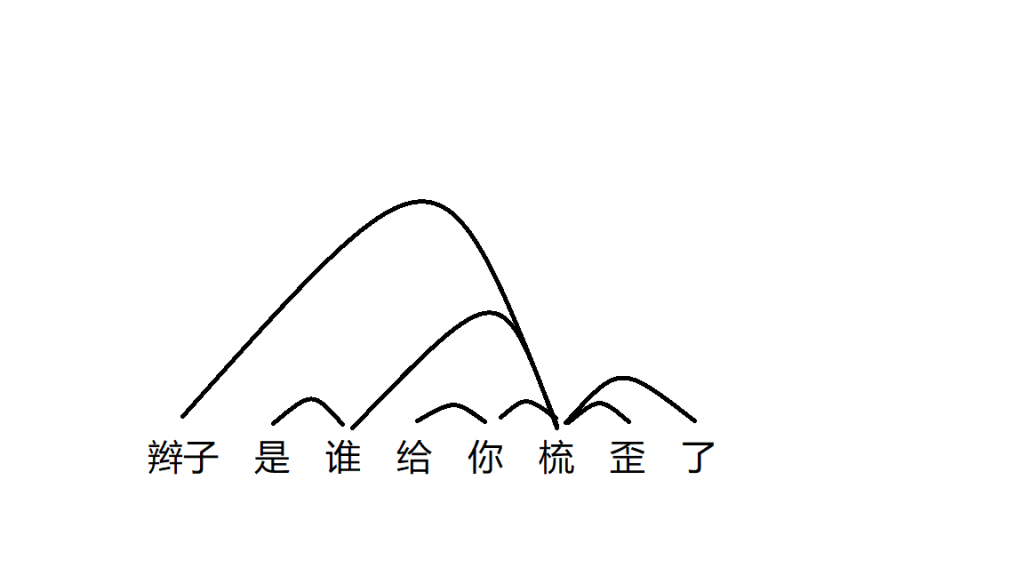

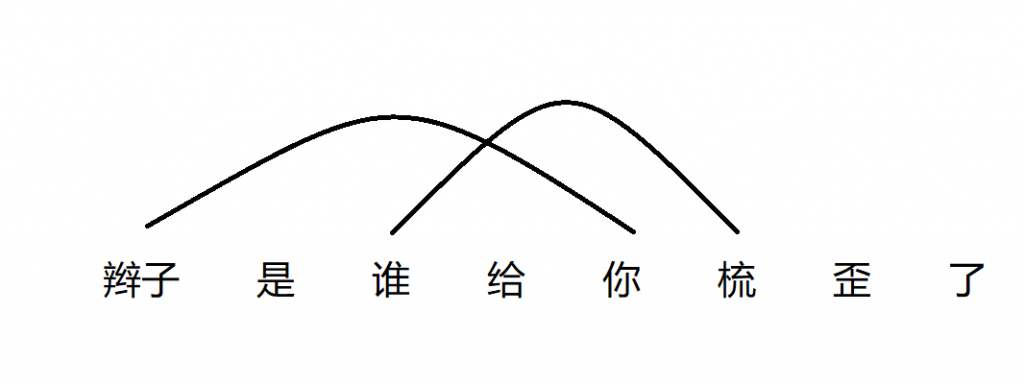

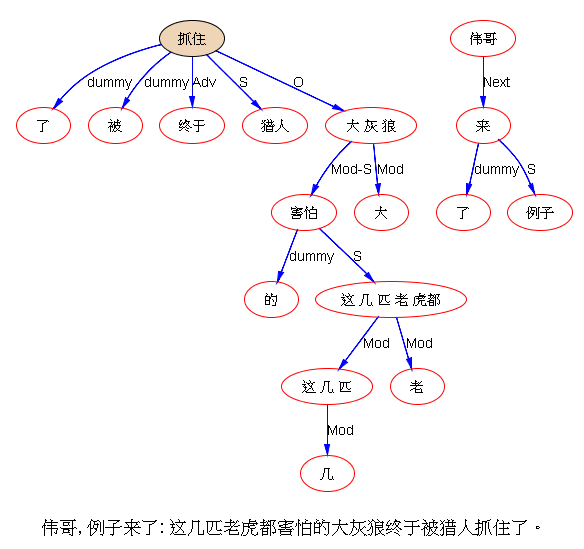

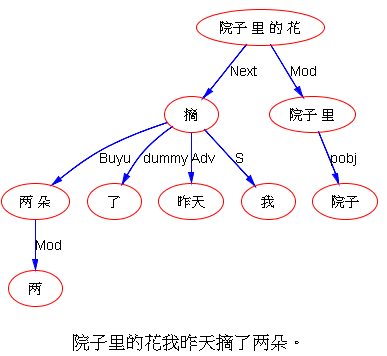

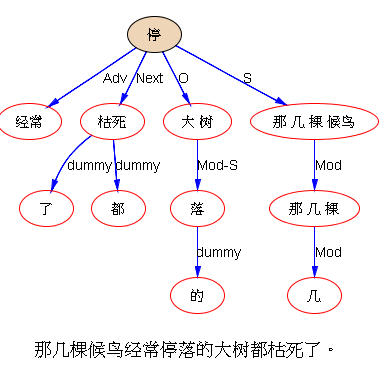

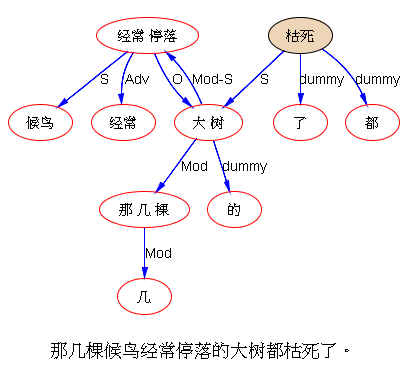

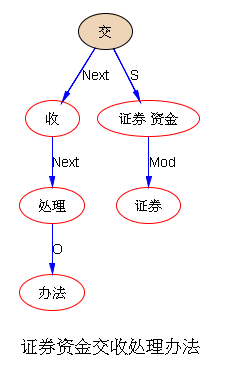

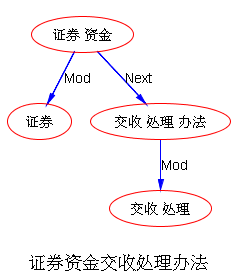

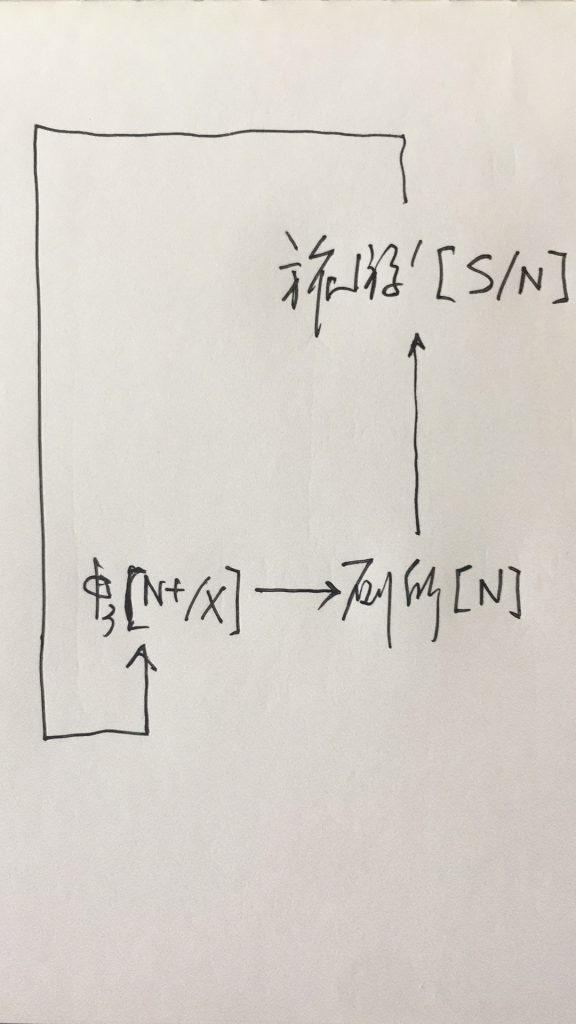

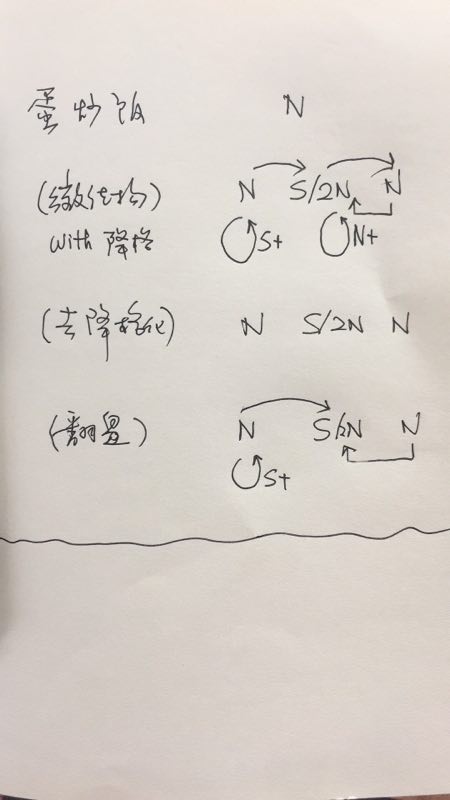

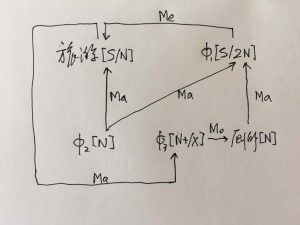

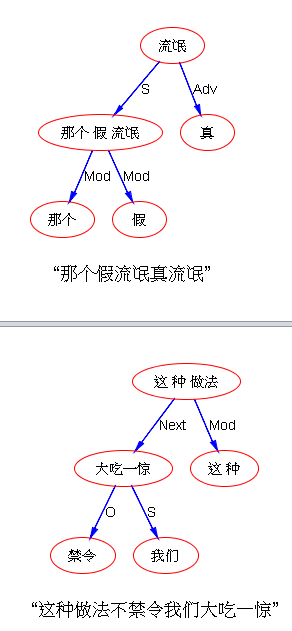

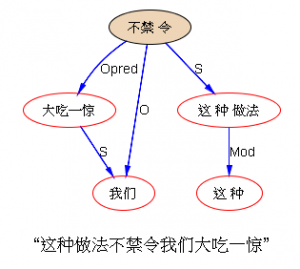

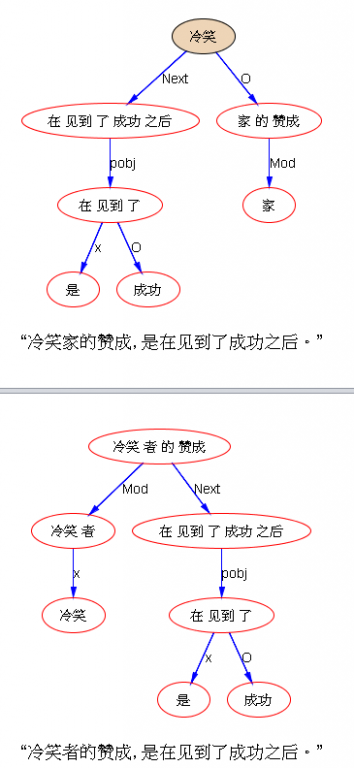

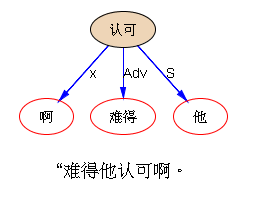

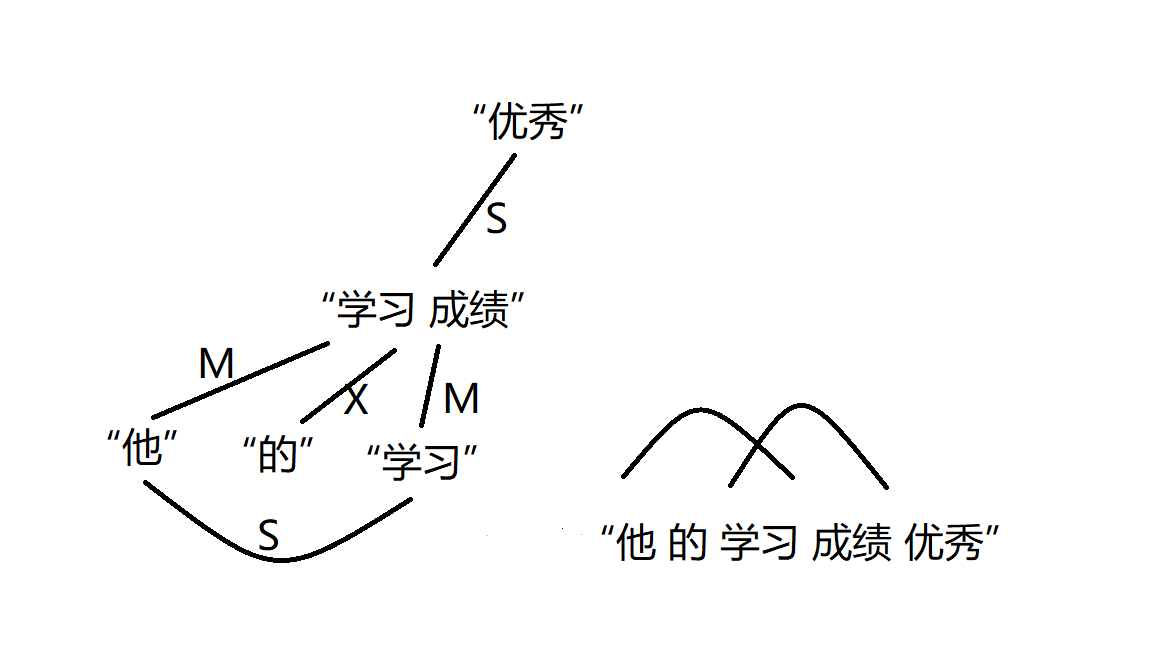

如果DG(Dependency Grammar)揉进了浅层的短语结构及其边界,先做了合成词“学习 成绩”,那么把“他”与合成词内部的“学习”连接成主谓关系,是交叉。但是如果不引入短语结构,一切节点都是终极节点,实行彻底的原汁原味的依存关系(DG)表达,那么“他”作为主语连接给“学习”以及“学习”作为修饰语连接给“成绩”,并没有真正交叉,只是层次(configuration)显得乱了。但是DG的最大特点(或缺点)就是打破层次,只论二元。多年来我们在DG中部分引入 PHG (Phrase Structure Grammar) 短语结构表达,也是为了弥补这个缺陷。

如果DG(Dependency Grammar)揉进了浅层的短语结构及其边界,先做了合成词“学习 成绩”,那么把“他”与合成词内部的“学习”连接成主谓关系,是交叉。但是如果不引入短语结构,一切节点都是终极节点,实行彻底的原汁原味的依存关系(DG)表达,那么“他”作为主语连接给“学习”以及“学习”作为修饰语连接给“成绩”,并没有真正交叉,只是层次(configuration)显得乱了。但是DG的最大特点(或缺点)就是打破层次,只论二元。多年来我们在DG中部分引入 PHG (Phrase Structure Grammar) 短语结构表达,也是为了弥补这个缺陷。