分类: 杂类

江城记事之十四

美国大选系列结语(在川粉群里舌战)(外三篇)

朋友:

你的系列文章只是附和眼前现象,没有说服力。老川输了,就能证明民主党正确?就能证明美国主流媒体一边倒的正确?证明不了什么,只能证明美国左倾势力太大,只能进一步坠落和衰退。逆流有时也强大,就这么简单。

汉阳一江水:

我不想证明什么,只是实情分析,用另一只眼睛看看而已。各诉己见,百家争鸣,正反两面都须听,都须观察,才可能客观评价,兼听则明吗。不论是潮流还是逆流,人民选择为大。如果川赢了,就证明美国阳光灿烂?那要什么选举,一人领导,伟大领袖,千秋万代多好。

朋友:

你的文章都是在假设中,对已经被白左坑害的现状视而不见。委内瑞拉也是多数为赢,你就赞成支持?

汉阳一江水:

这那是那呀,你不如说卡扎菲、萨达姆当年全票当选来比较更好,为了一个老川,把美国人民创立的制度如此贱残,把8000万投拜的选民说成妖孽,也是奇观。

朋友:

老川就是上帝派来的使者,没有老川,世界一定会乱。千言万语,运动员作弊,就必须出局。明知存在做票,还能当成正常选举,这脸皮也太厚了。

汉阳一江水:

你认为作弊就作弊,你是上帝?

朋友:

你认为不承认就没有就作弊,你是上帝?

汉阳一江水:

我尊重事实,尊重法律,作弊不是你我说了算。也不是谁声音大,谁会骂,谁就真理在握。到目前为止,已判决的诉讼全是原告败诉。其他诉讼只能拭目以待。老川都相信美国法治,你们不相信?

朋友:

美国主流媒体骂过民主党?地方法院就正确?既然还在司法阶段,凭什么你就认定没有作弊?

汉阳一江水:

我没认定,但我认定疑罪从无,一切看有效证据,有法院和相关仲裁机关裁定。当然司法系统也坏,和民主党、左媒、大企业都是坏四类之一,美国真是堪忧呀,比一党专政还厉害。你要知道监督执政者是反对党和媒体职责,民主党现在是反对党呀,执政的是老川,掌握极大行政资源,媒体也有电视FOX、各大右派新闻网站和论坛,极力维护老川。你受的教育可能是好就是特好,坏就是特坏,能理解。

朋友:

莫非你拿了老拜后面金主集团的好处?完全无视现实,怎么和作弊者一个腔调。我相信老川和美国人民,好戏还在后面呢。

汉阳一江水:

你生活在自己的世界,听不得一丝不同意见。老川想翻盘已不可能,这没什么悬念。法院只是判决是否重新点票,无权判定谁胜谁输。另类洗脑,造成大家不能平下心来认真讨论,非白即黑,不是朋友就是敌人,真相不重要,立场最重要。这样看来,民主在中国任重道远,是我们这个民族很难享受的奢侈品。民主投票的核心就是你可以自由投票给自己喜欢的人,同时你必须接受你不喜欢的人可能胜选。

朋友:

说得义正言辞,其实就是一派胡言。拜粉除了胡搅蛮缠,强词夺理,还会点什么?

汉阳一江水:

给我贴标签呢?首先声明我不是拜粉,咱中国人,关心一下美国选举,学习一下民主运作过程和方式,不会粉什么人的。

朋友:

老拜上台,主要代表权贵利益,而老川主要代表广大人民利益,所以我支持老川。

汉阳一江水:

矛盾呀,你们说老拜是极左,过分照看弱势群体和有色人种,搞大医保,逼富人交税,怎么又代表权贵利益?又是华尔街走狗?又是共进会的玩偶?如果把幸福寄托在某一个人身上,这不正是对民主最大的嘲讽。你可以喜欢老川,你也可以讨厌老拜,但民主不需要救世主。

朋友:

那个国家的民主不是靠人去推进的,人很重要。没救世主更没希望,虽然从没当老川是救世主,但总不能弄个混蛋上去吧。

汉阳一江水:

科学的力量,制度的力量,人文的力量,民众的力量才是真力量。还是那句话,混蛋不混蛋不是你界定的。民主国家,即使一个坏蛋上去,受制约也乱不了。不民主国家,就是一个救世主上去,也会走向独裁。

朋友:

你闭眼不看,美国已经滑向一党专制了,美国已经快新闻联播了,舆论已经一律,大学也开始了,好莱坞早就开始了…只有傻瓜才坚持美国200年制度…

汉阳一江水:

你们曾说美国是最大的民主圣地和灯塔,而且现在老川和他的共和党还是执政党,不少联邦州也是在共和党手里,实行的市场经济,看重的是契约精神,诚信是整个社会的基石,为了老川,你这么糟践它,有意思吗?

朋友:

现任总统被舞弊夺走位子赶下台,还能有屁的个制衡机制啊?你可以不喜欢老川,但你不能因为不选老川就去选老拜这坨屎。

汉阳一江水:

除了骂人,你还会什么?

朋友:

作者的观点,可以说与群里大多数人相悖,多数人反对,自己也不开心,何不找一个气味相投的群去大放阙词呢?这不明摆着自讨苦吃!

汉阳一江水:

一伙三观相同的人自己群里狂欢,可以尽兴, 最爽的是,从此只有赞歌,没有刺耳的声音。最大的问题是,出了这个小平台圈子,这些各自成见熏陶得越来越深的人,如何沟通、理解和妥协呢?总不能动不动就来一场你死我活的阶级斗争来解决分歧吧?那和专制有什么两样。

朋友:

说什么媒体是监督执政党的?呵呵呵,直到今天,我没有看到一篇攻击拜登的。但在川普上次赢了大选后,媒体就没有停止一天咒骂和根本不承认。美国主流媒体早已被民主党控制,早已是民主党党报。骂了4年了,近期川爷完全是处于放大镜下,被抹黑被妖魔化了,无所不用其极,连大小姐小时候喜欢放屁都登出来了,而败登的所有丑恶都选择视而不见。美国一个声音,你就很喜欢?

汉阳一江水:

首先共和党不是傻子,是执政党,参议院多数党,控制全国一半以上州政府。第二,一言堂只是你的个人感觉,美国没有那么多敏感字,推特的CEO虽有政党倾向,但论坛网站很多很自由,发声的地方很多。川普的军师班农离开白宫后就办了自己右派新闻网站,发表很多轰动内容,也没见人干涉关停。第三泰国缅甸军人掌握媒体、财物和权力,可一旦开放美国式自由选举,他们就一定输,从无例外。马来西亚印尼华人掌控财富金融多年,但华人政治地位始终低人一等,因为选举不是财富所能撑控的。(马来西亚建国时马来人与华人1:1现在是2:1,华人富而少生子,移民国外也多)。南非就更不用说了。一个声音在美国?你说出来怕你内心都不信。

朋友:

挺川是挺什么,挺的是公平、正义、合法,你们以为你们没有自带立场进群发表言论吗?关键是立场观点言论是否基于事实的基础上,是否符合普世价值观,是否体现出公平合理,是否对他人对社会有所成就,不是说一定要弄出另外一个声音或者更多的不同的声音,这个不重要。如果非要弄出不同的声音,而罔顾事实,不分青红皂白,抛弃是非观念,那就根本站不住脚。

汉阳一江水:

我和群主是老朋友,是他邀请我进来的,没有阴谋阳谋。我不喜欢一言堂,弄得非我族类其心必异。允许别人和自己不一样,允许自己和别人不一样,宽容宽解宽松最重要。左或右,只要走向极端,都是一个毛病,听不得不同意见,美其名曰三观须一致

另一朋友(群里异数):

很多朋友有一个误区,认为选举结果是由法院最后判决决定,认为现在川建国律师团队在法庭的案件是决定选举结果的诉讼。

你们可能根本不知道,或者装作不知道法庭中的案件是什么,说以法律和事实为准;但事实是川律师团在各州法庭上没有事实证据,几乎全部被驳回、败诉或者自己怕惩罚而撤诉。

华人挺川者们以为那些阴谋论都是提交给法庭的证据,等着法庭辨别真伪,所以现在不能轻易否认。事实是老川律师团们根本都没敢把那些荒唐的阴谋论交给法庭!如果律师胆敢在没有证据的情况下把荒唐的阴谋论交给法庭,恐怕执照都要被吊销了。

按照华人挺川者们的逻辑,无论阴谋论多么荒唐、多么没有证据,也应该等待而不能否认。这很荒谬,不是?

一亿多人的投票,应该会有零星的舞弊,但我相信,大规模的舞弊,美帝的司法会启动调查的。

挺川没有错,但你们要让人发出不同的声音,

其实我到现在还是一个川粉,但我最近一直在想,美国为什么个个部门都会阻碍川普?联手造假?...渐渐的我发现,美国人民没有那么高的政治觉悟,谁上台能给他们更多的承诺、实惠他就投谁,就是这么现实,至于谁犯了罪,会有社会与司法部门给予处理,不用老百姓来操这个心。

这群已无法讲话了。您讲的还是观点,我连发消息都受攻击了。

以前的对话一段

朋友说:

如果有偏向性,描述的客观事实也会自觉或不自觉的选择有利于符合自己观点的,不合意的客观事实可以不提。

汉阳一江水说:

这话没错,但法庭内容,不论那个人有什么偏向,不敢编造,最多不说。迄今为止还没有听说有任何可以在法庭上展示,可以作为证据的东西,所以老川那边就从不说开庭的结果。

朋友说:

我可以不说假话只说真话。但是对我或我的论点不利的真话我可以选择不说。我现在不确定哪方会赢,虽然感觉拜登赢的可能性稍大一些,再等等看吧。

汉阳一江水说:

所以兼听则明。根据双方提供证据,再看法院判决,自己判断。总之,不能只听其言,要铁证,要事实,感情是一回事,真实是另一回事,千万别让自己陷进怪圈出不来,持中立立场才能准确分析选情。

朋友说:

这个音频表面上似客观中允,但骨子里的倾向还是非常清晰的,代表的是左媒,厌恶川普的一切作为,并认为川是没落、衰败的代名词,对抗的是时代发展潮流。但他的这种判断能否得到验证,看来还有待时日。

汉阳一江水说:

不要贴标签,凡是不满意老川的就是左媒,就是反动势力,那7900万普选选民情以何堪?同样赞美老川的,也不是没落、衰败的民众,7300万普选票,那是巨大民意。自由选举,多数为赢(美国是选举人票),但不代表少数就是错误,更何况差距就只有600万区区小数。

朋友说:

站在局外看美国两党争夺总统大位,确实是一种幸事。何以这么说?因为对国内瓜众而言,如同身临其境般地参与了西方社会的选举,而选举结果又不是预设的。那跌宕起伏的情节,让人有一种欲窥究竟的诱惑。但愿选举结果是美国民众意志的真正表达。

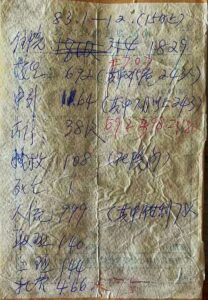

汉阳一江水说:

这是最正确的态度,学习,学习,再学习,这是一次学习教育培养公民意识的机会。

朋友说:

7900万张选票可能还包括投票软件做票吧?

拜登当过8年的副总统,政绩平平,而且家族贪腐丑闻不断,连自己儿子都管不好的人,在美国能有如此高的人气,不能不让人存疑。

汉阳一江水说:

美国人他们都认为7960万普选是真实的,包括一半以上老川拥护者,老川本人也对普选票没有疑义的,他是质疑选举人票,百分之八十投老川的人也质疑选举人票,认为是老拜窃取。

所谓软件事件已被当事公司和政府相应机构双双辟谣,是无中生有,包括所谓美特种部队搜查那家公司在德国的服务器之类荒唐阴谋论流言。

普选票误差不会超过五十万,我们的自媒体大数据分析也和这结论一致。

你是因爱屋及乌,我们是科学分析,民主党本在美国就有社会基础,不然怎会有两党轮流做庄呢。不是老拜有什么人气,而是反川有一定群众基础。

朋友说:

我不是爱屋及乌。对于美国大选,我更关注的不是哪个人当选美国总统,而关注的是美国的民主制度是不是还切实可行,关注的是美国的法制是不是还公平,关注的是总统是不是真的由老百姓选票选出来的。如果程序产生了错误,结果肯定是不对的。

美国是很多人的希望,美国的民主被玷污了,将是全世界的悲哀,

美国民主制度沦陷了将会让全世界失去希望。

美国民主党大选舞弊已经是不争的事实。

汉阳一江水说:

所谓舞弊没有铁证,以讹传讹,经不起法院审核。难道只有老川当选,美国制度才伟大?美国法制才公平?大选才没有舞弊?这本身不就是否定民主,否定法制的行为,不也是一种变相的作弊吗?

朋友说:

当年尼克松的水门事件也有不少人说是无稽之谈,最后呢?现在不要急着下结论,更不能说是无稽之谈,你说对吧?

汉阳一江水说:

你这是偷换概念,有幸存者偏差。

我不是急着下结论,美国民主制度经过两百多年千锤百炼,我对它十分有信心。一个无能人可以当总统,但这个制度保障其正常运行。三权分立,两党制衡,自由选举、军队国家化,媒体私立化这些根基是难以动摇的。

朋友说:

老弟,根据我的判断,拜登不可能当上这个总统了,我觉得他们造假太多了。

川大爷也不会轻易让位,他是个越战越勇的人。

汉阳一江水说:

这是典型的自闭,在自己小圈子内自娱自乐,有老川的风格。

你我都决定不了谁当美国总统,只有美国公民才有权选择。

我与你意见相反,我个人认为老川只要老拜上位后不清算他,他一定会交权。他有一大批拥趸者,会在共和党里继续发挥巨大作用。而老拜也不会或不敢清算他,虽然老川有几百个诉讼等着他,但老拜胆小,不会乘胜攻击,他怕清算前任造成恶例,也恐国家走向混乱。不过司法独立,有些事他也控制不了。

朋友说:

老弟啊,你不相信有他人会插手,你真的太不了解中共了

汉阳一江水说:

我不但不相信中共插手可改变美国选举结果,也不相信俄罗斯插手可改变美国选举结果。

你把中共看得太高,想得太神了,他现在是保权保位,维稳是第一要务。专制与民主两个体制在世界民众中的影响力是不可同日而语的,完全不是一个数量级,是无法抗衡。甚至在贫穷伊斯兰国的民众中,双方差别也很大。

朋友说:

如果是世界第二经济强国啊,又是命运共同体倡导者,能量应该不小。

汉阳一江水说:

你如果相信中共宣传,那不就傻呢?我们有时也说自己是发展中国家

软实力,明白人一眼就能看出,谁在世界老百姓心中的分量,即使华人的新加坡、香港和台湾那里也一目了然。

我们如果真厉害,就不会四周都是敌人,世界没有朋友,靠大把撒钱获得一点自我满足。

朋友说:

如果拜登上台,立马沦陷的是香港,接着就是台湾。我敢打赌,老拜对我们有畏惧的,我们握有他的把柄,我们会更加肆无忌惮。

汉阳一江水说:

你先入为主,太杞人忧天了。民主党对人权、民主、自由、公平的理念比共和党强,他们普遍同情维人,藏人,港人和台湾人,对持不同政见者更友爱、更关注,更支持。

朋友说:

永远不要低估专制和左派的恶。

汉阳一江水说:

在美国,民主党基本盘本就比共和党大也扎实,共和党基础是中下层白人,以农村为主,这个趋势仍在扩大,大学生基本上反川为主流。要相信民主,相信群众,相信制度。

说实话,川粉有时真像传销组织的翻版,任你摆事实讲道理,就是说服不了他们。他们说拜登造假证据堆积如山,至今没有确证。他们却坚信老川一定翻盘。这是另类传销组织!

朋友说:

川普团队拿出的大选舞弊证据不一定百分之百的准确,但是也不可能百分之百的假的吧?这几年让我看到许多真相,改变了我很多认知。

汉阳一江水说:

有真的,但不影响统计学数据,也就是说不影响大局。一个涉及 1.5 亿多人口的大选,找出这些瑕疵是不难的,但利用这些瑕疵去颠覆大选结果,也是不可能的。老普7300万拥护者,他们有能力提供大量似是而非的嫌疑证据,即使一百万份,也是轻而易举的。关键是能否当成为呈堂证据,是否能颠覆选举结果。

朋友说:

大多数挺川派在言论行为上并没有偏执,坚守自己的信仰没有错,但我们从来不将自己的意志强加于别人身上。反过来,那些反川派倒是总想让别人接受自己的观点,和他一起反川,否则就说别人愚蠢,这才是偏执!再次,那种以成败论英雄的人是几千年中国文化的熏陶所致,川普即使败选了,也是英雄,喜欢他的人也不是愚蠢!作为一个生活在围墙里面的人,我们看到的大多数信息都是左派言论,像我们群里少数人好不容易翻墙出去看到一些华人民主派的言论,怎么就成了偏听偏信?!难道真的要对这少数言论也闭上眼睛捂住耳朵,才算是没有中招?我觉得,这才是可怕的想法!

汉阳一江水说:

没有人说你们偏执,只是民主社会,必须接受失败的准备,至于谁是英雄,谁不是英雄,那是个人评定问题,我认识不少华人民主派,有拥川的,也有反川的,那不是衡量人品、智力和道德好坏的标准。谁都没权力把自己意志强加于别人,自由选举就是忠于内心,就是个人意志表达,就是选择,没有谁对谁错。

朋友说:

我怎么感觉你是个坚定反川人士?

汉阳一江水说:

我不是,我对两位候选人都无好恶。

关键是现在的国内社交媒体主要是川粉天下,官媒公信力总是有那么点小问题,据说官方有点反感老川,但官媒没有得到指示,谅他也不敢多加评论。所以国内,某种程度上基本是一边倒,看不到相反观点和客观评论。我有点看不过去,为了纠正一些含有个人感情的假消息,写了一系列文章,不是以正视听,而是给大家提供从另一角度去思考问题的客观材料,仅此而己。就这样,我也逃脱不了被其中两个群踢出去的命运。

朋友:

美国的左媒已经失去了中立,公正的立场,他们都沦为民主党的党媒了。

汉阳一江水:

在西方,媒体生存在观众,两党没那么多钱收买媒体,也收买不了观众。举个例子,一个大外宣多维网,是何频先生在国外创立的。刚开始网站相对独立,观点相对中立,这个网站在海外很受欢迎。结果党国花钱收购,排挤何濒,彻底掌控。结果呢?网站点击率下降95%,影响力大大不如以前,成为一小撮人内嗨的地方。所以在民主自由世界,靠钱收买媒体,长期不客观报道,几乎都会遭读者听众吐弃的。左媒要生存,资本也不会那么傻,所以西方主流媒体比自媒体报道更及时更客观,不会胡扯八道,他们更爱护自己羽毛。观点可以不同,事实不可变改,大事件更是实时实况跟综报道,不然不论左媒右媒的主流媒体在那个世界都无法生存发展,这是大环境的力量,制度的成果。

朋友:

美国的党派确实没有钱收买媒体,但是媒体后面的金主就是民主党价值观的支持者,不需要党派拿钱,左媒肯定支持民主党。

汉阳一江水:

在美国,法律规定政府政党不允许拥有媒体,美国之音虽然是美国政府办的,但不允许对内宣传广播。民主党和共和党都可以设法去影响媒体,如果大部分媒体偏向民主党,那么是共和党自身有问题了,毕竟,老百姓是媒体的衣食父母,媒体的倾向也代表一定程度的民意。

朋友:

你的看法是初心,现在的媒体变味了。

汉阳一江水:

我朝连东方明珠,一个不到千万人城市的民主选举都控制不了,一旦一人一票自由选举,某些集团哪怕有钱、有财、有权、有物和有媒体,都没用的,一样都会选输。说某党或某国操纵美国大选,那是太高看了,把自由选举和独立媒体说得不堪,好似美国和独裁一样,专制专政,一个声音,无所不为。

朋友:

东方明珠的选举确实他们控制不了,但是他们可以毫无底线的改变整个东方明珠的政治格局啊,操纵和改变选举结果是美国政客手段,天朝认为小儿科,不屑一顾。老弟,我不是阴谋论推崇者,但是我不是天真的傻子。

汉阳一江水:

即使改变格局,也控制不了选举,如缅甸一般,一选就输。

操纵和改变选举结果是美国政客手段,你这是否定200年美国民主制度,也是否定文艺复兴以来,民主世界建立在信用基础上的法律体系。像香港那样,规定只有一千多人选举特首,美国政客可没那么大力量。民主自由国度,政党操纵只能是局部的,全盘操纵是不可行的,这点他们远比不上专制体制的执行力。

朋友:

我说的是这一次的美国大选。

汉阳一江水:

难道美国这么制度,一次自由大选就彻底变质,这还是世界的民主灯塔吗?

朋友:

美国如果被民主党执政,很可能被沦陷了。不信,看看拜登登上大位以后的表现吧。

汉阳一江水:

拭目以待,美国总统不是终身职务,没有那么重要,美国制度也不会一次选举就推翻了。人文的力量,科学的力量,体制的力量远大于总统的力量。现在已经有不少人认为世界末日降临,支持老川还是反对老川就是最后宣判前的人妖之战,是神给人在神魔之间最后的选择机会。而老川是天选之人,有如基督再世。让人哑然,这样的社会状况,连向往民主的我们看来都是消受不起的奢侈。

外一篇:

老川狂热支持者的逻辑偏差

逻辑偏差在于只关注筛选结果,把筛选结果当全部结果,忽略筛选条件与筛选机制等信息。

老川狂热支持者总是先入为主,遇到不同的意见时,不分对错,不顾事实,不去分析,基本拒绝接受。幸存者偏差现象非常严重,缺乏逻辑推断,坚持选择性思维,罔顾事实,以立场来检验一切事物的好坏,陷入严重的逻辑偏差之中,不能自拔。

不用科学的方法论去分析事情,就不容易分辨真伪。

逻辑混乱,偷换概念是老川狂热支持者最常见的表现。我和他说老川不可能当选,他和你说老川做了多少伟大业绩;我和他说老拜没大问题,他和你说老拜儿子是罪犯;我和他说我们应该多学习人家的选举制度,选举程序和选举经验,他和你说美国选举已经不公,已经腐败没落,只有老川能救美国。总之,正常对话,摆事实,讲道理几乎不能。

这次美国大选,老川支持者们早已认定,民主党是极左势力,老拜是罪犯,主流媒体被控制,华尔街兴风作浪,机器计票软件有问题,大规模作弊真实存在,政府和司法系统已经堕落等等。

甚至他们中有部分人坚定相信FBI立案,索罗斯、希拉里、奥巴马被抓;美军袭击德国某公司数据处理中心;一千多亿美元收买伊朗,拉登还活着;马上就要重新选举,拜登宣布退选;朱利安尼被任命联邦调查局局长,民主党一伙末日来临等。如果这一眼就能看穿的谣言他们都能相信,这就不是认知问题了,而是智商有问题。

整日信谣、造谣、传谣,看那些海外华人民主派江峰先生、天亮先生等拥川自媒体胡言乱语,墙内川粉根本不核实内容,也不认真分析,人家说什么就信什么。甚至相信这次选举是正义与邪恶,光明与黑暗的决斗,誓死捍卫川大爷,人类进入生死转折点。

民主体制不存在成王败寇,胜选不等于正确,败选不等于错误,只是民众现在更喜欢谁而已,毕竟总统干得再好、再正确最多也只能八年任期,真的没那么严重。

海外某些中文自媒体最大问题是把自己对某集团仇恨置于事实之上,不择手段,因为川普看起来更强硬,比以前民主党政府更有效地打击某集团,因为喜爱,就失去了正常分析判断,得不出符合实际的结论。

更让人不解的是:老川说让民众注射消毒水抗疫、号召不戴口罩、散播“新冠是民主党的阴谋”,推荐的氯喹真的是特效药,霍普金斯大学公布的新冠病人数被人为扩大,不屑专家建议,不把新冠当一回事等等这些荒唐谣言,我们墙内老川支持者都能坚信不已,他们可是刚刚从疫情中过来的,有切身体会,但仍然不能让他们明辨是非。

民主党是被划为左派政党,但与我们国内认知的“极左”风马车不相及。美国传统左右翼政党每隔几年,交替上台,就是便于纠正对方偏差,来保证社会正常有效运行,二百多年来都是如此。有比较才有选择,选举才有了对象,公民才有了选择权利。两党在民族关系,平等公正、种族主义、人权价值、宗教主义和福利事业上有很大差异,尤其是桑德斯等北欧民主社会主义价值理念,与共和党差异更大。但他们都认同民主体制、自由选举,司法独立,多党竞争和媒体私人化等核心价值观.,这才有了美国二百多民主法制的发展和完善。把民主党丑化为“白左”,甚至说民主党上台,一定会与汉语圈某集团狼狈为奸,一定图利于华尔街和垄断资本,美国一定会走上独裁,就会走全面封闭的查维斯道路,就会衰落,危言耸听,既不准确,也不客观。举一个例子,你说人家极左,而极左政策主要表现为要公平不要效率,这与华尔街、垄断资本利益有根本冲突,可你又说华尔街大资本做他们后台,能把两者利益完全对立方混杂在一起,也是奇特。民主党推TPP、亚太再平衡、气候问题、伊朗问题、对人权的关注以及国内的全民健保、移民问题全遭到诽谤、歪曲和诬蔑。

老拜是罪犯,是犯罪集团核心人员

今年大选前他的小儿子亨特·拜登遭到朱利安尼等人制造的“硬盘门”指控,被诬陷性侵CN幼女。值得庆幸的是,FBI经过调查已经表示没有发现问题。还有乌克兰事件,也在媒体上炒得沸沸扬扬,他们被逮捕的谣言时常传出在各大微信群和朋友圈里,以表明老拜的犯罪分子的嘴脸。民主党层层竞选上来的总统候选人,不仅仅是老年痴呆,还是个罪犯,你信吗?这样的政党在美国生存百多年,风声水起,美国人民也太没水平了。

又说老川的子女如何如何比老拜的子女优秀,这与老拜竞选有什么关系?老拜和他小孩都是退役老兵,而老川他们呢,比较这有意思吗?拜登这辈子生活坎坷,他从小口吃,为克服口吃,吃了不少苦。第一任妻子在生下女儿不久后,因车祸去世,母女双亡,两个儿子身受重伤。2015年时大儿子博·拜登不幸因脑癌去世。直到现在七十多岁老拜才得到了成功的机会,非常的励志。

可有老川支持者,一个我很尊重的群友却这么恶狠狠地说:在美国根本就没有挺拜的,大家都知道老拜就是一个臭狗屎,左派主流媒体不顾投票人分歧如此之大,霸王强上弓,硬说拜登赢了大选,想造成既成事实的舆论假象,忽悠老百姓,林林总总的美国媒体越来越像大鸡国了。拜粉听好了,说到底,我们不关心是谁来当下一届的美国总统,我们关系的是,美国是不是还有真正的选举,美国的选举是不是有舞弊,美国的那盏灯是不是还亮着。感觉挺拜者,拾人牙慧,不明事理,只要是美媒谎言都奉为圣旨,自己有脑子吗?美锅里的老鼠屎还少吗?

可是右媒FOX也说了拜登赢了大选呀。

主流媒体被控制,全是黑川的,不可信

可你们也可以看FOX、华尔街日报呀,主流媒体也不清一色是所谓左派,还有各类新闻网站,个人平台和各类论坛,还有自媒体,都有不少挺川的。那个老川前军师班农办的新闻网站,有声有色,也没封呀。为何只信那部分华语自媒体的那些谣言?他们就一定客观准确公正。美国大媒体有左中右各种立场,这不假,但这仅限评论。对于客观事实的报道,是不会公然作假的。比如普金发贺电,主流媒体一定会播,如果发现与实事有出入,俄普没发电报,他们一定会更正致歉。忠于事实,这就是主流媒体获得信任的保证。至于如何评论电报这件事,各个主流媒体就各不相同了,一般正反两方意见都有反映。想想看,当年正是这些主流媒体紧咬着克林顿性丑闻,深挖细节,穷追不舍,才让克林顿颜面扫地。而克林顿不就是情欲四溢,感情出轨吗,这在大鸡国算事吗?他并没有因此而搞利益输出,也没有给对方一个大项目,更没有给大把大把美钞塞给对方,没有强迫、双方自愿,连性骚扰都算不上,结果被媒体弄得灰头灰脸。另外,老拜儿子偷税立案不也是这些主流媒体揭发的,公众是媒体衣食父母,媒体生存在观众,两党没那么多钱收买媒体,资本即使想购买媒体也要有利可图,那个财大气粗能购买全部主流媒体。举个例子,一个大外宣多维网,是何频先生在国外创立的,刚开始相对独立,这个网站很受欢迎。后来党国收购,排挤何濒,结果呢?点击率下降95%,影响力大不如以前。所以在民主自由世界,靠钱收买媒体,长期不客观报道,几乎都会遭读者听众吐弃的,左媒要生存,资本也不会那么傻,所以西方主流媒体比自媒体报道更及时更客观,不会胡扯八道,他们更爱护自己羽毛。更何况大资本家包括军火商有不少倾向于共和党,怎么可能舆论一律,一统天下。资本不会为了政治,忽略利益,不顾媒体死活,那投资的股民还能容忍吗?美国哪一个当政总统,在位时不被媒体鸡蛋里挑骨头?媒体监督执政者,这是美国传统。新闻自由是言论自由最重要体现,老川经常破口大骂记者,挑战新闻自由的底线,你不遵守规则,贬低媒体,大嘴巴乱说,自然会遭到抵制。

华尔街操纵选举

11月3日。请记住这个日子。这是美式民主最值得标榜的24小时,也是美式民主最遭逢唾弃的24小时。只要不是川获胜,就是有人操纵选举,黑手就是华尔街。

资本真有这大魔力,尤其在民主囯家,我真怀疑。二十几年前我受马来西亚华人朋友邀请,去马来西亚他的公司考察。闲谈中我的朋友告诉我,马来西亚建国时,马来人与华人,一半对一半,现在是三分之二对三分之一。马来华人一般比较富裕,大城市尤其是首都,华人占多数。经济在以前,基本是华人控制,华人勤劳聪明,有经商头脑,但生育能力远不如贫困的马来人,后来华人又大量移民加奥等国,造成华人在马来西亚成为少数民族。在马来西亚,法律明里暗里都非常歧视华人,设了很多框框,加了很多限制。这与我过去认可的理论相差极大,这那是富人说了算,民族的力量,选民的力量远大于财富。至于他的邻国印度尼西亚,华人虽然也拥有财富,但有时连生命安全都没有保障,穷人仇视富人力量更强,华人基本上登不上政治舞台。南非更是最典型一例,富人曾经都是白人,一选举就失去舞台。再看看缅甸泰国,他们的军政府控制政权、经济、媒体和军队,但一旦民主选举,军人政权一定会下台,试了多次,无一例外。

所以在民主选举制度下,政权、经济、媒体和军队不是万能的,也控制不了选民投票意愿,尤其在多党轮流执政,诚信成为普通大众最大公约数下的美国,操纵选举就更是天方夜谭。

机器计票软件有问题

大选之后,关于“多猫腻Dominion”这个投票软件公司的谣言特别多。“多猫腻Dominion”投票系统的舞弊嫌疑的主张的证据在司法诉讼截止日也没办法拿出来,还有联邦调查局与海豹突击队在德国法兰克福为争夺“多猫腻Dominion”作弊系统所发生的冲突,还说这次冲突共死五人,真有这事吗?后来说德国法兰克福那个软件公司叫Scytl,不是“多猫腻Dominion”公司。这么大的事,美国主流媒体没报道还有点说辞,但德国媒体也无声无息正常吗,外国军队在德国大城市里公开这么恣意妄为,民主化的德国会放任忍受?只有自媒体在那狂吠,尤其是华语自媒体,这还不值得怀疑?你们能量比哪些专业新闻工作者还敬业?不可思议。

现在又说密州多米尼系统法院出了审核报告,可你从哪里看到的那份法院的报告?你怎么能确认这份法院发布审计报告这事是真的?

老川曾在11月12日发推指称:Dominion在全国范围内删除了270万张投票给他的选票。称:Dominion在宾州将22.1万张选票从投给川普转到了投给拜登,94.1万张投给川普的票被删除,等等,老川这一推波助浪,Dominion公司就成过街老鼠了。

其实,这事很好查验,我们搞软件的都知道,软件有问题,人工验票,一核对就一清二楚。乔治亚州真的就核对了,乔治亚州的检察长ChristopherCarr是共和党籍,他在法庭回复动议中说:乔治亚州非常仔细地对所有选票进行了三次重复计票,其中包括一次史无前例的百分之百的手工计票。结果仍是铁证无可辩驳:没有疑义地确认了拜登获胜。连摇摆州都否定了,其他州还有作假的可能吗?

米国国土安全部网络安全和基础设施安全署发表的声明:没有证据表明投票系统删除和篡改和丢失投票。还声称:2020年大选是美国历史上最安全的投票。

对共和党来说,目前首要任务,是阻止邮寄选票常态化,守住自己投票率的优势。如果民主党尝到甜头,今后每次大选都想鼓励邮寄选票,对共和党将是灭顶之灾,所以共和党才默许这么闹。

大规模作弊真实存在

川总统说舞弊就是真舞弊了!我们相信老川要相信到迷信的程度,我们服从老川要服从到盲从的程度。所以很多人脑子里深深印刻着老川是伟大领袖,一句顶一万句,不可能讲假话。老川说了有大规模舞弊,那就是肯定有。先设立了前提,后面的所谓逻辑自然都有问题。

经不起求证。老川团队就差没挖地三尺找证据了,结果很难拿到法庭上去。想想这种作弊是重罪,谁敢做假?而且是大规模,这需要动员多少人力物力,还要保守秘密。关键是只在总统这一项作弊,其他选项,包括参众两院,地方议会和地方领导都保持正常选举,这也太难了。

关于朱利安利在听证拿的那个铁证视频,据说相当于“记录了银行劫案的录像带”。 这一视频还得到了老川本人的转发。但州务卿办公室高级官员、佐治亚州选举经理、共和党人Gabriel Sterling说:“没有神奇出现的选票。这些选票都是在监督员面前处理的,也在当着监督员的面放在那里的。” 他说,川普团队正在做的是“故意就选举之夜State Farm体育馆发生的事情来误导公众。他们也有整个视频,但却忽略了事实。”亚特兰大当地电视台WSB-TV2的调查记者Justin Gray为此做了深入调查,逐帧回看了11月3日早上8点到午夜的监控视频。他的结论是“没有不当之处”。

至于“拜登曲线”,已有专家详细说明,我不再多说。

至于那些流传甚久的可笑谣言:数州选票大幅超出选民总数;宾州一次性丢失三十万张选票;威州暂停计票后,重新计入的十二万张选票,没有一张投川普的;密州某地票数后面多加了一个0;多地出现死人选票;某些投票点不让观察员进入;佛吉尼亚50万缺席选票是假的;俄亥俄有5万选票是错的;新泽西、肯塔基州、威斯康辛州都在垃圾桶里发现数百封邮寄选票。信了你就傻了,就不用分析了。

更吓人的故事是:五百万人投了1900万张票。一看就假。

美国的选举制度不是摆设,有反对党,有国外观察团,有各种媒体,有独立选务机构,有司法系统,想大规模舞弊,可以说门都没有。

在野党作弊,执政党眼睁睁看着,无所作为,如果真是,也太不正常了。

政府和司法系统已经堕落

法院受到压力了?几乎被利益集团控制了。

听证会开的再多有什么用!最高法都不敢接手这个案子!高院的法官们个个噤若寒蝉!官司全都失败了,没有一条被法院采信的证据,那这说明什么呀?都被收买了。五十多场诉讼失败,那么多法官丧失职业道德,甚至老川的诉讼律师受到不公平待遇后,也不敢申诉,更不敢去媒体曝光,这是多大势力呀。

川普在2016年说过要抽干“华盛顿沼泽”,“华盛顿沼泽”其实是一个隐形政府,一个纵横交错的精英圈。这个隐形政府,最近爆红的某学者说得很透彻,它包括:美国军方、美国情报系统、美国国务院、美国财政部。

所以要革命,要用枪杆子去推翻这可恶的堡垒,抽干这罪恶的沼泽地。这个其实是在某种程度上,让人感觉时光倒流,和希特勒很是相似,语言都有些近似,鼓动性很强,这不是好苗头。

有人说老川在下一盘大棋,等着吧,抽干沼泽后,估计还会有人叛变的,等到1月6日会全暴露,国务卿可能是川总身边最大的、隐藏最深的“黑手”,也可能黑手就是彭斯。到时可一网打尽,从此千秋万代,一统江湖。

民主党太邪恶了,老川伟人元月二十日那天也极有可能被民主党收买,到最后连老川也叛变,那可咋整啊,这是笑话。

有关选举人,最近又疯传谣言,说关键州搞两套选举人团,两套投票,双方都超270票。

可美帝选举人产生有严格法律规定,只有一组是合法的。不然,各州失败一方,只有议会占多数,就可以另立选举人团,想投给谁就谁,那州公民投票有何意义?

只有在规定时间、规定地点、规定人员(此前认证的选举人团)进行的投票,方为有效。各州的选举人团,都是由该州胜选者所在的党自己指定的,州务卿负责认证,州长签字。州务卿、州长、议会、法院,总之任何人,无权改变。

三个州的共和党选举人团只是一个闹剧,表演给川粉看的,编造这些假消息太容易,戳穿他们太难了。

共和党参议会领袖麦康奈尔的表态祝贺老拜,川爷铁友俄国普金也发了贺电了,很多共和党参议员,起码一半以上,包括格雷厄姆有已经承认拜登胜选了。右媒FOX自己刚刚公布的民调显示,人家美国有超过60%的绝大多数认为拜登的当选“合法”,认为川普才应该当选的只有34%。

海外中文自媒体还会有什么新的说辞和段子?支持者们还想让川普咋演下去呢,说实话我真好奇

大选本就是一场公平的竞选,选举总会有输有赢,总是有人喜欢有人忧,竞争是残酷的,进入赌场,就是承认赌场规则,默认赌场公平公正,愿赌服输。

让一个喜爱的人永久唱独台戏,这还是那个我们曾经向往学习的国家吗?

就算有争议也要听法院判决,这都是最基本的常识,但经过川粉们一意淫,啥都成了阴谋,我真想不通为了一个川总,搞疯掉这么多人,不可理喻,完全走火入魔,完全失去逻辑思维能力。

外二篇:

2020美国大选答问

(注:汉阳一江水弟弟立委先生是资深大数据科学家,请到他来谈谈大数据与即将揭晓的美国大选的情况。)

汉阳一江水问:您好,感谢你抽出时间就中美选举有关问题,与我交流答问。

立委答:全世界,包括中国,都在关心这场世纪选举,它的结果影响的 不仅仅是美国的前途走向,也会对中国和世界产生巨大的影响。还有三天就是选举日了,有机会谈谈一路走来利用大数据追踪选情的心得体会,对于总结和验证其得失,很有意义。

汉阳一江水问:你作为一个大数据科学家,社交媒体舆情分析设计者和架构师,对目前两个候选人选情一定有自己的独到见解。我最想问的问题就是,川普和拜登到底谁会赢,赢面多大?有什么数据支持?

立委答:哈,谁都想知道答案,谁都不是算命先生。一定要给个赢面概率的话,迄今收集到的数据综合看来,拜登赢面大,应该有八成吧,川普不是没有可能,但几率较小。为什么,我们可以细细谈。

四年前,我的社交媒体大数据的自动舆情分析软件在大选前预警了希拉里选情告急,川普赢面急剧上升。当时主流媒体一面倒高歌猛进,没有相信川普有赢的可能。这两次的数据分析有何异同,是个很值得探讨的课题。

简单回顾一下当年的情况。2016年希拉里实际上是赢了300多万张普选票,但在遥摆州输了7.7万张普选票。根据赢者通吃法则,希拉里虽然赢了全国的人气,但结果是选举人票大输,川普创造了胜选者输普选票的历史最高纪录。有分析认为,如果参与投票的人数略高于大约1.37亿人,希拉里就会赢,可是当年的投票热情和投票率都很不理想。如今,专家们认为,投票率可能会达到1.6亿张左右,甚至更高,这大致相当于2018年中期选举创纪录的投票率,当时民主党以近1000万张的优势赢得众议院的普选票。四年前,在大选的最后三周,一切有可能让川普突围的事情,都发生了。联邦调查局局长詹姆斯·科米给国会的信,引人注目地在大选前11天重启了对希拉里电子邮件的调查,这对温和派和独立选民产生了显著影响。最终的结果是什么?在最后阶段,正如当时的大数据舆情调查表现的,川普反转了选情,最后两周领先希拉里不少。

汉阳一江水问:嗯,这次你这个分析与主流分析好像也差不多。

立委答:我们不必刻意与主流不同。一切要看数据,以及数据分析是不是有道理。

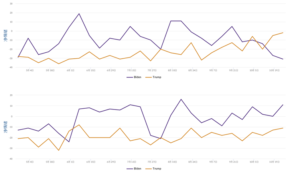

先给你看两张图的对比,都是过去半年大数据的舆情趋势图。第一张是推特数据;第二张是除推特以外的所有公开平台和社交媒体的相对应的数据。

我们看到了什么?半年舆情的前五个月,拜登一直领先,两套数据大同小异,趋势一致。但是近一个月来,推特数据显示出川普舆情的上升和拜登的下降。非推特数据却反映出拜登依然保持其领先地位。排除了20个坚定大州以后的非推特数据的舆情也做了调查,从6个月、3个月、一周、1个月到过去20小时,仍然全部是拜登领先。这与摇摆州的推特数据趋势形成反差。

排除推特以后的舆情曲线表明,是推特这个信源把拜登近一个月的颓势放大了。前五个月选情还没到激烈冲刺的阶段,网络的选情话题的活跃程度也远远不如近一个月,所以二者的差距不显。同样是社会媒体的公开源,为什么选战激烈了,就会出现这么大的数据差距?

今年的大数据自动分析调查让我颇感困惑。困惑的原因是我们做大数据分析,一开始是不分推特和非推特的,因为都是社交媒体公开平台,每个人都可以自由发言,理所当然认为它的总体是舆情的恰当反映。数据混杂在一起的时候,我们看到的趋向曲线,基本上就是第一张图的样子,所以感觉几年几乎就是2016翻版,历史再现,拜登选情告急,川普有很大的胜算。数据摆在那里呢,大数据不会说谎。因此在大数据分开为两套分别分析之前,我只能说,尽管传统民调和主流媒体一直在说拜登要赢,我们还是要宣告拜登选情告急,极有可能步希拉里后尘遭遇大选滑铁卢。

本来觉得也只能这样了,数据分析员只能让数据说话,解读不能偏离数据事实。直到昨天想到分开考察试试,这才发现舆情被推特主宰了,推特被大V主宰了,而大V中川普是压倒性的。他疯狂发推,泼脏水抹黑对手。他每次发飙,接着就是无数的转发和评论,总能掀起推特的巨浪。几乎每一个反拜登的舆情 top 5 的热词,追根溯源,多半来自川普本人,我们drill down多次查对证明了这一点。

必须承认 川普一个月来的造势非常给力,简直就是个造势魔王。他自己都说 我现在感觉太好了,我知道我肯定赢,一个月前我可不敢这么说。就是说他知道自己一直落后,只是进入造势状态后,看到他激发的基本盘的狂热,给了他信心。自从川普拼老命造势以来,有些传统民调也反映了川普有逐渐赶上来的某些势头。

民主党的拉票工作,今年也是异乎寻常地高。我本人因为认同全民健保的理念,登记了民主党。登记要求留下电话。近一两个月以来,我每天平均收到四五个民主党大佬的短信留言,持续两个多月了。所有的民主党大佬,拜登、贺锦丽、奥巴马、希拉里、沃伦(团队)都以老板的名义来留言拉票。民主党也在玩命,而2016 那次相比之下差太远了

汉阳一江水问: 为什么两套数据会有如此不同的趋势呢?今年与2016年到底有什么不同?

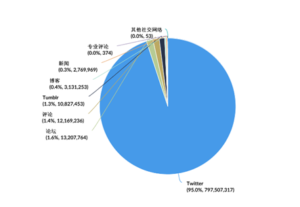

立委答:我们推测,推特由于数据量的压倒优势, 加上更新及时源源不断,实际上是掩盖了其他众多媒体的声音。这就是为什么推特数据的分析与全体数据分析的结果趋同的原因。看一下数据来源的分布图就清楚了。在这个可能是世界上最大的社媒舆情大数据自动分析平台上,虽然推特数据随机选样仅百分之十,其绝对数量也远远大过其他成千上万的社交媒体和论坛的公开数据的总和,约占总量的95%。

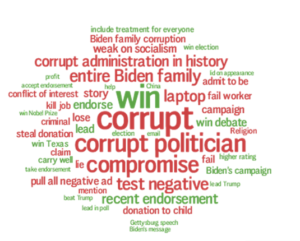

因此,如果推特由于其平台的特性而产生系统性偏差,譬如由于川普作为推特超级大V(川普推特账号的追随者高达八千多万),像黑洞一样很大程度上左右了推特的大选话题中的说法;或者民主党大V 如拜登和那个美女民主党议员AOC(Alexandria Ocasio-Cortez)主宰了其余的话题。那么其他人的声音就被稀释了。整个舆情就是围绕大V们转,其中川普推特治国的影响力最为巨大,完全是压倒性的。此前我们在做近期细线条社媒大数据的分析时,就多次发现,压倒性的正面或负面的舆情数据点中一多半,追根溯源几乎全部来自川普本人,然后被他的粉丝不断转发和发挥。例如,这几天批评拜登的一个热词是compromised(受到外力影响或支配的意思),数据溯源,原来是出自川普推文,说拜登会受到中国影响,毁掉这个国家。这与当年有人攻击川普有把柄在普金手中,会受到俄国影响一样,都是为抹黑对手,但产生了广泛的影响:24小时就占据了拜登数据的 6%.。

两套数据的不一致间接支持了分开分析研究的必要性。排除推特看趋势,提供了另一个非常重要的舆情分析的角度。换句话说,现在的大数据分析已经变成了下面的两种考量:到底是相信推特代表了选民民意更多,因此转化为投票结果更准确,还是其他的社会媒体反映的舆情更加真实?推特跟微博类似,那是一个粉丝的乐园。脸书倒是与微信类似,那是草根和朋友圈的天下,更多反映自下而上的民间舆情,但脸书数据量虽然大,但大多属于隐私数据,无法reach。退而求其次,我们就把包括脸书公开数据在内的成千上万的公开平台和论坛合在一起来调查。其调查的结论与多数主流民调相当一致,这个结果让我们有点惊讶:拜登在很短的间歇,有与川普接近的瞬间,但是总体上,拜登从来没有落后过。据老友说,其实民调接受了2016年的教训,也已经比以前更加“严谨客观”了,虽然还是有数据点采集不足的根本缺陷,但是克服了上次的一些重大失误。上次是完全随机采样,这次是根据上次投票的群体分层随机采样,而且有的问题不是问你投谁,而是问你会不会去投。

汉阳一江水问:民调和大数据挖掘分析都不简单啊,是不是应该综合起来考量?

立委答:对。在信息过载的人类现代社会,预测大选这样的全民参与的重大事件,本质上都是盲人摸象。分析师,无论是传统手工的调查还是借助大数据自然语言的自动分析平台,都是在提供数据分析的不同视角。

现在清楚的是社交媒体舆情大数据分析有两点价值: 一点是大数据对于舆情的反映更加及时,很多时候,但大数据指出舆情变化后,传统民调还在过去的数据中毫无知觉,但过了一个滞后期,传统民调有时候晚一步也跟上了。这事儿发生了n次,值得研究。第二点是大数据的对比分析和趋势分析,有前所未有的客观性。各种民调无法做对比分析,因为都不是 apples to apples,但是大数据平台一视同仁,在平台内所做的各种对比和趋势,极大提升了可比性。例如过去半年的推特曲线趋势前5个月拜登高歌猛进,大数据曲线反映出来的东西,与以前的各种民调的主流是吻合的。但是最近一个月来的选情变化,是以前五个月的选情的完全对等的延伸,数据源不变,算法不变,可比性决定了其相对趋势必须有个合理的解释。反转起始点是老川得病、出院。反转的高峰,一个是拜登儿子电脑门,第二就是大选最后辩论。在这些节点上,推特上拜登的舆情下降,震荡很大。下面是近一个月来的舆情纠缠:

总结一下。现在是两套数据,在讲两个故事,故事不同是角度和来源的缘由,都是可以解解的了,不再是一片混杂,茫无头绪。一方面,推特的影响力不能说不大,也不能小看其实际意义,否则所有的总统造势,都没有意义了。推特上的大V与粉丝的狂欢和嘶喊,实际上就是造势的网络版:每一场竞选造势同样是领袖指点江山,粉丝山呼海啸。如果相信奔波造势可以提升影响力,进而促进更多的选票(到底促进多少,其实大家也还是盲人摸象地在瞎闯),那就不能忽视或否定推特的舆情了。但是另一方面,推特的高音量也的确遮蔽了很多其他的声音,这些声音的整体毫无疑问也反映了民间实际舆情,可能反映得更为广泛和草根化,因为它不再是受大V主宰的情绪。这种声音和情绪所能转化为选票的潜力,自然更不能忽视或遮蔽。结果就是两套数据、两种分析之间如何平衡的问题了。加上其他非数据调查的因素考量(后面我们可以提一些供读者参考),最后 每个 well informed 的人,应该可以得出自己的 educated guess,我的guess前面已经说了,是拜登的赢面不低于八成。

汉阳一江水问:今年选举预测有什么难点?

立委答:今年的结果最难预测,因为出现了很多以前选举没有见过的状况,很多moving parts,所以合理的趋势分析或预测需要综合考量。说几点今年的选情特点,一是投票率在创新高。今年的总统大选空前激烈,美国选民在今年的投票热情,也远远超出了往常。截至10月28日12时,全美提前投票人数超过7000万人,是2016年大选同期投票的两倍还多。全美提前投票的选民人数已经达到了创纪录的水平。第二条是由于新冠影响,不得不大面积使用邮件投票和提前投票,这对高投票率有很强的推动作用,因为很多人不必排长队,也不必在时间紧张的投票现场匆忙投票,一切可以坐在家里从容进行,这使得往年对投票有畏惧或懒惰心理的人,开始投票了,选一位自己认为不是最糟糕的候选人。三是候选人川普本人的独特性,根本上说,这次大选不是拜登与川普对决,而是拥川与反川的对决

事件上看,拜登儿子的丑闻在选前十来天被爆料和发酵,也很大程度上左右了推特的舆情反转。这些状况给舆情大数据分析梳理增添了难度。

汉阳一江水问:社交舆情大数据分析有什么益处?

立委答:这是一场空前规模的经典博弈案例,值得后代和历史不断分析。大数据分析洞察,要获得marketing insights,需要仔细思考这中间的各种影响因素目前看来。数据本身及语言技术的使用,只是帮助我们多提供了一个以前无法达到的高视角,一个传统方式难以企及的高度。从量上看,社媒大数据的数据点大约是传统民调的三个数量级(!),并且可以提供不受限的任意时间段,对任意对象或对象组的任意角度切割的分析视角和可视化展示。利用大数据做舆情调查,弥补手工调查的缺陷和不足,是信息时代的必由之路。所有的这些调查分析实践都为我们今后更好地利用大数据工具提供了有益的经验和教训积累。

汉阳一江水问:今年投票人多吗?

立委答:热情空前高涨,美国人排队11小时就是要投票。

美国《时代》周刊近百年来首次“改名”,将“时代”二字改为“投票”——封面图片是一名脸部围着围巾的女性,上面画着一个投票箱,写着“投票”二字。

《时代》主编爱德华·费尔森塔尔称,“2020年充满了痛苦、艰辛、混乱和损失。然而,随着世界各国在新冠疫情之后开始重建,美国人也有独特的机会改变态度。” 与四年前相比,各年龄段的选民投票率都在上升,年轻选民的表现更是亮眼。这对拜登是利好,因为很多调查(包括我们大数据的分类调查)说明,年轻人、大学生、妇女与非裔是反川比例最高的几个群体。他们对川普和共和党漠视社会福利(如全民健保)、减税利益向富人倾斜,还有移民、环保等政策,充满了愤怒或不满。

今年的投票率,从各种来源看,都是最高。两边的选民都被激发了,但是川普的基本盘从来都是积极参与投票的,以前民主党的短板是其群众投票率不高。投票率高,拜登利好。

有分析称,百年不遇的疫情和美国现代史上最极化的政治环境,促使年轻一代迫切想要投身政治。截至10月26日,得克萨斯州提前投票的年轻人数量已接近2016年总数的三分之二。根据数据公司TargetSmart统计,与2016年相比,年龄在18至29岁之间的选民比例在北卡罗来纳州增长了13%,在亚利桑那州增长了19%,在明尼苏达州增长了36%。2020年是美国年轻人提前投票创纪录的一年。根据数据公司Catalist统计,在得克萨斯州、佛罗里达州和北卡罗来纳州等14个选举关键摇摆州,18至29岁年龄段的提前投票人数都有所增加,其中佛罗里达州年轻人投票比例是2016年的两倍。爱荷华州华人协会执行主席燕晓哲告诉《凤凰周刊》,大学生由于还没进入社会,更多的是从理想主义角度出发,因而更贴合民主党的主张,而已经参加工作的人会考虑纳税和公司运营等现实问题。非裔选民今年在全国多个地区的投票率都优于上次大选。以佐治亚州为例,截至10月26日,有超过60万名非裔选民投票,远超四年前同期的28万人;加州也有超过30万非裔选民投票,四年前同期只有10万余人。路透社10月初针对黑人选民的民调显示,拜登得到黑人选民群体72%的支持率,而川普只有9%。有分析认为,只要非裔选民的投票率能得到提升,对拜登是重大利好。这些不同的数据来源,都是大选趋势分析不可忽视的因素。

由于支持民主党的选民主要采取邮寄投票方式进行了提前投票,目前民主党获得的选票接近共和党的两倍。但这并不能作为预判结果的唯一依据,因为共和党选民更多的会在大选当天进行现场投票,悬念依然会保留到最后。对于川普和拜登两位总统候选人来说,即便到了最后一刻,动员投票仍是重任。在选情拉锯的一些摇摆州中,不排除压死骆驼的很可能就是最后的区区几万选民。

Biden的今年很多都是不会为Biden宣传的, 他们不喜欢Biden只是恨trump,这次Biden的投票人很多是实在受不了trump的。trump支持者这次比2016年疯狂,所以今年完全按照舆情数据预测大选结果是成问题的,需要与今年的这一系列特别的情况综合考量才比较靠谱。

汉阳一江水问:川普的选战表现如何?川普现象在历史上会留下一笔吗?

立委答:应该说,他是选战的天才,他的直觉对于稳固和激发基本盘有奇效。到了造势现场,他就好比换了一个人,完全是天马行空。他的气场,强过摇滚巨星。

如果川普败了,新冠和投票率上升(包括邮寄选票和很多州的提前投票)是主因。这两个异于往年的因素对他不利。换句话说,如果岁月静好风平浪静,川普赢得连任是大概率事件。他的能量、个人魅力以及他所代表的被遗忘的铁锈区基本盘,不可小觑。

他的 base 的确很厉害。他也确实换起了铁锈区被遗忘的角落和民众 让全球化现代化浪潮中被牺牲掉的边缘化人民,不至于自生自灭不留声息。这是对建制派官僚和精英社会的一次空前的挑战和警醒。我认为这是川普现象的正面意义和历史价值。劳心者治人的精英社会开始反思,改革改良的进步主义呼声越来越高。

汉阳一江水问:川粉也是今年大选的一大看点。

立委答:川粉一直就很热情,今年为甚。打了鸡血似的,看看造势现场就知道。川普说什么已经不重要,相互矛盾 胡说八道也无所谓,只要川普在上面做个手势,发个声音下面就是山呼海啸。

在谈到川普狂发推特时,第一夫人辩护说,对他而言,直接与人交谈很重要。她说,唐纳德是一名战士,他热爱这个国家,每天为你们而战。而这个国家的公民每天都可以通过社交媒体直接,即时地听到他们的总统说话,这在历史上还是第一次。

川普是造势的高手,他的基本盘很容易被激发,热情有余。但今年有一点很特别,实际上反川(而不是粉拜登)的基层民众,也跟川粉一样被前所未有地被激发。人家喜欢不喜欢拜登是一回事,讨厌川普是另一回事。这些川黑以前对政治是冷淡的,经常懒得投票。因为选票对他们是在两个都不喜欢的人里面选一个。但今年有所不同,街头持续不断的示威,包括“黑人命也是命”的运动,最大限度地激发了投票反川的热情。投票站的长龙,以及如此之多的早期邮寄投票,相比以前,其热情程度的确是从来没有过的。

汉阳一江水问:关于拜登儿子的电脑门事件您怎么看?它对选情有多大影响?

立委答:川普阵营算计好了日期,提前十天左右爆拜登家族丑闻。这是有经验教训为参照的。2016年川普的性录音的劲爆丑闻爆料的时间点略早了一周多,结果很快被大选前爆出的FBI重启希拉里的电邮门事件冲掉了,结果证明电邮门调查事件对于希拉里的伤害,远大于录音丑闻对于川普的伤害。但是今年因为疫情提前投票,料还没有爆完,票已经投完一半了,这是难以预测的今年的特殊情况。

卷入选举政治博弈的头面人物,从川普开始,包括朱力安尼,也包括布隆伯格等等,都是操纵舆论和挑动民众情绪的大师,他们知道如何去泼污水,搅乱视听。无论时间点选择还是操作手段。刚看了一下,拜登家族的丑闻炒作跟华信叶简明有关,不过这个人2018年就被抓了,据说是个骗子。这事儿的炮制过程苹果日报有卷入,有很多是非争议的某富商和川普前军师官司缠身的班农是背后推手,川普的私人秘书策划爆料的时间点。爆料的事情已经压了半年多了,就是要在大选当口泼脏水。现在看来,这个爆料至少从媒体coverage看,对拜登伤害最深。“拜登家族腐败(Biden family corrupt)”因此成了近一个月的推特负面舆情的主题词。下面的一个月来的舆情动因词云是在一亿多相关推特留言中挖掘出来的,光“腐败”一词就出现 124万次。这是拜登在推特半年来领先突遭舆情滑铁卢的最重要的导因,尽管其实际效果如何,还有待选后结果做进一步关联和验证。

汉阳一江水问:还有哪些重要的影响选情的状况值得注意?

立委答:有一件事讨论得不够充分,但却是很重要的因素,就是第二阶段救助计划的迟迟不能落实。选民因此对两党都有怨气,需要分析的是怨气的比例和对摇摆州选民的投票影响。这是最打击普通底层家庭的切肤之痛。虽然两党都向选民表白知道人民疾苦,但自从第一阶段救助到期,迄今已经几个月了。与很多国人想象的不同,美国有相当多月光族家庭,大多没有积蓄,寅吃卯粮,信用卡常常刷爆,完全经不起失业的打击。他们面临无法应对生活基本开销的恐慌。目前看来,这批人的怨气貌似分散了,既有把怒火撒向川普,也有把怨气撒向民主党(佩洛西)的。如果选举日之前救助计划出来了,算谁的功劳?这个还真不好计算。相信两党都有高参在做研究,报告各自大佬,这一个妥协是不是有利,否则何至于拖延至今。川普出院以后高调放风说,TMD 不跟民主党扯皮了,救助计划选举后再谈。激起众怒的反馈回来,他马上改口说,你们不知道交易的艺术吗为了达成交易,先把话说死,然后出一个对方难以拒绝的 deal把球踢给对方。这一招的确给民主党造成了不小的牵累,对选情肯定有负面影响,虽然媒体上没有充分发酵。

外三篇:

有悖常识的谣言

有些传言,不用分析,一看就是谣言,有悖于常识,但就是有人信。这可能是理念和信仰的力量,也可能是无知和愚昧的结果。

这次美国选举,谣言在中国社交网络上大为泛滥,叹为观止,且坚信谣言的不少是民主斗士、社会精英和饱学之士,让我惊诧。于是我写了一系列文章,展示了这幕皇帝的新衣的闹剧,被正义之士骂为民主的敌人,专制的帮凶和当权者的走狗。

是的,我不是右派,但也不是左派,我信仰的是科学,崇尚的是自由(包括言论、结社、游行等),对独立的思想,民主的氛围,法治的精神,宽松的环境无限向住,赞颂市场经济和民营经济济的崛起,担忧国有经济垄断和票证经济的回归。

对事不对人,信仰与良知、理念与科学,愿望与事实,我推崇良知、科学与事实。那就是客观分析,科学论证,尽量展现事实,反映真实民意和双方力量对比。

悖于常识的谣言,或多或少,每个人都信过一部分。大家都是凡人,有志向,有理念,总是愿意听顺耳的话,看迎合心愿的文章,有时难以辨真伪,或者不愿去分真伪,也是人之常情。但过于执着,容不得不同声音,那就有点走火入魔了。

我少儿时也曾相信有悖常识的谣言,而且是坚信,我能理解他们。

当年我曾相信,养病治病的林师长曾秘密指挥苏联军队与希特勒军队作战,受到斯大林赏识,想留他下来,培养作为苏维埃接班人。当年我是很怪林师长的,为何要回国呢,不然苏联不会变修,还会纳入我大中华版图呀。

当年我曾相信,我们心中红太阳可活150岁,那是一些国宝级专家们在认真检查圣体后认真研究得出的结论,不容置疑。我激动的热泪盈眶,幸福感满满,这确保江山永不变色,我们再不会受二茬罪,吃二遍苦。

当年我曾相信,民国的经济财富全掌握在“四大家族”之手,蒋光头是富可敌国的资本家,也是帝国主义忠实走狗。他杀人放火,无恶不作,其目的就是把中国出卖给世界列强,以换取奴役人民的权利。

当年我曾相信,那三年绝对是严重自然灾害,是天灾。至于那连续的灾害是水患、旱情还是地震都不重要,各省市有无公开的灾情记载也不重要。我只坚信二报一刊,坚信中央文件,只要他们说有,那就是事实。

今年,美国选举,中国自媒体出现大量有悖常识的谣言,不但有不少人相信,还有人对此谣言百看不厌,津津乐道,到处传播,分析剖解。

再牵强附会,再违背常理,也不改初心,对川大爷敬仰崇拜与忠心天地为证,日月可鉴。

我们今天就讲一个流传甚广的谣言,即老拜在计算机上作了手脚,偷取了老川高达千万以上的大量选票,窃取了总统宝座。并特别强调“民主党操纵了大选”,美国司法部、联邦调查局与民主党沆瀣一气……

稍想一下,这太不合常理,如果用计算系统作弊达千万级,这可是世界级丑闻,是美国历史上最大的犯罪。可川大爷领导下的美国的官方司法机构,至今未见启动任何对这一指控的调查,让人不得不怀疑这纯是无中生有,空穴来风。要不就是美国司法机构全部腐败了,可如果全烂了,花那么大精力诉讼有什么用,不是白费劲吗?看来只有起义一着,才能彻底解决川团队提出的问题。

现在问题是,经过这次选举后,美国红州还是红州,蓝州还是蓝州,这怎也不像大规模系统性全方位做假。假如是大规模选票做假,理应彻底,改变选举版图,但这些都没有发生。而且和总统一起选举的参众两院,共和党都没有失利。这是那个大傻瓜才能干出的这等蠢事,人力物力都花费了,精心策划,长期准备,干么不一统天下,让参议院,众议院绝对多数归于民主党。

实际上老川比我们这帮人明白,他把焦点仍是盯着摇摆州的争夺,而摇摆州是不需要千万张选票做假,当年小布什几百张选票就赢了戈尔。做假几万张就够了,劳那大神干吗?

果然老川律师团所有诉讼都是针对摇摆州的,似乎全国系统性作假又回归到那几个州。于是几个摇摆州经老川团队要求,在双方派人严密监督下,重新人工一张一张选票点票检票。遗憾的是其结果与计算机计票结果惊人一致,误差在公认范围之内。

不论是在计算机做手脚,还是在选票上做假,人工点票时,其数据就会与计算机点票的数据相差极大,这才符合常理。

谣言本应不攻而破,但这个谣言现在仍在自媒体上乱飞,信者恒信,我服了。

美国网络及基础建设安全局 CISA 局长,共和党人 Chris Krebs 曾详细地说明了为什么本次大选中,不可能出现什么“外人操控 Dominion 计票系统”的问题。 “拿佐治亚州来说,重新手工计票,就可以证明机器计票没有问题,两者结果是相互符合的。所谓计票机器被操纵,在我看来都是些胡说八道和骗局。”于是有人公开对他发出死亡威胁,“这家伙是一个一级傻瓜,应该被绑起来,凌晨拉出去枪毙!”共和党的州务卿因为签署大选认证也遭死亡威胁。

亚利桑那州共和党州长Ducey也说,“在亚利桑那,我们有最强大的选举法律。我们在投票站查看每一个人的ID,我们检查每一张提前选票上的签名,我们是人工检查,而不像某些州是用电脑检查。我们有来自两党的监督员,我们有明确的投票截止日期,在投票日之后我们不允许再计任何选票。”

可有些人就视而不见,到目前为止,所有川普团队全力进攻的六个摇摆州,密执根(23日),威斯康辛(30日),佐治亚(20日),宾夕法尼亚(24日),亚利桑那(30日)和内华达(24日),全部完成了各自的大选结果认证。

老川提名的,共和党的司法部长 William Barr也向美联社表示,“我们没有发现可以改变大选结果的任何舞弊。”

川普今天发布了一个他自己声称是他一辈子最重要的讲话,絮叨了46分钟,当然还是选举舞弊,社会不公之类,川普强调,“有几十万张选票出了问题,如果我们证实大选存在欺诈,拜登就不可能当上美国总统。”记住,几十万张选票出了问题,已经不是几百万张,几千万张了。老川不敢像他的律师那样胡乱开口,但这几十万张选票做假,老川也没拿出确切证据,只用了如果两字。

现在老川的支持者火药味已经越来越浓了,那个民兵组织《我们人民大会》在报纸《华盛顿时报》上公开说要武装起义推翻选举结果。如果立法者、法院和国会不遵守宪法,我们呼吁总统采用戒严法举行新选举!!!如果总统不采取大胆行动捍卫我们的权利,我们要打内战。

老川的支持者,亚特兰大律师林·伍德(Lin Wood)加入了西德尼·鲍威尔(Sidney Powell)的行列,带领人群对该州共和党州长布莱恩·坎普(Brian Kemp)高喊“把他关起来”。乔治亚州的点票官员是共和党人,昨天出面严厉谴责他和他的团队受到的骚扰和死亡威胁,呼吁总统和州长站出来谴责任何形式的威胁。这位官员说,it has to stop,我因为负责这件事,属于 high profile 当事人,受到的威胁严重,我有心理准备,政府警察也对我和我家予以了贴心保护。可是我的团队那些辛辛苦苦、任劳任怨的点票员工,居然也不断受到各种威胁和骚扰。他们只是做了他们的本职工作,展示了客观结果,就不断遭到骚扰。如果不受谴责,迟早会出事,会有人受伤甚至被杀。

而且让人哭笑不得的是堂堂的司法部长也开始要求证人保护,所谓证人保护,是司法系统提请警察对证人提供特别保护,以防被人报复。

乔治亚州虽然认证了,但事情还没有完,元月5号的两位参议员选举还在造势过程中。共和党参议员凯利•罗伊弗勒(Kelly Loeffler)和戴维•珀杜(David Perdue)将分别与民主党挑战者拉斐尔•沃诺克(Raphael Warnock)和乔恩•奥索夫(Jon Ossoff)对决。

因为这是两席至关重要的职位,可能左右今后四年的政局走向。共和党这边陷入了的两难。

川普一派反复宣传乔治亚等州的选举系统 rigged (被操纵),使得川粉不再信任选举机关,要集体抵制(boycott)参议员选举,反正选了也白选,也还是被民主党窃取。

哪怕只有一部分的川粉抵制,也会造成关键选票的流失,会促使共和党参院败选。这个后果太严重了,选举结果将决定哪个政党控制美国参议院。

如果真抵制,那怕一部分抵制,就是坑共和党,因为参议院还是要认可这次州议员选举结果的。乔治亚州共和党众议员反驳了选举系统 rigged (被操纵)说法,并呼吁选民在选举中投票。现在有人婉转劝川普总统出面鼓励他的基本盘出来投入到参议员选举,还希望他自己亲自去乔治亚站台助阵。前几天报道说,川普同意去乔治亚州助选。但如果他同意助选,让支持者投票,那不是默认乔治亚等州的选举系统是正常的,这又与他这段时间反复讲的弊案与操纵说辞有冲突,他也不好选择。

还有什么老川派部队突袭德国某数据中心,特种部队在法兰克福、巴塞罗那和多伦多截取到的选举系统数据服务器。

川普紧紧抓住兵权,特种部队和太空军已经随时候命,军队绝对忠于老川,捍卫宪法。老川准备军管;《反叛乱法》静待出手,而鲍威尔律师正在摩拳擦掌,准备将一大串名字按叛国罪提起诉讼。

拜登的儿子电脑硬盘中不仅有拜登家族的贪腐卖国及其他罪行的证据,更涉及包括奥巴马、佩洛西、副总统候选人Harris、纽约州州长库莫、扎克伯格、华尔街日报等等很多政客、企业家和媒体的犯罪证据,奥巴马已在夏威夷抓捕入狱;

CIA、FBI、司法部就不用讲了,基本上算是烂透了。大量州长州务卿、参众两院、警察、甚至是法官都有被买通。他们甚至可以操控一部分军队。他们把持了几乎所有的媒体,Facebook 、推特、Google 和YouTube 也是他们的共谋。他们联手了至少四个国家,妄图联手控制美国。这场选举事实上就是一场赤裸裸的政变。

等等等等……

稍有点常识的人,都知道这些是谣言,可是就是有人喜欢,到处传播,没办法。老川粉丝们以为川普是总统,就能像君主那样为所欲为,殊不知他们所鼓吹的其实就是政变,粉们从头到尾不知道什么是民主。

老川“最重要”的这次讲话,完全是痴人说梦的现实版。虽没有新意,但这种煽动和阴谋论说法在老川粉丝们里面流传甚广,坚信不疑。虽然大局已定,但产生局部动乱是可能的。

拜登这人好不好不是要害,美国人民选谁才是要害。我们的喜厌决定不了四年任期的美国总统的选举的胜负,不能用阴谋论是歪曲民主自由的美国。人民那怕选了个傻瓜,那也必须认,这是民主的常识。

江城记事之十三

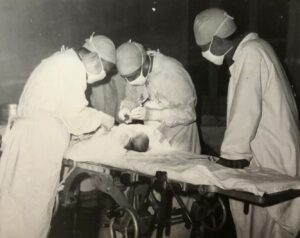

中心医院家属的心路历程(外一篇)

二月六日,李文亮医生不幸殉职,我的心一揪。

三月一日,江学庆医生与世长辞,我暗自流泪。

三月三日,梅仲明医生离开人间,我失声痛哭。

三月九日,朱和平医生默默去世,我欲哭无泪。

这不仅仅是因为他们是这场全球灾难里阵亡的医护人员,也不仅是因为他们是抗击病毒的英雄,更因为他们都是我女儿在武汉市中心医院的同事。他们的倒下,使我们愈发难以抑制对远在千里之外的武汉的女儿的担心和牵挂。悲伤和恐慌一天天在心中蔓延。

女儿是武汉中心医院后湖院区一线临床医生,一直在一线从事抗疫医务工作。好长一段时间,她关于医院的情况对我们什么都不多说。我们天天和她打电话,却完全没有从她口中听到当时医院所面临的险境,更不知晓医院领导对医护人员防护工作的漠视。她的回话总是:“没问题,还好,一切都好,请放心。”全是让我们宽心的话。 然而,女儿医院噩耗不断,四位医生相继去世,我们心中越来越不安,对她所处的环境越来越担忧。终于,网络上陆陆续续爆出一篇又一篇中心医院防疫之战的惨烈报道,我们这才意识到我们宝贝的女儿曾经炼狱。内幕的揭示让我们看到中心医院管理层的渎职。又要战士冲锋陷阵,又不给战士配足武器弹药。伤心滴血的中心医院一线医护人员,眼看着身边同事一排排倒下,二百多人感染,却不得不仍然在前线顽强坚守阵地,有怨无悔,负重前行 。我心疼着他们,就像心疼着自己的孩子。因为其中就有我们自己的孩子。张文宏医生说得好:“医务工作者,现在最缺乏的不是宣传,而是关心。我明确和大家讲,第一关心是防护,第二是疲劳,第三是工作环境,我觉得一定要跟上。如果跟不上,就说明没有把医务人员当人,只是当机器。让医护人员免于受伤害。没有防护,你可以拒绝上岗。最重要从来不是歌颂牺牲,而是避免战士无谓地牺牲。最好的歌颂,不是赞扬损己的利人,而是提倡不损己的利人。” 多么希望每一位拼在前线的医护人员也都有张文宏医生这样的好领导啊。会让我们做父母的宽心很多。

中心医院的后湖院区离华南市场最近,首当其冲。这所武汉三甲综合医院最早收治新冠肺炎病例,也是最早发现上报这次类似非典的病毒案例的。女儿也自然成为最早投入武汉抗疫一线工作的临床医师。女儿元旦前就知道医院接受了几例类似非典的病人,但她当时并不知道有无人传人的情况,只是凭直觉催我们提前原先准备的行程,立即从武汉出发开始我们的自驾海南度冬之行,并希望外公外婆也随同过去。她告诉我们时,是小心翼翼的,反复叮嘱不得外传。医院已下令严厉禁止医护人员公开谈论不明肺炎情况。她也不知道这病况未来如何发展,她毕竟不是呼吸科、急症科或传染科的医生。在女儿的反复催促下,我们元月一日就提前开车离开了武汉奔向海南。外公外婆在家待惯了,不愿长途跋涉。我们无论如何劝说不动,只好作罢。当时我们万万没有想到后来会发展到封城、封省、封国的境况,要不然绝对不会留下外公外婆在武汉,让二老隔离煎熬这么久。

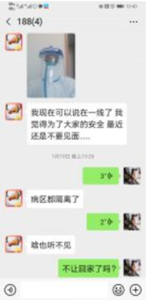

刚到海南时我们还是比较放松的,女儿有时候值班后或者休假时还会去外公外婆家蹭饭。到元月中旬,女儿突然告诉我们她决定不再去外公外婆家。她对我们说,工作比较忙,安全第一,所以暂不去外公外婆家,并反复强调现在还好,只是预防。我们当时也就信了。现在想来,她医院那时候的情况已经十分严重,已有医护人员感染。她在一线,开始大面积接触感染病人,安全防护装备也不足,她是怕给外公外婆带去病毒。她妈听说她上了一线,着急得不行,整夜整夜睡不着觉。

白天盯着电视看疫情发展,晚上翻来覆去,情不自禁老往最坏处想,不能自己。那些日子里,我们俩深夜必看方方日记,看完日记看留言,看完后心情更是难平难眠。什么是度日如年,我们这次有了深深体会。外公外婆并不比我们少担心。在孙女不上夜班的日子,每晚都给她打电话,否则两老就无法入睡。在进入隔离区之前,女儿最后一次去外婆家时,外婆不知为何有点不舒服,走不了几步路就累得不行。女儿非常担心,又不敢让外婆去医院检查,怕交叉感染。在外婆午睡后她给外婆做了全身触诊,得出结论外婆没大问题,外婆听了很安心。万幸封城在家休养一段后,她的身体果然慢慢康复了。女儿本来早已经买了机票要来海南和我们一起过年的,在封城前五天,她突然告诉我们,因工作需要她不能来过来和团聚了,立即退掉飞海南的往返机票,她要留守武汉。

想来刚开始她内心是恐惧的,病人像潮水一样涌来,医护同事大面积感染,她能不害怕吗?但她从未对我们流露出一丝畏惧情绪,这让我们就格外地心疼她。后来她说她太忙了,一忙就忘了去害怕了。跟所有一线医护人员一样,职责所在,大家只想着如何拼力救人,能救一个是一个。封城前后,她一直避免对我们谈及她的工作境况,包括她在医院没日没夜四十多天连轴转的艰难。她从未对我们透露过她们医院医护人员感染人数和隔离人数,李文亮去世后,我给她打电话反复追问,她才告诉我,她们主任也染上了,不少同事也中枪了,但她不让我告诉她妈妈,怕妈妈着急。我只有反复叮嘱她注意安全,小心再小心,除此之外,我真不知道还能做什么。无助、无奈,在女儿最危险的时刻,我们提供不了什么实质帮助。只有苦熬日子,默默祈祷女儿平安健康。移动互联网的世界里,想隐瞒消息是很难的,很快她妈也从网上得知了武汉中心医院的悲惨境况。担心女儿,挂念父母,追踪疫情的各路报道,那是我们那些天做的唯一的事。随着大量外地医护人员陆续到来,女儿终于接到了指示,有机会隔离轮休了一次。稍微恢复了一下疲惫不堪的身体后,就又回到第一线去了。她说,作为本地医生,疫情一天不结束,只要不病倒,就一天不能撤退。站好抗疫最后一班岗,这是本地医护人员宿命,也是良知的坚守。女儿低调,从不吐苦水。但是疫情爆发到一定程度时,她向我们提出能不能对我的朋友们发出呼求,呼吁给她们医院捐点医用防护物资。她们一线医护人员已经不得不用普通塑料袋包脚了。口罩缺,护目镜缺,防护服更缺。如果不是缺到特别严重,她是不会向我们求援的。我真的没想到一线医护人员防护物资会这么紧缺,后来看到网上出现大量医院的求援信息,我们才知道他们医院并不是唯一。从网上流出来的照片可以看到,许多医护人员几乎等于赤手空拳,在用血肉之躯筑起一道医治急性传染病的防火墙。

更让我们愤怒的是,都快弹尽粮绝了,有报道说中心医院某些领导仍拒绝个人捐助,只接受从红十字会发过来的物资。理由是个人捐助标准不统一,他们不能承担这样的风险。女儿与同事已顾不了这些戒律了,有总比没有好。于是她们开始上网四处求援,绕过领导,呼吁社会和个人捐献。很快,我在美国的同学,千辛万苦,开车从旧金山湾区到美国中部,购来口罩给女儿医院寄过去。全球华人展现出人性,爱心,给苦难中艰行人心中抹上一束亮色,带来一丝温暖。

女儿是一个与世无争的女孩,但是在疫情面前,她表现得比我们谁都坚强。她在家里也是一个衣来伸手饭来张口的公主,但是为怕感染家中年迈的外公外婆,自己住到了宿舍。劳累拼搏了一天下班后,回宿舍自己洗衣打扫卫生,自己烧饭做菜。轮休期间她还多次打电话来向我们请教怎么做哪道菜。她在电话里总是不忘叮嘱我们注意安全,关心外公外婆的身体,让我们大家放心。她越这样懂事,我们就越心疼她,她自己才是我们家冲在最前线的人啊。她爷爷不知从哪里看到的消息,从外地给她发微信说,中央很关心你们,伙食标准很高,每人每天两百元呢。我提及此事,女儿笑了笑,传来一张她正要吃的中歺盒饭照片。那个标准,我看了一下,往高说也不超过三十元吧。

早歺热干面是旁边一家店免费义务给医院全体员工提供的

前段时间,我让女儿拍些工作照片,讲讲她工作中的困难和发生在她身边的故事。她说现在太忙了,没时间用护肤品,形象不好,不适宜拍照,实际上她是怕我们看到她被防护面罩压迫留下的满脸勒痕。在我们再三要求下,女儿前些天勉强发了几张工作照过来給我们看。看着她那青春女孩子那满脸的皱褶,满手的勒痕的双手,我们心痛。看着她厚重的防护服下弱弱的身影,想想都知道,一整天下来整个身体一定都是湿的,几个月的苦战,如何承受这高强度工作压力?夜深人静,望着满病房里,在死亡线上挣扎的病人,又得承受多大的精神压力?这样的日子,女儿是怎么熬过来的。我们不敢去想。女儿安慰我们说,放心,脸上勒痕很快会消失的。还说,当穿上防护服,戴上护目镜那一刻,完全像个太空人,自己也觉出格外的庄重感。别无选择,必须走进隔离病房,这是一个医生无法推脱的责职。这时候只能前行,大家都一样,没有人退缩。

我有朋友听我说了后称赞她了不起,女儿电话里却说:我只是个普通的医务工作者,不勇敢也很害怕。我不是战士,也做不出什么英雄壮举,今天我是无奈选择逆行而坚守岗位。这不是什么了不起,而只是没办法,是基本职业道道。是良知,是工作性质所决定的。躲不过去,也不可能去当逃兵,那就只能忍着、挺着,工作着,尽量照顾好自己。很无奈,但我不后悔。全世界的医务人员都会这样,救死扶伤是全球医务人员共同的誓言。

人一辈子遇到这样事,也不容易。万幸的是,到目前为止她还没有中枪感染,这是我们最大的安慰!我跟她说万幸,她却冷静地说,什么万幸?可能我早已被感染,只不过是轻症,自愈了还有了抗体。早期什么防护都缺,不传染都很难,就看谁扛得住了。

她说得轻松,我听得惊悚。

是啊,她的老师,她的同事,她的领导,纷纷有人倒下,四位兄长无力回天。她没倒下,是上帝的眷顾,还是病毒体谅我们的父母之心,我们不知道。到了疫情后期,虽然防护措施也加强了,但做父母的我们依旧提心吊胆,晚上睡不着觉。我们也知道,我们的担心有时会成为她负担,影响她心情,但忍不住,只是尽量不在与她通话中显露。

但愿噩梦早日过去,但愿一切恢复到平常。

疫情会结束,磨难会过去,但我们一定不要去赞美苦难,美化伤痕。多难兴邦,苦难练人,可那是大话,是官员的话。

我们老百姓就只希望一家子团团圆圆,一生过得平平安安。

外一篇:

答留言问

感谢二湘公众号一枚编辑,在百忙之中,她把我文章留言全部拷贝传给我,共38页700多留言。

95%以上留言都是鼓励、支持、谬赞,我惶恐,实不敢当。

留言中也有人提出不同意见,有些语言稍有点激愤,但总体还算平和讲理,很感谢异议者的包容和客气。

虽然只是很少很少的反面意见,但我还是把它全部整理出,给予一一回答,希望对方能体会到我的善意。

不求改变你的看法,只求平等交流,友好交锋。

伤自尊哟,太伤自尊了。我的文章下面留言,批评意见基本上都是针对方方先生的。我的小文是我个人心历过程的描述,没对方方日记评头论足,没想到绝大部分批评意见不是针对我的小文,让我很是伤心,自尊心严重受挫。

可能是我的文章是用二湘公众号发表的原因,能理解,但心里总有失落感。

因喜欢舞文弄墨,在中国有史以来,范围最大的疫情期间,我的朋友们希望我能写点。毕竟我在疫情中心武汉市生活三十年,女儿是医生,至今仍在一线工作,不写点实在说不过去。

三月十日,一气呵成,成就此小文,并发给同学,朋友,亲人。

三月十二日,弟弟加了按语,放在他的博客里,算是正式发表。

三月十五日,又做了一些修改,去掉一些激愤的话。

天天看方方日记,才知道公众号的概念,落伍了。

跟着学,三月二十七日也开了自己的公众号“汉阳一江水”,次日我的公众号也刊载了该文。

四月一日,我通过二湘公众号留言中所述的约稿方法,把这个小稿件邮寄给编辑。

所幸被编辑看中,作为方方日记接龙第八棒。

四月二日,上网登出,我感到很荣幸。

二湘的公众号,读者群和我的公众号,不可同日而言。

一定会载入史册的大温疫,百年之大变局的大时代,我没有缺席,尽了一份自己的力。

声明一下:我的文章只是我个人的体验和感受,没有阴谋,没有恶意。不是中央文件,不是报刊社论,不是党组织结论,不是社会大众意见,不代表任何派别,不代表其他人,没有普遍意义。

绿光

老顽童写出了我的精神状态和心里话!我的女儿也是中心医院的医生,她是医院最早一批感染病毒倒下的人,刚开始隔离治疗的那段时期,医院防护隔离条件都不好、几乎所有东西都跟不上,女儿跟十几名倒下的医生一起在本院隔离病房里进行隔离救治,在政府发布疫情信息前,她又被转入到指定的发热门诊专科医院,最后她被转入到了汉口医院,刚转去的那几天,那里条件也一样不好,当时那里也都是措手不及的状态,连吸氧都不能够解决,她只能是躺在那个医院里非常难受的发着高烧,眼睁睁看着跟她一样的人的不同的痛苦状态和表情,她只能靠自己的坚强毅力去硬生生的挺着!当时,她在微信中简单地留下两句话:我中招了只能靠自身免疫力去挺,挺不过来就挂了。我们做长辈的每天真的是无时无刻就是在揪着心的煎熬着!……后来经过30天的治疗终于康复了,两个星期前她为了挽救其他人的生命,已经去血液中心献出了自己的血浆,成了一名献浆抗疫的勇敢战士,并已经投入到了抗疫一线中去了!她作为一名平凡武汉人、做了武汉人应有的担当和责任,也是抗疫的医护人员中的平凡人!

作者答:

同病相怜,虽然是正方意见,我仍决定把你留言放在这篇文章的最上面。

唯一的。

你女儿是真正的英雄!

听到她康复的消息很是安慰。虽然我们素不相识,但我们是同一家医院的职工家属,心是连通的。

我女儿到目前为止,仍在抗疫一线工作,估计应该有始有终走完全场。

好消息是前几天,我女儿做了检测,全部是阴,没有被感染,当然也没有抗体。坏消息是武汉疫情虽取得阶段性胜利,但仍很严峻,大家需警惕,防疫工作任重道远,切不可麻痹大意。

盼望武汉早一点恢复常态,盼望中心医院恢复元气。

做一个平凡的武汉人,一个无忧无虑的武汉人,东湖散步,长江游泳,黄鹤怀旧,吉庆品酒。

大饮三十杯,不醉不归,做回“老 子”!

祝你全家平安健康。

蒲静

爱国之心人皆有之,爱国不是光靠骂的,外文出版就是背叛,给国家添乱.感觉方方自己极左了。

你的日记外文出版,就不是内部问题了。方方是想祖国好呢?还是想闹事,让国家背包袱让我们倒退几十年吗?外文出版一定是授权过的,还有许多文字要出版,真是不耻小人日记。不光记录了武汉人民艰苦抗疫的不屈与无奈.内容也有质疑病毒所和研究人员.这只是你的猜测,许多囯家疫情严重正想找理由⋯ 请方方撤回授权,让祖国平安,让人民回归正常生活.也让你自己安心.你的日记已传遍祖国大地,疫情期间也抚慰过痛苦无助和受伤的心。目的已达到,闹到国际上就是偏执,就是小人。

作者答:

首先,我很抱歉地通知你,我不能答应你的请求:“撤回授权”。因为,我不是方方先生。

你的拳拳爱国之心,浓浓爱国之情,我感受到了,是真诚的。

可以告诉你的是,方方先生有这方面的回答,详见方方文章:我的书跟国家之间没有张力。

不知她的这篇文章能否解开你的疑惑?

或者网络文章: 方方日记在美国的影响。

或者:方方日记为什么不可以在国外出版。

两篇小文有符合逻辑的说辞,可供参考。

有一点可以肯定,方方这本书,在国外不会大卖,不会是畅销书,没有几个白种人关注她的书。但在中国就不一定了,如果有出版社肯出,一定畅销。

有理说理,有事说事。不要用偏执,小人等词汇,那是谩骂,有损女人之优雅风度。看名字你应该是个女士,也许是个汉子,算我多嘴。

方方先生日记我全看了,批评十分克制,语言极为温和。我们国家现在基本上听不到尖锐的批评了,如果连这么温和的批评,也要口诛笔伐,全面围剿,挖祖坟式的羞辱,恶语咒骂式群殴,不能容忍异见,欲置于死地而后快。那么我们未来会是什么?一个声音,万马齐喑,这对国家绝不是幸事,我真的真的很担心。

我不希望坚定的反对者,动辄以爱国的代言人姿态去评判,谩骂,诅咒。你喜欢就喜欢,你反对就反对,千万不要假借爱国名义来审视,一旦借爱国的名义去批判对方文章,无论多么正确,都有失公允。

不要太高看方方日记作用,也不要太小看西方敌对势力的智慧。

怪不得有人说,追责追责,追了几个月,终于追到一个写日记的老太太身上,你说奇妙不奇妙?神奇呀,这么大的锅,让个文人来背,好意思吗?

千万别走上“利用小说进行反党是一大发明”的思维格局上来,那看什么都是阴谋。会活得很累,奸臣康生一生都生活在阴谋之中,死后掘坟,可以借鉴。

邓公说过:“一个革命政党,就怕听不到不同声音,最可怕的是鸦雀无声。”

qi

方方日记被美国人拿来当作证据向中国索要千万亿赔偿费,这下方方们满意了吧?!

作者答:

这是你的逻辑。

索要千万亿赔偿费?这与国际法相违,很难成立,只是部分政客胡言乱语蹭热度而已,不必当真。

假如世界各国联合起来向我们索赔,方方日记从法律上讲,也不可能成为证据,人家不会这么傻。

况且封城前后,国内媒体通稿说:

目前新冠病毒染人群从地理分布上来看,跟武汉华南海鲜市场关系密切。头一批病人,大多来自这里。

这段话国内各大媒体都刊登过,比方方日记更有证据力。所以,别杞人忧天,自己吓自己,都不会作为证据的,你放心。

从流行病学角度上说,无论时间前后,空间点面,源点都指向武汉。但这都不是问题,自然灾难是没有追赔一说的。除非人为灾害,那是大问题,但这个骇人问题,不是方方日记就能递刀子的。

我是不相信人为因素的,这是典型阴谋论的思维。

科学的东西一定会从科学上找证据,不会从文艺作品或新闻中找证据,那怕是记实文学,都没有呈堂的合法性。

当然,方方们是不满意的,方方们更在意的是追责,是吸取经验和教训,你说,会让方方们满意吗?

百家争鸣,百花齐放,言者无罪,无则加勉,容许辩论,尊重对方,宽容疑义,鼓励标新,学术自由,独立人格。创造一个各种观点并存,各种流派良性竞争的内部环境,这是我辈最大祈求和愿望,也是揭示事件真相的最佳方法。

张

唯恐天下不乱

作者答:

是指我的这篇小文?还是方方日记?

难道讲了逆耳实话就唯恐天下不乱?天下也太容易乱了,自信去那呢?

说句不好听话,你这是在给我党的四个自信理论抹黑。

小心有人找你喝茶,别怪我没提醒你。

中国人普遍缺乏忏悔和饶恕的基因,充斥着冷漠、自私和遗忘。因此,正视问题和自己的良知,仍然任重道远,需要几代人不懈努力,才能杜绝恐惧年代回潮。

胡杨

虚伪

作者答:

很遗憾,本人笨拙,这词用得我无言以对。

爱点点

方方,你的日记我看过不少。虽说写实是对的,但你的立足点有些偏颇。你的立场,观点,诱导就不敢恭维了!看你文章就觉得中国一片黑似的。再结合最近美二十多万,意大利十多万,美国超市一光,枪支热销……,一比较,我觉得你越来越成反面教材了。

作者答:

方方日记问题还是由方方先生回答,我不便越俎代庖。

至于别国防疫问题,是好是坏?用不着我等喝地沟油的屁民操劳,国家也不让我们操劳,据说宣传口专门为此下文了。

看着他人苦难,嘲笑,也有点不地道。

一叶一菩提

疫情会结束,磨难会过去,但我们一定不要去赞美苦难,美化伤痕。多难兴邦,苦难练人,可那是大话,是官员的话。官员不是正常人吗?

作者答:

谁说官员不正常?那是你说的?

官员有官员的语言,小民有小民的俚话,都很正常。只是部分官员,大话、套话、官话、假话多了点,不近人间烟火。

湖湘特产龙头企业

方方这个鬼,从面相上来看就不是善茬!

佛教上说:相由心生!

俗说讲:三十岁前的容颜是父母遗传的,三十岁后的容貌是自己内心修为的映像!

但这个方方六十多岁了还是一付巫婆的嘴脸,

没一点慈眉善目,

可见内心阴暗,恶毒!

强烈建议方方到意大利写日记。

作者答:

碰到你这么神棍,我无语。

不知你的面相如何?看来也不是个善荐。信佛就是信善,这么恶语相加,有辱佛祖。

阿弥陀佛,善哉善哉。

ZSF

遗憾你怎么把自己绑在了方方的战车上,那是玷污了自己的女儿呀!!!

作者答:

如果你有女儿,真为她担心?

方方有战车吗?你敌我意识强,阶级斗争这根弦绷得紧,点赞。

弱弱地问一声,你,贫下中农出身或红二代?

我最害怕的,就是我们国家成为一个猜疑,冷酷,不容忍的社会。运动、骂人、内斗、吹牛、告密、揭发和谎言是文革时代一大特色,现在也未根本性变化,这极易走回头路,让人们再生活在恐惧中。

新阳光

你们没有把这个国家为人民的付出体现出来

作者答:

有体现,说老实话,不多。

从中央到地方,电视台、电台、报纸、杂志大把大把体现国家伟大,领袖英明,人民感恩的文章,铺天盖地,目不睱接,疲劳轰炸。

这么几十篇小小的日记也要统一声音?我的个人小文也要展现命运共同体?

你太抬举我了,太高看我了,我无地自容。

赤林

你的读者如果只是你的亲人,你真的写得很好。如果你想让全国人民都可以看到,你真的太自私、太狭隘,通篇你女儿,没有半句关心武汉市民,关心患者的话。你是住在海南,还是在海南买了腐败房,只是去越冬的我们不想知道。但你生了一个好女儿,国民心中的女英雄,这是你唯有的骄傲。

作者答:

我当然自私。

我写自己的心情,自己的担扰,自己的烦恼,全是自己的东西。

我不是政府,不是领导,不是官媒,我只是个小屁民。自然没有你的大局观念,没有你的开阔眼界。你立足祖国,胸怀世界,关心全球三分之二受苦受难的人民,我佩服,我没意见。

但我的长辈在武汉,我的女儿在一线,为子为父,担心受怕不是很正常吗?想向别人倾诉,让大众知道小民的酸甜苦辣,有何不妥?

不关心武汉市民?不关心患者?这话太大了,我受不了,这太高大了,我怕。

我们就是武汉市民,我们不少朋友就是患者,你怎么知道我们不关心?难道每篇文章都必须按一定模式,才足以表达关怀的心情。

至于腐败房,你太抬举我了。我一没官职,二没权力,九十年代下海自谋生存,想腐败都难。

不过,对你反腐热情必须大大地称赞,如果你真有反腐胆量和决心,是否可以不停地向党和人大呼吁:党员干部和公务员财产公开。这是反腐的治本措施,做成了,你会成为人民的英雄,民族的脊梁,共和国的保护神。

想想,我都替你激动。

另外,你仇富心理不小,建议你,有空可以琢磨琢磨,是那些人,开着一眼望不到边的超豪华车,在美国大街上举行爱国游行,说不定能抓几条大鱼,立功机会来了。

我的女儿是我的骄傲,但不是我唯一的骄傲,让你失望了。

路在脚下

我只问一句,她在美国出版中国日记,现在美国疫情大爆发,为什么不亲身经历写美国日记,为什么在美国大爆发时停写,说什么疫情结束了,疫情在她身边结束了吗?她口口声声要揭露真相,她听说的是真相嘛,网上那打脸的情况就不说了,真相应该是普遍真相而不是她选择的真相吧,她是不是该揭露下美国的真相呢,比对下啊。

作者答:

你太操心了,真担心你长此下去,吃不好饭睡不好觉,这不利身体健康,算是忠告,听不听由你。

方方日记有违背事实的打脸的情况吗?没有?

只有两件事异议较大。

一件是照片事件,那张手机旧市场照片不是方方放的,方方有另一张照片,没放,是有人栽赃。

一件是外地护士去世之事,那是误记,第二天日记里就进行了更正,那位英雄护士不是去世,是脑死亡。

但没人愿去听后来的辩说,以讹传讹,越演越烈,假的也成真的了,悲哀。

善意的提醒,中国人应该关心关心我们中国自己的事,美国大爆发、大危机,也是美国人的事,他们会关心的,用不着我们去操心。而且他们新闻媒体问责力量比中国厉害多了,常为我们党刋、党报递刀子,爆猛料。

比如疫情期间,纽约街头倒毙一个人,结果美国各大报,电视电台追踪报道,分析评论,海了去的。

不信?你可问问你美国的亲属和朋友.

要方方亲历美国写日记,揭露美国真相?你确信你没发烧,没说糊话?签证你批?飞机你开?

普遍真相是什么?不就是每个个体真相的结合?各个选择的真相汇聚到一起,我们就能客观地得到全方位、立体式、多层次的普遍真相。

不知对否,请指教。

龙云

相信方方老师及八位作者是大部分大实话,只是集中了有限范围的观察。作为读者,都是带着情感阅读的。在此之下,常常会忘记还有更多负重前行的人值得写。可是,人之常情常常选择记录苦难。苦难是必须记录的,那些勇敢的人,那些在系统运作中的人,也不应该被忘记。最开始还喜欢阅读,但后来,我问:这难道是武汉的全部?就是武汉”全部真相”?没有更多了解武汉的人,以为这里是全部。其实,我的朋友出征,写下的文字也很感人,我看到的是另一面。我果断放弃继续阅读这个公众号。尤其是西方各国开始的大瘟疫传播,我庆幸我们各位还能写东西,还能留言。那些被装入冷冻车、尸袋的人是没有人替他说话的。

作者答:

果断放弃阅读这个公众号,那是你的自由,我赞成,无可厚非。

“没有更多了解武汉的人,以为这里是全部。”

我明确告诉你,不会的。

你知道我们宣传队伍养了多少人?花了多少费用?主流媒体全天候在报道武汉正能量,打开电视你看到什么?你一走会看到:

领袖的关怀,武汉人民奋战,全国人民支援,都很感人,都有泪点。

看来你也是个不读书、不看报、不听广播、不瞧电视的主,不然说不出这样话来。党和政府从来没有忘记“那些勇敢的人,那些在系统运作中的人”。

你有漠视党的宣传之嫌,小心小人举报。

倒的苦难的记载,尤其下层百姓生活的艰辛,很少能在电视、报纸、电台、杂志上看到听到。偶尔几个自媒体,个别志愿者自不量力的写点东西、拍点视频,发出来,也常受到 4 0 4 的特别待遇。

“那些被装入冷冻车、尸袋的人是没有人替他说话的。”

这句话我举双手赞成。

玉临风

接下去应该编一个儿子出来了

作者答:

谢谢。我倒很想有一个儿子,那就儿女双全了。可惜当年计划生育太严,一家只生一个好,政府负责来养老,我们信了。

只有一个女儿,编不出一个儿子来。

你的质疑我非常欣赏,非常非常的欣赏。怀疑是社会的一种进步,只有怀疑才能创新,才能揭示事体的真相。

怀疑和批判,是社会进步的动力。

只怕你只敢怀疑我等小民,绝不敢怀疑你的上面,那可是妄议之罪,你承担不起,也违背你初心。

民民

这篇文章可能比较真实,但是有些说法值得探讨,比如我们这个时代是否需要英雄?爱国主义教育是否正确?在大是大非面前,我们要与党中央保持一致。

作者答:

你这是在挖坑,没法回答,稍不注意带进坑里,永世不得翻身。

英雄不是塑造出来的,高喊爱国的人不一定爱国,与党中央保持一致是当今国策,我不敢妄议。多一句话,卖国是要有资格的,普通百姓想卖国都无人理睬,你说对不?

但一个社会只有一种声音,是不正常的社会,这是烈士李文亮最后的遗言,仅供参考。

无为

汉奸文学

作者答:

指方方?指我?你是那方神圣?一语定人生死。

不好意思,骂人汉奸的人常常自己成为汉奸。

还记得不?五四运动火烧赵家楼那位英雄学生梅思平,不多久自己成了大汉 奸。

记得不?西安事变那几个跳得最凶的东北军将领如孙铭久等,不久后也成了日伪汉奸。

至于智斗美国总统的反美义士,北大小女生马楠,还有袁木,司马南之流,都跑到美国去生话了。

动辄说别人是汉奸的人,不是理屈词穷,就是动机不纯。

有理说理,有事说事,你不是法官,也不是上帝,帽子不可以随便戴,话不可以随便说,有诽谤罪嫌疑,碰到认真的人,你会吃亏的。

天道酬勤

当中国取得抗击疫情胜利、美国自身深陷疫情深渊的时候,美国仍不忘恶心中国,抹黑中国,栽赃陷害中国,更企图借机转移国内矛盾,转嫁危机,嫁祸中国,并图谋通过议案让中国承担美国防控疫情不力的责任,让中国承担巨额索赔,这种行为暴露出美帝国主义可耻、野蛮、邪恶的强盗本性,我们绝不能让美国的目的实现,绝不能让这样的悲剧再次重演!!!

作者答:

我估计你可能是患有迫害狂综合症,或者是消息来源太单一。

中国受列强欺压的屈辱的历史,在中国共产党领导,在世界第二大经济体面前,在国家要独立,民族要解放,人民要革命的世界大趋势下,已一去不复返了。

稍有一点当代国际法基础知识的人,都知道这种悲剧不可能出现。至于两国之间利益冲突,不是今天就有。美国是我们最大客户,有时刁难刁难我们也常见,关键是我们危机处理水平。

邓公这方面,有高瞻远瞩的论述。

另外,世界上帝国主义国家很多,都有“可耻、野蛮、邪恶的强盗本性,”难道就不相处呢?人类命运共同体是不是不包括他们?

这事你说了不算,我说了也不算。今天打美帝,明天打苏修,后天打走狗反动派,已过去四十年了。不是你想咬谁就可以咬谁,一切听最高领导人指令:

“我们有一千条理由把中美关系搞好,没有一条理由把中美关系搞坏。”

“两国共同利益远大于分歧,合作是双方唯一正确的选择。”

静虑

欲壑难填!

作者答:

人老了,没有多少欲壑,就只推崇民主、自由、公正、法制、科学、独立这些,很好填。这是与党的社会主义价值观一致,不矛盾。

芸

方方不配作家称号!通过日记将自己变成了妖婆!她将日记变成了杀人不见血的刀!在武汉失去亲人们的老百姓伤口上撒盐!方妖婆是何等的残忍!

作者答:

我的文章下面留言,老说方方先生干啥,不爽。

至于配不配作家称号也不是你说了算。骂人更显得缺乏教养。同情你,估计是否失去了双亲?性格才如此乖张暴力。

好汉

据说,美国对方方日记断章取义,借此攻击中国,如果这样,也许就违背方方日记的初衷,这对方方和中国都不利。

作者答:

你多虑了,美国人不傻,是个契约和法制的社会。大多数美囯人也不会看方方日记,只有华人看得多,她的书进不了销售榜单前五百名。

浅笑嫣然

你女儿是可敬的英雄,是我们武汉人心中的恩人,不要拿那个方方说话,你自己会污你的女儿的形象。

作者答:

为什么这么认为?非白即黑?

我女儿不是英雄,就是一个普通医务工作者。她也不会高攀方方,我也不会拿方方说话,我只说自己的话。

老鱼头

现在世界上特别是美国的疫情远远比武汉恶得多,不知方方有何高见?

作者答:

那是美国的事,方方先生不在这里。

各国操各国的心,你太伟大了,胸怀世界,是个国际主义战士。

王植一

写得完全没法和方方老师比。内容冗长,实在难以看下去,建议作者不要写了。

作者答:

从来不与方方先生比较,人家是作家,我只是个文学爱好者。

不想看就不看,网上大量垃圾文字,有时我也看不下去,包括我的文字。

柏林

闲的无聊

作者答:

你日理万机,所以不应该留言。

你得也给别人留条活路吧,是不是?闲人也要活下去,也有自己打发时间的方法,对不?

王伏汉

战争是残酷的,这时候还想着自己的小家,怎么做家长的?怎么做作家的?方方的日记无异是涣散军心的宣传!记着:这是天灾不是人祸!武汉人不相信眼泪!我知道,你是一个虚伪的骗子,你不敢把我的话发出去!

作者答:

你太伟大了,我仰视。

我总想着自己小家,自叹不如。

我不是作家,方方先生是。你评论方方日记,我不便多言。但是不是骗子,能否涣散军心,自有公论。

终于看到一个大公无私的英雄,我过去总不相信,现在信了。

shuilian

方方日记2月份的基本看完了。说实在的,很多积极的东西也被悲剧和消极化了,凡事一分为二的看待!

作者答:

你的哲学学得好,辩证法应用得到位。只是弱弱问一下,希特勒能否一分为二看待?冒犯了。

张

站在三楼看楼下全是垃圾, 站在三十楼看楼下全是风景,

作者答:

你估计是生活高层,站得高,所以看得远。

我们没有你这么幸运,很伤自尊,仍生活在社会底层,不想看垃圾都很困难。

你有空的话,请偶尔移动贵躯,下基层看看,联系环卫单位,帮我等小民清除一下垃圾,这也有利于塑造你的高大形象。

可否?

张中华

你何必打方方旗号呢?难道她能给你什么力量吗?

作者答:

没有人打方方先生的旗号,也打不了。

尊重内心,只是个人的宣泄,文责自负,与方先生无关。

除了方方日记,还真没看过她写的小说,以后会看。

道德的人自有道德的力量,方方自有方方的魅力,你感受不到,不代表别人就感受不到。

不同轨道生活的人,互不干扰,各自安好,如何?

老干部大卫

微信号“汉阳一江水”是已经退休人员,估计已经是六十开外,外公外婆年龄应该八九十岁了。女儿关键是多大了,推算的话也应该三十出头了吧。所以,仅仅是当小说看看而已。

作者答:

谢谢你关心,我六十有二。女儿不到三十,博士毕业快四年。

不是小说,是记实小文。

不明白为何女儿三十出头,就仅能当小说看看?恕我愚笨,理解不了你的逻辑。

xing yue

呵呵,日记追了60天,后续日记继续看,说实在前期追,有同意观点,有保留观点,后续追只会越来越看清精英思想,为什么列?因为只要写国内疫情的,都是负面情绪,写国外疫情的,那都是满满正能量,司马之心人尽皆知。

作者答:

我没有那么大的国际观,中国人写中国事。三月十日行文,那时国外疫情没那么严重。

国外疫情负面文章很多,大多出自他们本国报纸电视,我国大报电视也常转载,估计你也看了不少,不存在满满的正能量。

我们饿肚子时,基本上不操心世界上三分之二受苦的人,没你那么有觉悟。

你是不是准备去支持亚非拉革命?或者亲赴欧美解救广大劳苦群众?我可不报名,怕给人家添乱。

我祈祷,衷心祝愿疫情在全世界快快过去,我还想再次去欧美自驾游,在那里我碰到了很多洋雷锋,很感动,很温馨。

胡荣18865325663

只有灰暗,没有阳光,这是什么日记?日记抗疫?还是出点力,流点汗,才是为武汉人民做贡献。

作者答:

认知不同,地位不样,经历有异,看同样一个东西,会得出相反的结论。

你要一个老人流汗出力?九百万市都关在家里,如你所愿,都出来流汗出力,政府可能受不了,禁令会成为废纸。

你这可不是个好建议。

日记是方方先生写的,我不过多评论。

大海中的一叶孤舟。

方方,你这个垃圾,你除了会猫哭耗子假之外,你就只会写些垃圾和不真实的东西来哄骗人,你这个垃圾,赶紧滚出武汉吧,

作者答:

跑到我的文章下面留言骂方先生,实在不厚道。

忍不住想骂你,可一想,对一个满嘴脏话的无知流氓,骂有什么用?那是自己给自己找不痛快,随你去吧,只当狗吠。

舍得

李文亮 是2月7日去世的!不是2月6日!第一句就写错了,下面那句是真的?!

作者答:

我确实是2月6日深夜获知李文亮去世的,至于后来又抢救到次日凌晨才宣布,那就各信各的了。

而且“第一句就写错了,下面那句是真的?”这句话是不符合基本逻辑的。

我党一大不是七月一日召开的,但后来的党代会定了七月一日建党日,我们也都认同,即使后来实证了,也不影响七月一日建党纪念日。

如果按你的逻辑说:第一次党代会日期都错了,那党史下面那件事是真的?

怀疑一切不好,容易犯错误,犯大错误。

平安车务中心吴萼兰13511106199

世界战争的苦难找谁算账???谁挑起的?包括这次没有硝烟的病毒战???罪魁祸首不值一提吗?日记是真实,起初我也陪泪看的,过度解读就只能糊弄普通吃瓜人了。现在武汉的水深火热某些政府正在全世界上演了。尤其是美国和欧洲国家!那里的民众是没有罪的。中国不计邪恶甩锅,依然帮助抗疫,为世界做贡献

作者答:

谁是罪魁祸首?告诉我,你立大功了!

不要偷换概念,大家在同一条船上。中央说了,不要嘲笑外国治疫经验,不要说帮助世界,大家互相帮助,共同抗疫。

目前世界各国,抗疫最成功的是日本、韩国,中国台湾和香港,中国在付出巨大社会经济成本,也取得阶段性胜利。

后面路还很长,谦虚点没坏处。

Mr.Huang裕晋

作者总认为自己是对的,每个自负的人都是这样!

作者答:

我从来不认为自己是对的,我不是标准,方方先生也不是,你也不是。

东晴西雨

这两天的方方日记接龙,就没有读方方日记那感觉。昨天扯的太运,今天这位,真诚到就不该把当医生的女儿,叫自己快快离开武汉的故事写上。不知海南人民欢迎你没?我们坚守武汉家中,有担忧,但很坦然。封城已提前通知了,1月23号上午要离开武汉其实很容易的。何惊何慌之有?

作者答:

你很坦然,我很佩服。

春节前,我的三个朋友聚歺吃晚饭,一个去深圳,两个留武汉,三人都中枪了,深圳那位康复,武汉两位不幸去世。

你很幸运,又不惊慌,了不起!

我去海南,早有计划,只不过提前几天了。如果真知道这么严重,决不会把高龄的外公外婆丢在武汉,拖也会把他们拖到海南。

全中国人忽多忽少歧视湖北人,更歧视武汉人。口号叫得响,普遍缺乏爱心,人性和仁德,这是没办法呢,自私是人的本能,我认。

好在我们来海南较早,虽出现强行扣压汽车一事,但总体未受大的侵扰,不知这样汇报,满意不?

晓君

美英国家说了,疫情过后清算中国,各位在清算后,再对前段日子进行反思吧,否则容易给美英帝国主义提供伤害中国的炮弹。

作者答:

一些政客说的,不必当真。清算不会,但双边关系有可能倒退,经济摩擦加剧。

我们提供不了炮弹,我们不接触炮弹。记住,只有朋友才有出卖的机会,只有接触机密的人才有炮弹出卖,我等屁民想出卖都没机会,人家都不会理的。

反思不会提供什么炮弹,不反思才真正会伤害中国根基。

头发甩甩

找不到汉阳一江水的公众号

作者答:

对不起,因刚改名为汉阳一江水,须晚一天才显现。

ggzzll

方方笔下的武汉是“人间地狱”,蓝蓝笔下的纽约是“世外桃源”,这是恶俗的双标。

方方、二湘、小编你们会下地狱,和纽约蓝蓝一样!

作者答:

蓝蓝是谁?不认识。

两个不同作家作品不好比较,你如果有机会看看外美国电视、报纸、网络,骂总统的,怪政府,宣泄负能量比方方厉害多,和中国主流媒体相比,更不能同日而语。

你怕下地狱不?我是怕的。咒人下地狱的人很容易下地狱,别只图嘴爽。

安涛

一句话:女儿比爹懂事。

作者答:

这句话不好回答。女儿懂事,高兴。我老人家也明事理,不糊涂。

尹哥

请问方方那么反党反社会,你们是怎么喜欢她的作品的

作者答:

这个帽子太大,不要随便给别人戴。

提醒一下,当年不少把别人打成反党分子的狂热分子,自己又被他人打成反 党分子。

作品好坏不是以作者政治倾向为标准,好作品大家都喜欢。

云淡风轻

志愿者也是父母的孩子,也都义无反顾的冲在一线,何况你女儿是医生,救死扶伤是医生的天职,所以你没什么好大篇幅写你的女儿的

作者答:

我不写女儿,难道写你?

我一不是记者,二不是作家,不写自己家里油盐酱醋的琐事、小事,我还能写什么?

我也想写志愿者,我也佩服志愿者,但我们家没有志愿者,身处外乡的人,我该从何处落笔?你告诉我。

对了,你为什么不拿笔,写写那些美丽的志愿者们?

开心乐

这个公众号主人到底是什么人?很邪恶!什么是极左?我看你们是极右吧,巴不得看到中华大乱的邪恶分子。你们不会得逞的

作者答:

一般人说得“极左”,绝不是指有革命激情的普通群众,包括你。

群众大多数都是真诚的,善良的,只是观点各不相同而已。

这有深层次的文化原因,也有民族感情的原因。

平等与阶级、真相与立场、情感与对错,博爱与亲疏、个人与集体、正义与伦理、事实与国家、权利与民族,这些观念的对冲,形成形形色色的我们,有矛盾,有分歧,是十分自然的。

“极左”是特指别有用心的原左旨主义者,那是客观的存在。

“极左”成分主要是部分学者、个别官员和文革的遗老遗少,数量不大,能量不小。极左的一套在中国仍根深蒂固,表现为:意识形态的习惯性思维,官学甚行,家丑不可外扬,宁左勿右等。这都是掩盖事实,歪曲事实的最直接的原因之一。

温总理在位时,反复提醒党内要反“极左”,不然文革就会死灰复燃,薄大公子就是“极左”典型。

有邪恶分子,也有极右,但都被抓起来了。社会对极左宽容,对极右严厉。所以才会有今天声势浩大的极左声浪。

查看历史,造成我党我国损失巨大的几次危难都是由极左路线造成的。

邓公说:要警惕右,但主要是防止“左”。

285A3

又开始扯淡了,吃过医院的饭菜没?那个标准你还想怎么样?为了煽情而这样瞎写有意思?有鱼有虾有肉你还想怎么样?

作者答:

瞎写了吗?没有呀,仅一笔带过。

你是从天上来的,还是地上蹦出来的?不食人间烟火。

这么维护领导,应该提拔。

Hhh

家常菜总是要有的,总是多数人愿意吃的,吃的放心,吃的舒心。吃的就是各人各口味,不合你胃口的你可以不吃,但是拿着与国宴比材质,比卫生,比烹饪,没有意义。

他们就是像自己动手做一顿饭,该喜欢的还是喜欢,不喜欢的依然不喜欢。

作者答:

提个意见,你不能这样偷换概念,然后摆出一番道理。这让我无法辩说,很伤人的。

你真应该去北朝鲜生活,那里很幸福,那里不会提意见,那里有你们的归属感。

芳

美国不也缺防护用品,也没见作者指责美国政府

作者答:

我们小民只关心身边事,不干涉他国内政。美国有反对党,有特不靠谱总统极反感的媒体,狗咬狗啦。你们可以获得许多刀呀,枪呀,匕首呀,还用我们指责吗?英国首相约翰逊得肺炎,还有40万个点赞庆祝,也不删帖,更没有用妄议罪抓人、训诫。

子不語

多关心一下你们美国吧

作者答:

人类命运共同体吗,当然关心美国,但更关心中国。

需要强调的是,很对不起你了,美国不是我们的,是美国人的,有可能也包括中国权贵、富豪们的家属、子女的,但绝不是我的。

美国有我许多朋友、同学、亲人,每天都联系,可能比你要了解的多一点。

灿

说新闻是在反帝抗日的人,不去对比一样外国的政府对中国的甩锅,他们的报道有过之而无不及,现在你们还能在这里安稳发文章,难道不该感恩生活在中国???人无完人,国也一样,谁也不是神!赞美疫情的控制就是对苦难的忘记吗?你们这些对政府是有多大的仇恨啊!

作者答:

你真是井底之蛙。美国骂总统的人多去了,人们仍安稳的生活发文章。

每个国家各有自己的优劣,我们爱国,才会指出问题,做驼鸟对中国没有好处。

现在电视报纸赞美、感恩的文章少吗?严重怀疑你没生活在中国,不然不会这么睁眼说瞎话。就这么一点点稍微不同的声音,你都受不了?

这和仇恨有什么关系?是你被仇恨冲昏了大脑

青卿

假如新闻里充斥着惨状描述,在抗疫关键时刻充斥着批判,描述医护人员的脆弱无助,对解决疫情会起到作用?会不会引起十几亿人的恐慌情绪?我其实挺好奇的。

作者答:

你的假设不成立。其实你是在制造恐慌情绪,以此来杜绝批评,逃避追责,展现莺歌燕舞的感恩场景。

有主流媒体,有党的坚强领导,在中国充斥着批判声,可能吗?

西方媒体声音可能多元化,起什么作用,你自己体会吧。

牛锡栏

作者字里行间充斥着好像医生不感染才是侥幸,难道全部医生都感染了才是应该?

这种观点我不敢苟同.

作者答:

你的阅读理解能力太差,小学毕业?不怪你。你信鸡蛋里面有骨头吗?我现在信了。

A祝华

相比较李文亮,过后看,这篇文章说明人性的自私!1月只自己家人说!!更体现悲哀!也能理解了不给中心医院捐物资的做法!李文亮是在群里提醒的人多了!正气才可压住歪风!如果都管各家自己!那再好的制度也会有漏洞的!国人的职业道德水准真悲哀!对不起医者的称谓!只管自家,自私自利的人多了,社会只能越来越冷漠!下次疫情N年后还会报复这样的社会!

作者答:

你勇敢,很敬佩,是个英雄。

但胆小自私的人是多数,专政的力量是无穷的。

谁造成自私自利的人多了?我女儿元旦就让我们离开武汉了,李文亮也把老婆孩子送去娘家了,这些都是事实。你想让他们怎么样?反抗社会,老子到处说,有可能吗?

你认为再好的制度都有漏洞,却不认为再好的人,在某种制度下,道德水准也会下降?

你把医生太高看了,他们是人,是普普通通的老百姓,承担不了政府应尽的责任。

有句话,站着说话不腰痛,很贴切。

东方

方方就反复说极左,社会呀,什么观点都有,有容乃大,不要乱贴标签了。

作者答:

是的,大多数人只是观点不同,这是不同利益、不同环境、不同背景造成的,是社会常态。

关键是不要压制不同声音,法无禁止即可为,法无授权不可为。

方方先生日记发与不发,在国外出版与不出版,你对她的文章看与不看,支持与反对,在法律框架下,都是合理的。只要心平气和的争论,有内容,讲事实,摆道理,那怕是批判,都十分正常的。就怕无理纠缠,文字粗野,精神煽动,恶语相见,那不是争论,那是批倒批臭的节奏。

没有平等的交锋平台,方方先生的辩解,说明和交待,常常被各大网站封杀,而对方方先生的恶语漫骂,暴力威胁和无中生有的造谣,在网络上畅行无阻,这可不是个好现象,让人不寒而栗。

我反复说了,“极左”是特指别有用心的原左旨主义者,那是客观的存在。成分主要是部分学者、个别官员和文革的遗老遗少,数量不大,能量不小。

我们绝不能走没有薄公子的薄公子道路,那是条死路。但有人喜欢,比如司马南之流。他对朝鲜那是五体投地的敬佩,他在中国过着富裕权贵的资产阶级生话,待着大别墅里却希望我等过朝鲜式的生活,用心不是一般的坏。

刘智生

是眼泪战胜了一切,人都沒精神了,还能干什么!诉苦吧!!

作者答:

如果你家有人染病离世,你不哭?哭了就没精神了?就不干事?

诉苦的事曾经在我国全面发生过,你小,你不知道。

有段时间,神州大地全面开展忆苦思甜运动。吃忆苦饭,干忆苦活,穿忆苦衣,启发大家不忘阶级苦,牢记血泪仇。

可能你没赶上,遗憾。

刘智生

哭吧!哭就把疫情战胜了,心里只有自己!

作者答:

没人说哭能战胜疫情,但总不能面对亲人离世笑吧?

你缺乏起码人性。

英子

不去关注全国人民抗疫的成绩,无视一线医务人员冒死救人的英雄壮举,不看新闻,只看方方躲在家里道听途说来的日记,不知道方方背后的某种居心吗?敢把反对、驳斥方方日记的留言登出来吗?弄一群水军吹捧不恶心吗?

作者答:

你弄水军惯了,总怀疑别人都弄水军。

不要在我文章下留言骂方方,拜托了。

你对方方日记有意见,可看方方微博留言。那里语言之恶毒,情绪之激励,骂声之刺耳,和你应该合拍。

只是那里只有批斗声,没有期许的人性味。

那才是真正水军,有组织,有计划,从不讲理,除了谩骂还是谩骂。

告诉你一个事实,公众号留言区只能放一百条留言,留言多了,小编自然有选择权。

燕子姐姐

在前期,有些人是有过失,但及时纠错,后来已经做得够好了,不要扭着不放。看看国外疫情吧。你们这样的言论会被美国利用来攻击我们的,也许其中有部分人已经成为了汉奸。

作者答:

你太没自信了,汉奸名词不要乱说,这是贴标签,最孱弱的做法。

郁志刚

天天在看,哪里有什么和谐?看来又是造谣了。故意制造对立的紧张空气!

确实比较真实,但不能上升到揭露罪恶的高度。无论是天灾还是人祸,都和罪恶无关。医生缺乏防护装备是事实,但并不是医院领导故意造成,有合格防护服而不发。看问题要全面。现在看来医院领导阻止接受个人捐助物还是明智的。假如支持了接受个人捐助,医生因接收了不合格物品而感染,不是又要被指责?

作者答:

你的辩证法学得好,我无言以对。

宇源江南

疫情全球爆发,我不希望再看见方方或者你们这种煽情文章。你们朋友的女儿是医生,抗疫真的很了不起!年轻的后生代医生真的很了不起,可我希望你们这样年老的一代从今往后闭嘴。

作者答:

你的希望有违法律,也违背社会公道。希望多读点书,增强个人修养,学会做人。

记住,独立之思考,自由之精神,是最佳补钙药。

你严重缺钙。

取舍有度

总是说这样不好,那样不好,要不你去美国,那里现在是最美的风景线,你去吧!

作者答:

如果你当领导,我们可能成为难民,万幸你不是。

仁之

呵呵,一句张文宏把你夹带的私货暴露无遗了

作者答:

我一直认为大公无私的人不存在,公而忘私的人是英雄。

而我连这点也做不到,这不叫暴露无遗,这是人之常情。

人情、人性你可能缺乏,不苛求。

去做个大公无私的人吧,那是圣人,很难企及,我等着你成为圣人。

Lita Liu

还在写,有意思嘛?

作者答:

没意思,但喜欢舞文弄墨,戒不掉。

你不看就好。

看看新闻联播,看看抗日神剧,你会有意思的。

陶子

都是实话吗?明明漏洞百出,年前就每天看方方日记?

二湘公众号小编回复

谢谢您细心指出。那句话是小编在编辑时,在文中换了个地方。确实疏忽了,没有意识到这一点。微信改不了那么多字。我把底稿改一下啊。感谢。-小编

作者答:

小编已经回复了,不知满意否?即使有点小出入,也不会漏洞百出,你怎忍心一棍子打死一家人哟。

口

整天看到的文章,不止是您的,太多了,一天几十上百,让我感到迟早要改朝换代了,如何解除这种思想或是坚定这种思想?

作者答:

多看电视,多看报纸,正能量满身,一定会解除那异端想法。

身体好才是真的好,思想好才是干部好苗子。

高云峰

狗粮吃完了,狗就不乱叫了,因为它迟早会叫不动的……

作者答:

你不会是五毛吧?常领狗粮?“老子”退休了,有退休金。希望看到你叫不动的时候。

程刚

中国政府是不是腐败到了要被推的程度?是不是要必须在中国搞颜色革命?

作者答:

这是你说的,没人这么说。

反腐是亲自的一大成绩,你可不能抹黑。

全民腐败是最可怕的腐败,希望不要成真。

阿楡

你无论从文笔,从情感,从时机,都比不了方方,真是成事不足败事有余,想害方方老师,画蛇添足,画蛇添足

作者答:

不能和方方先生比,只和自己比,自娱自乐。不想看就不看,眼不见心不烦。

你对方方老师热爱,我由衷高兴。

若水之韵

方方大姐:

向您请教个问题:当前抗疫尚未结束,全球疫情严峻,美国的" 中国病毒"喧嚣尘上,这个时候我们能做点什么才是真正对抗疫有益对国家有益?

追责吗?我相信官家,肯定会的,只是时机。

歌功頌德吗?不需要。放眼全球,中国抗疫答卷既使不是满分也是优秀,让很多某些先进发达国家羡慕嫉妒恨。

揭露阴暗面,掀起批评潮吗?不是不可以,应该全面客观、审时而为,而非天马行空、一意孤行。有为国为民情怀则更应用在于国于民有益的事上,对当前全球有益的事上,犹如“论文应写在祖国大地上”那样。而不应为一己名利信马由缰、肆意妄为,甚至为美 “ 甩锅” 争当马前卒,不管有意还是无意。

------ 一个同样关心抗疫的国人

作者答:

义正辞严,有理有节,比那些粗口秽语,粗鄙血腥之语,强不知多少倍。

只是有点偷换概念,模糊视听。追责不仅是官家的事,也需群众督促。不要不信,没有监督,就不可能有追责。

你民族自豪感满满,我很欣慰,但说中国抗疫答卷让很多先进发达国家羡慕嫉妒恨,有点言过其实。

民族主义可以增强了民族向心力,但也可以成为国家的破坏力,是把双刃剑。

这段时间,电视、报纸、电台从早到晚有批评声吗?都是慷慨激昂,奋进上扬的故事,每每听得让人热血沸腾,激动万分,这应该是你所想要的“全面客观、审时而为”的理想境况,你还不满足吗?非要全国山河一片红。

中国掀起批评潮吗?是有,那是针对方方先生。揭露所谓阴暗面从没有掀起什么“批评之潮”,过去没有,今天没有,未来一段时间怕也不会有。

可能连基本自责、反思和追责都会遗忘了。

一点点实际情况的叙述,一个人的战斗,几十篇日记,不能算是为一己名利,信马由缰、肆意妄为吧?更不应把美帝" 甩锅 "责任也算到老太太头上,不合适。马前卒更显荒唐,这是诛心之论,老太太纵有百张嘴,怕也百口难辩了。

多一句伤心话,在我的文章下面留言说方方先生是是非非,我不爽,很不爽,这是忽视我的存在,太伤人了。

糖

能否不再转发?没人性的揭伤疤是不道德的。

作者答:

请问,有人性的揭伤疤,有不?那是什么东西?能否告诉我?

谁都不愿揭伤疤,但决不能好了伤疤忘了痛。

良药苦口利于病,忠言逆耳利于行,老祖宗说的。

密码保护:江城记事之十二

密码保护:江城记事之十一

密码保护:江城记事之十

密码保护:江城记事之九

江城记事之八

龙大爷其人其事

(1)

龙在中国是图腾,是中国文化最重要标签。可能是与历代皇家忌讳“龙”有关吧,姓龙的人并不多,龙应该是小姓,我一生至今也只碰到这么一个姓龙的人。

这位龙大爷,看似普通,却又与众不同。中学刚念,碰上文革,年龄不大,下乡农村,滚爬五年,上调工厂,书香子弟终于成为光荣的工人阶级一员。六十岁之前过得不温不火,不声不响,但他决非池中之物,只要有机会,就会“最美不过夕阳红”,让你惊掉下巴。

他龙大爷不算老,今年还没到七十岁,精神头十足,爬上爬下,从事空调工程项目,至今没有退休的计划。春茧到死丝方尽,蜡炬成灰泪始干,他真正是活到老,学到老,干到老,是我等同辈真正的楷模。

我与龙大爷相识二十多年,算是老朋友,龙大爷长我几岁,是个大哥。他在出国前,很长时间是在我公司任办公室主任,担任我的助手和下级。

二十年前之所以选择年过半百的龙大爷到我公司任职,一是他任劳任怨又勤奋,有丰富的行政经验。二是他敢闯胆大脸皮厚,有死皮赖脸的韧劲。三是他不讲得失很敬业,有顾全大局的心胸。外出办事,什么办公室他都敢闯;遭人嘲讽,仍不屈不挠死缠硬磨。虽然他文化程度并不高,专业知识也缺乏,但他有钻劲,不懂就问,那怕问得低级可笑,也能坦然自若。他总有一股使不完的劲,让人耳目一新。

胜不骄败不馁,不达目的不罢休是他最吸引人的地方。

但他缺点也很明显,不太修边幅,穿着很邋遢,和我们这种在高档写字楼里办公的IT公司,总感觉有点格格不入。

我考虑再三,最终仍决定还是录用,让他加盟公司,因为他的优点正是我公司年轻员工所缺乏的。

龙大爷在五十岁左右以投靠弟弟名义,开始办理全家美国移民,一排队就是十多年。在他快六十岁时,终于接到移民局信函,批准了他的申请,让他全家到广州领事馆面审。

他高兴坏了,有点激动地告诉了我这一消息,没想到我当即给他泼了一盘冷水。以我的经验,我认为他们过不了面审这一关。一家三口,二个快六十的人,一个上高中的女孩,没有专业特长,没有职称技术,没有学历文凭,又不会英语,凭什么美国要接受你全家移民?美国傻呀,弄这么一堆负担过去。再说你们过去怎么生存,要年纪没年纪,要技能没技能,语言又不通,没有一点优势,总不能余下日子全指靠你弟弟一家吧。经我这么一说,老龙心冷了半截,也担心自己过不了面审关。但对美国的向往,克服了他“不愿去面试”的瞬间念头,抱着死马当活马医的想法,毅然决然动身去了广州。

结果呢?不用说,美国人并没刁难他一家,面审没问两句,没有半点设坎,当面就很爽快批准,顺利的让他都大呼意外。通过他这次面审,我也触动不小,个人对美国了解,受环境、经历和固化思维的影响,常常差之毫厘失之千里。外面世界很精彩,外面世界别乱猜,不懂装懂是最害人的。

龙大爷出国了,举家迁往陌生的国度,我很是挂念他。花甲之年还敢折腾,不知他那来这胆子。没有语言,没有技术,没有专业,到文化背景,语言环境,社会氛围,道德理念截然不同的异国他乡去闯世界,真让人既钦佩又担忧。

那几年我总是关心他在美国的生活,不间断与他联系,了解他生活现状。

他真是个奇人,总能给我们大家都带来了意想不到的惊喜。了不起,非常的了不起,六十来岁的人他创造了一个奇迹,一个非常励志的艰苦故事,一个老年移民的成功奇迹。

(2)

那年年底,龙大爷一家移民美利坚。

对未来的憧憬,让六十岁的他精神抖擞,应了那句话,无知者无畏。没有某些人的前思后虑,没有知识人的畏畏缩缩,他总是有那么一股精神,对那块未知、陌生异国他乡,第一次出国的他,充满着莫名的希望和信心。

龙大爷投奔的那长期在美国生活的弟弟,也是异类,不同凡响。他不仅把龙大爷一家弄到美国,还把龙大爷哥哥一家和他自己妻兄一家同时弄到美国。六个老人加小孩全挤到他家,吃喝拉撒,他不嫌烦,我都替他烦。

龙大爷和另两家老人们不同,他在国内退休金微薄,根本支撑不了他一家人在美国的生活。况且他是个自尊心很强的人,他不想再增添弟弟一家负担。仰人鼻息不是他的性格,他决定外出打工养活自己一家。

龙大爷妻子在国内从事建筑预算工作,来美无用武之地,为了尽快获得收入,她只能到华人家庭从事家政服务,这工作在美国相对容易找到。

龙大爷就难了,出国前临时抱佛脚,突击学得那点英语,连基本沟通都困难,更别说出门找工作了。况且他没有专业,没有技能,也没有一招鲜的职林秘诀和祖传神功,在美国东海岸他弟弟家所在的那个城市到处碰壁,无人理睬。

为了生存,他决定孤身一人,去华人较多的西海岸洛杉矶市,碰碰运气。

到洛杉矶后,刚开始那是极为艰辛的,吃住比在国内时,差的不是一点点。他租住在用火车皮改建的简易狭隘的宿舍里,这实际上就是贫民窟,生活条件极差,安全也得不到保障。由于语言年龄等问题,找工作也很受限,只能在华人社区寻找机会。他每天早出晚归,东奔西跑,为了节省开支,不敢在外面吃,只能忍饥挨饿,拖着疲惫身体回住处时,再自己去做饭。风里来雨里去,大街小巷找机会,终于在十几天后找到一份工作。那就是在华人超市的水产区找到一份给客户剖鱼的工作。这份工作每天上午工作四小时,月薪一千美金,是本地人不太愿干的工作。但龙大爷好高兴,这是他来美第一份工作,虽然脏苦,他十分珍惜。

他把获得的工资分成三份,一份交房租,一份寄回家,一份用于自己生活。

他很清贫,却未丧失信心。虽然他知道那个华人老板欺负他这个外来生人,他也知道这工资明显低于当地最低工资,但他没有怨言,总算有了立足之地,就有了生存下去的基础,那就会有机会。况且他只工作一上午,有不少时间去了解美国社会,观察经济动态,寻找发展机遇。那两三年他的生活十分艰困,付出了常人难以体会的苦累,好在,他挺过去了。

他一方面任劳任怨工作,即使是剖鱼工作,龙大爷也剖的比别人好,剖的比别人快,剖的比别人干净。

由于他的认真劲,引起一位经常买鱼的华人注意,不久,这位华人邀请他到自己公司工作。虽然工资给的也不高,月薪只有一千四百美元,但可以坐办公室了,视野相对也拓宽不少。主要业务是从事与国内方面合作拓展工作,那段时间他还可以经常回国,算是个白领,他有点心动。

在剖鱼工作一年后,他决定跳槽到这家公司。

在这公司工作两年期间,他留个心眼,为未来做点准备,对洛杉矶市的市场进行了详细考察。他感觉美国家庭都是用窗式空调,这是个商机。大陆过来的华人都习惯用分体式空调,更新要求旺盛,有很大的需求。于是他只要有空,就去华人开的空调电器商店转悠,展开市场调查。他常去的华人空调商场的老板也是大陆过去的,所有分体空调均是大陆生产进口过来的,有稳定的货源和客户。他逐渐和华人商场老板热络起来,有时商店空调安装忙不过,他就去帮忙。经过一段接触,他终于赢得经理信任,也掌握了空调安装技术。有一天商店老板同他商量,问他愿不愿组织一个施工队,负责所有空调安装。他大喜过望,感觉天上掉下馅饼,这个好机会他怎么会放弃。他立即到公司辞去工作,招了两个华人,组织一个小小施工队,干起分体空调安装工作。

能吃苦,不怕累是龙大爷一贯作风,从小养成。他很珍惜这次机会,事事身体力行,事必躬亲,锲而不舍。在工地上爬上爬下,对客户笑脸相迎,服务上尽善尽美,工作上认真负责,他在客户里建立了一定信誉,与商场也形成良性互动。

这一年,他个人有了几十万美元的进账,终于在美国立住了脚,过上相对富足生活。

随后他成立了公司,招募了几十个黑人员工,和几个电器商场都有紧密合作关系,扩大的业务规模和范围,收入也节节上升。他在洛杉矶市购了别墅,买了豪车。居安思危,他还准备到墨西哥和中国去投资别的业务。

成功的华丽转身,用了三、四年时间,从一无所有,龙大爷终于在六十多岁当了美国人老板。

后来他在微信里对我说:

现在主要经历放在做项目上,美国做生意没有走关系的说法,只需要能力。任何人只要你努力,都可能取得成功。我能在六十多岁时,在美国开创这么一片小天地,就是这个体制给的机会。而在大陆做事情,首先要问你,是不是有关系。没有关系很难做成,全部经济就是关系经济,想发展必须天天想着法子拉关系,请客吃饭送礼是主要工作。

美国人的自由度也要高一些,不用顾忌什么政治问题,每个人都可以安心做事情,每个人都可以自由的发挥自己的喜好和专长,社会给你公平合理的待遇。

国人虽多但是不如美国的市场需求大,中国人舍不得用钱,消费低,美国人借钱消费。

在大陆和美国我都生活过,在大陆,领导就能主宰一切。而在美国,老百姓主宰一切,法律是至高无上的。

美国有很多中国富豪高官家属,我做空调常常和他们接触,中国有点条件的大多数都走到这里来了,这很能说明问题。

(3)

龙大爷在国内时也喜欢折腾,虽然成效甚微,但追求成功的信心总是旺盛。

但这次他受了一次大大的挫折。

怎么回事?请容我慢慢道来。

1999年龙大爷与朋友吴某某签订协议,合伙接手XXXX自修大学执照(后改名为XXXX专修学院),主要从事成人教育的自考助学工作。当时两人身无分文,白手起家,吴某主内,龙大爷主外,他们租了一所废弃的中学里几个房作办公室,那设置简陋的让人难以相信。在这环境下,他们跑高校,寻求合作;跑教育厅各部门,争取招生指标;跑基层农村中学,动员高考落榜学生,尽量扩大生源。经过他们不懈努力,硬是把这个大学办了起来。

学校开办初期困难是有目共睹的,无资金,无产地,无师资,两人不分昼夜,忘我的工作,一路逢山开山,遇水搭桥,终于取得大学自考生助学招生资格并搞到了那关键的招生指标。这可是大学学历教育哟,两个人就撑起来了。神奇,神奇,只有我们这块土地,才能创造这类神奇。

两年后,学校终于有了很大起色,每个学年可招生几千人。生源有了保障,收入就很稳定,而且随着时间推移,收入惊人增长,速度让人惊诧。

有些人可以共苦,但无法同甘。龙大爷朋友吴某某在巨大利益面前,开始有了贪心,他想独吞这个金娃娃,开始有步骤有计划的排斥龙大爷。

也许是龙大爷太善良,没有防备之心。

随着学校高速发展,他的工作越来越少,最后就成了个闲人。吴某某大权独揽,人事,财务,招生,外联(高校和教育行政机构),再不让龙大爷插手染指。

2006年龙大爷发现一份会计事务所2000年11月的验资报告,吴某某成为唯一投资人。龙大爷一气之下,当年6月7日就向武昌区人民法院起诉合伙协议纠纷,因感觉对方在该区法院关系不浅,不久撤销起诉。随后他向青山区人民法院起诉要求确认合伙关系,受理后因地域隶属关系又被迫再一次撤诉。只得重新向武昌区法院起诉,为了节省诉讼费用,他耍了点小聪明,把诉讼标的改为股权确认。

龙大爷他没钱没资源,连律师都请不起,只得自写诉状,独自一人上庭辩诉。和财大气粗的吴某某相比,他实在没有什么优势。吴某某不但和法院关系不错,还有专门的法律顾问,同时请了一位名律师来一起打这官司。吴某某势在必得,信心满满,完全不把龙大爷放在眼里,甚至把龙大爷赶出了学校

不出所料,毫无悬念,龙大爷一审输了。2007年10月武昌区法院一审判决,龙大爷败诉。

龙大爷一审失败后,他非常不服气,找到我,希望我帮忙,为他打上诉官司。他知道我有律师资格,熟悉点法律业务。我对他说,作为朋友,我可以免费帮忙,但我们没有优势。一是我长期没有从事法律实务工作,经验缺乏;二是不太熟悉法院系统,没有关系;三是你没有一点活动资金,有些疏通就无法进行。有道是法院大门八字开,有理无钱莫进来,民事官司是需要一定费用的,这官司真不知道该如何打下去。我只能从法律条文上据理力争,能不能胜诉那只能祈求上帝了。

龙大爷憨厚地笑笑,没说什么,就是请求我帮他打二审官司。我免于其难,接受这项业务,但提出不收费,不找关系,不请客,只是提供上诉文书和上庭辩护的工作。他满口答应,并反复表示感谢,让我不好意思再推辞。

没想到2008年2月武汉中院出终审判决,我们完胜。可能是对方太大意了,也可能是中院法官比较正真。我也很高兴,总算我为龙大爷讨回了公道。

可是我高兴太早了,后来才知道中国法院的诉讼系统很复杂,民事关系打个十来年是常事,终审判决也没用。

果然对方向省高院申请再审,听说省高院有位慱士法官是他们好朋友,为他们出谋划策和疏通关系。省高院2008年9月做出裁定,指令武汉市中院另组合议庭再审。2009年10月,武汉中院再审,我与龙大爷又开始组织材料,应对答辩。10月13日中院再审判决维持中院原判,中院再次判决我方胜诉,这是第二次终审判决。

这次该没什么说的吧,两次终审判决都是我们完胜,他们还会有什么招呢?我知道对方会再跑到省高院申请再审,但一般这是没用的,没有新的证据,在两次终审他们全输情况下,高院一般会驳回申请,不予立案的。

没想到是高院不但受理,还裁定该案由武昌区法院另组合议庭进行一审的再审,球又打回原处

这没完没了,何时才能了结?我也没有精力了,龙大爷也疲了,一个身无分文的穷光蛋,和一个有亿万财产的人打官司,不输也把你拖垮,我和龙大爷投降了,认命了,决定缴械投降,不再应诉了。

中国司法真的需要改革,这是普通老百姓最后指望,如果腐败了,人民还有什么路可走。

(4)

龙大爷住在青山区,龙大爷的哥哥也住在青山区。

青山区有什么特点呢?青山那是中国大型国有企业武钢所在地,产业工人聚集点,那一片社会治安极为不好,小偷混混很多,当年是武汉市最不安全的地方。

龙大爷哥哥有一男孩,也就是龙大爷侄儿。这个晚辈从小就很聪慧,继承祖上书香遗风,学习优秀,人也长得一表人才。尤其是语言天赋很高,英语一点就通,是一颗能造就的好苗子,是全家的希望。

可是事与愿违,他侄儿进高中后不久,跟社会上混混搞到一起,经常逃学逃课,成绩一落千丈。老师管不住,学校管不了,家长也一筹莫展,只有叹气的份。抽烟喝酒,打架闹事,他侄儿成了那一带赫赫有名的学校刺头和社会街头一霸。

龙大爷哥哥来找龙大爷商量,说孩子如果这样下去,就废了,就会从人变成鬼,遗害全家,遗害社会。

他希望龙大爷想个法子,救救孩子。

龙大爷想来想去,就对他大哥说:必须改变环境,在现在环境下,再怎么努力都没用,狗朋狐友太多,一招手一呼喝,什么努力都白费,换环境才能斩断这些联系,才有可能重新振作。

可去那呢?谁会接受呢?他们马上想到的是去国外,那里环境与距离对斩断过去丝连最为有利。但没有钱怎么去?在那个相对宽松环境下,这小孩能适应吗?会不会吃力不讨好,在腐朽没落资产阶级思想影响下,成为著名垮掉的一代或国际黑社会成员?

但现实摆在眼前,不走完全没希望,这颗救命稻草理论上虽只是有一线希望,但对他们一家来说却是最大希望。

龙大爷对他哥哥说:你这孩子英语好,出国不失为一条好方法的。只是出国留学费用太高,不是我们现在能承担起的。但北欧有好几个国家提供全额奖学金,吸收中国学生去念书,没几个人知道了解,经常指标下放教育厅,没人去,就白白浪费了。我现在搞成人高考,经常去教育厅办事,能探到点消息,我去关注一下,看有没有这个机会。

随后,龙大爷把他侄儿叫来,他知道这侄儿一直有一个出国的梦,就投其所好。他告诉侄儿,如果他英语能通过托福TOEFL或雅思IELTS,他保证可以送他出国,费用他来想办法。

侄儿听后,自然高兴不已,但听说出国需要中学成绩和评语,他怕过不了。

龙大爷忙打包票,中学事他来处理,让他安心把英语搞上去。龙大爷这么说,就是怕他有畏难情绪,打退堂鼓,息了这三分钟热情,没了干劲,那一切都是白搭。

没多久,龙大爷打听到教育厅有芬兰的留学指标,芬兰政府提供全额奖学金,吃、住、学费全包,属文化交流项目。

龙大爷赶忙跑到厅里,找相关人士,拿出他软磨硬泡的看家本事,经过艰苦努力,争取到一个指标。当年武汉市几乎无人知晓中国还有北欧奖学金留学这一好事,大多人眼光盯着美加、西欧和澳新,要不就是香港、新加坡。有权、有势、有钱、有关系的人,几乎都忽略这北欧留学指标,不然,那有龙大爷他的份。

龙大爷侄儿所在中学听说家长要把这小孩送出国,非常愿意配合,这等于为学校除了一大害。所以家长叫他们写什么他们就会写什么,什么推荐信,成绩单,个人品行鉴定都完全编造,就希望尽快把这瘟神送走。龙大爷也是抓住学校这一心理,不费吹灰之力,拿到他需要的所有资料。

龙大爷侄儿也很争气,英语考试成绩不错,龙大爷全程代办,跑东跑西,终于拿到芬兰某大学入学通知和出国签证,把侄儿送到了北欧。

说得简单,其实过程是很曲折的,几次差点泡汤。没有龙大爷全身心的投入和不到黄河不死心的执念,这次仿佛天下掉下馅饼是很难接住的。

到北欧后,龙大爷侄儿完全适应那里自由环境,他全心学习,努力融入社会,做义工当志愿者,忙得不亦乐乎。读完大学,读研究生,在那工作,然后办自己的公司,还娶了一个美丽俄罗斯富家少女为妻,成为成功人士。

说到这些,龙大爷极为自豪,北欧的民主社会主义制度又把他侄儿从鬼改造成人,而这个过程龙大爷是功不可没的,这是他人生一大亮点,他常常为此沾沾自喜。

如果侄儿当年继续留在青山,他很可能就成为一个劳改犯,社会的弃儿,他的那些难兄难弟后来很多就是走了这条路。他的努力,挽救了侄儿,挽救了他哥哥一家。

在龙大爷去美国的前几年,他侄儿带着他美丽的异国妻子,衣锦还乡回到家乡,探望父母,拜访亲人,会晤朋友,寻找商机。

龙大爷看到衣冠楚楚,活力四射的侄儿,非常兴奋和欣慰。在龙大爷见到好友包括见到我时,都会喋喋不休说着没完,难以掩饰内心的喜悦与自豪。

人变鬼,鬼变人,是命吗?也许是,也许不是。

密码保护:江城记事之七

密码保护:江城记事之六

江城记事之五

女儿,你行(外二篇)

我女儿内向,不善交际,自信心相当缺乏。

中学时,每次考试后,不论考得好或是不好,她都真心地认为自己考得不好,绝不去估分,也不敢去估分(包括高考),她怕估分弄得自己心情不好,徒添烦恼,宁愿掩耳盗铃,自我麻醉,今天好过今天过,明天再说明天事。

女儿看似散漫,沉默寡言,无心无肺,其实她极有主见,外界风云对她影响极小。她喜欢随心所欲的生活,没什么雄心壮志建功立业想法,只想老老实实做一个真实的自己。

女儿,不论老师给你什么评价,是好是坏,我们都不曾给你很大压力,我们希望你快乐生活,你表面上看来也没什么压力,但极度自卑说明你的不自信,说明你在压抑自己。女儿,你行!你高中三年来进步神速,你是我们的骄傲,你应该自信,你必须自信。

其实女儿考试一次比一次好,是一位十分优秀和有潜力的学生。

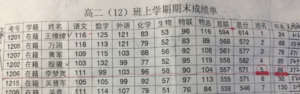

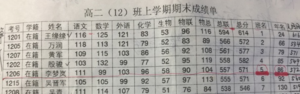

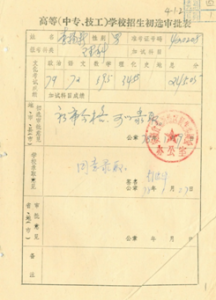

我女儿今年高考取得624分的好成绩,同时通过华中科技大学自主招生,现在已被该校三大热门专业之一:八年制本硕博连读的临床医学专业(原同济医科大学)录取。这对于一个平行班的学生,一个进高中时年级排名四百名以外的女生,不能不说是一个了不起的进步。这充分说明了你的能力和潜力,没必要把小学初中的包袱永远背着,你已经用行动证明,你行,你有常人少有的才华和毅力。

我女儿在武汉出生长大,记得中考时,作为武汉第一批初中课改试验班,她是第一批采用位置值录取的初中毕业生。

05年中考时,分数出来了,满分位置值为7.5,最差为54.9,数字越小越好。

她位置值只有22。

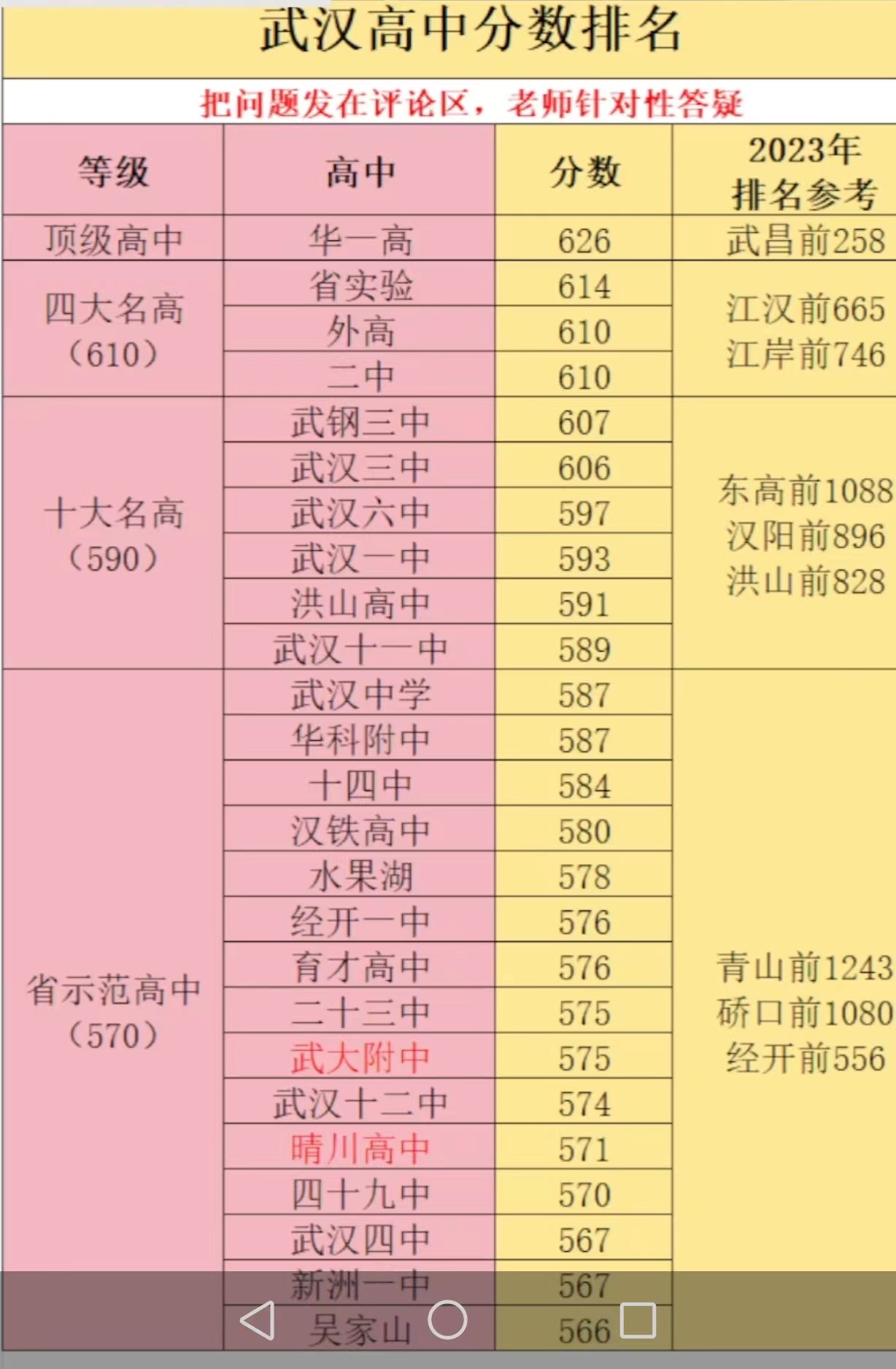

这是一个中等水平的成绩,进不了武汉前十位最好的高中,(华师附中录取线为11分,武汉二中为12分,省实验中学为13分,武汉外校为13分,武钢三中为15分)当然这符合当时她的学习现状,小学初中她成绩都很一般。

当时我们给她两个选择:

一是找关系出点钱去名牌高中重点班当借读生,一是按她的分值该分到何校何班念书就在那念书。

她没犹豫立即选择了后者。

在高手如云的名牌高中念书,对她是折磨,会彻底丧失自信,她不愿,也没有勇气去挑战自己。当时她有点自卑又心存不服,她希望在宽松平等压力小的环境中奋斗,我们也没犹豫,立即尊重她的选择,没有再叨叨絮絮。

她分数仍达不到武汉中学(武汉中学虽不是名校,但也是省重点中学,20分录取值,在武汉市高中排名大约第十五名)的计划生分数值,但达到调节生的分数值,她只能以调节生名义进入武汉中学平行班学习。(计划生、调节生、三限生、借读生主要区别是:计划生不用交赞助费就可进校读书学习的学生,调节生是要交部分的入学赞助费才可进校读书学习的学生,三限生是须交足额赞助费后,可进校读书学习的学生,三者都有本校学籍。而借读生是指须交一笔不菲费用,且没有本校学籍的,可作为插班生进校读书学习的学生)而她的初中同班同学不少以计划生去了华师一,武汉二中,省实验等名校,相比之下,未来对她是一个更严峻考验。 一般女孩子,初中成绩不理想,高中时很难赶上来,女生后劲不如男生,一步挪下基本上步步挪下,所以我们内心是挺担心着急的。

她还没有时间考虑自己未来,毕竟是高一学生,未来对她似乎还很远,但我们有感觉,她心有不甘。

那一级武汉中学,高一年级设有一个火箭班、一个实验班和十四个平行班。从过去几年经验来看,十四个平行班里能有十几个达到一本大学分数线就烧高香了。她的班主任,一位年轻的数学女老师,三年高中毕业时,学校给她的任务指标也就是:确保全班有二人过湖北大学的分数线。班主任对女儿最大期望,是毕业时能考一所好的职业技术学院或者三本,就很不错了。(这几年来,全校每年也只有50至100名不等超过一本线,5到20名不等超过600分)

刚开始我们没看出她努力,但却看出她不自信。她总认为自己不如别的同学,即使后来她超过他们,她仍认为他们比她厉害。在这样一个背景下,我们仍以鼓励为主,希望女儿尽可能不带任何压力,轻轻松松去读书。

女儿进校时,年级排名是靠后的,在她所在的平行班级也是靠后的。她在她的班级,全班五十八名同学中,只排在三十五名开外,在班级相当不显眼。

由于女儿性格内向,不善表达,且名次差距太大,所以表面上她无所谓但我们想她会急在心里。毕竟三年一晃而过,成绩能否提升,提升到什么程度,她心里没底,我们也爱莫能助。

但我们知道现在给她施压会适得其反,所以我们从不在她面前显露担扰表情,总是以宽慰她,尊重她,相信她,不培优,不请家教,给她充分自主权利,不逼她也不支持她熬夜苦战。

她也真不客气,高中三年来即使高考临近时,她也从未熬夜到十一点以后,只要到十一点时,她立即放下书本,上床休息,重点班的人都不敢这样。

在这种宽松宽容宽解的环境下,她充分释放她自己的潜力,进步那是惊人的,相当的惊人。

她虽不自信却能以平常心对待学习,她虽不刻苦勤奋但却踏实认真,她虽从不熬夜但能按时按量完成作业。不分心也不贪玩,一步一个脚印,踏踏实实安安心心在平行班里上课学习。(在家偶尔也偷看武打小说,高一时,还利用中午休息时间,和另一初中同学好友合写了近二十万字的武打小说,后被老师发觉,告之我们,才被迫中断。)

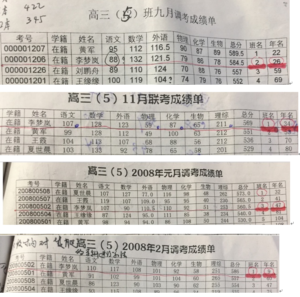

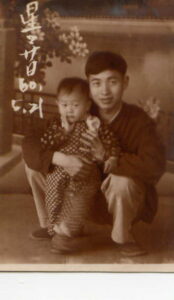

当年武打小说部分原稿

到高一上学期结束时,女儿有了一点点进步,在班级排名升至十八名,全校排名升至三百七十二名。

下学期结束时,在班级排名升为第八名,全校排名升至一百二十八名。

我们和老师对她的进步都及时给予赞赏和鼓励,虽然我们并不十分满意,时间很紧迫,进步尚达不到期望值,但我们从不流露丝毫埋怨责怪着急的情绪,以快乐感染她鼓励她,肯定她的表现,奖励她出去游玩。

她仍不紧不慢的学习,但进步己加快,高二上学期末已进入班级前五名、年级前八十六名了。

高二结束时稳居班级前三名。

进入毕业班后,在老师指导下,女儿成绩稳定上升,九月全市调考,成绩己在学校二十六名,班级第二名了。

十一月联考、元月份调考成绩虽有起伏,但都进入年级前五十名,班级前三名。

虽然仍在平行班学习,虽然仍不熬夜,虽然仍不温不火,但平常的心态却让她积累了上进动能,后劲较足。

到二月、四月调考时,她已稳居学校前八名。

四月调考成绩与高考成绩一样也是624分,一跃跨入600分以上行列,在学校所有平行班学生中名列第一。(她们班名字从12班调整为5班,其他一样)

高考时,她不紧张不怯场,睡得好吃得香,考试前一晚她十点就上床睡觉,外面电闪雷鸣风雨倾泄,也未能吵醒她。

即使这样,她内心仍摆脱不了自卑心理,自信心仍未提升。

高考完后,她自感考得不好,不敢估分,也不愿报提前批招录的学校,怕分数不够丢丑,如香港的几所大学。(而当时报提前批学校如果不录取并不影响后面报考,而后来公布她的分数时,才发现她已过了当年香港几所大学的录取分数线)她这个毛病这几年一直存在,每次考试不论她考得好坏,都会自我感觉不好,不敢核分,不愿面对,而实际上,大多数情况下,她都考得都很好。

果然她考得不错,不负老师家长厚望,稳定发挥,终于以624分创造了一个平行班的奇迹。

从中考到高考,从年级四百多名到年级第六名,一个女孩成功地超越自己,这是个了不起的成绩。

可是取得这么好的成绩,我们仍未感到她自信心大增的苗头,她仍不能正确认识自己,正确评价他人,她能以平常心对待平行班,对待自己却不能骄傲地对自己说:我行,我能做好任何事,没有什么困难可以压倒我。

对一个在一般高中,一个一直在平行班学习的女生,女儿你的成绩真是了不起,你跨越了常人很难跨越的障碍,你比那些状元更聪明。你在高中三年从未熬过夜的情况下,在一个氛围一般的环境中,在学校并不重视的班级里,你能取得今天的成绩,说明什么?说明你行!

你应该昂起头,初中小学说明不了什么,你行!

你可以平视全国最优秀的高中毕业生,你有这个资本,你行!

树立起你的自信心,我们支持你.

女儿,你行!

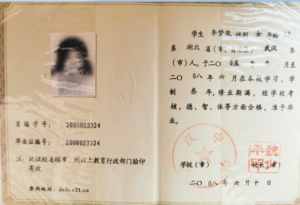

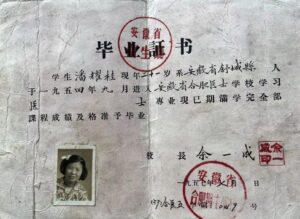

高中毕业证

这是梦岚中学第一次获奖励,全校三个年级仅有十二人获武汉市政府2007至2008学年高中奖学金,其中她们年级600多人中五人获得。在这前,班干部、三好生、表扬、奖励与她无缘

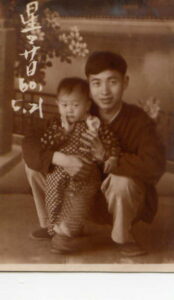

这是一六年,25岁的女儿博士毕业现场

另:武汉《长江商报》周日(2008-06-08)高考2008·故事 B13版上配图大幅刊登梦岚高考出场时其母亲手持17朵白玫瑰迎接17岁女儿出考场报道。

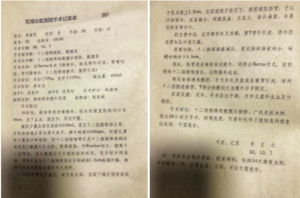

下面是报道原文:

17朵白玫瑰迎接17岁女儿出考场

为了给孩子营造舒适的考试环境,李家四口各有分工

本报讯(记者杨扬)

昨天11点半,武汉中学考点铃声刚一响过,家长们就涌到了校门前。人群中,一位撑着遮阳伞的家长手捧一束鲜花注视着校门,“女儿看到这束花肯定很高兴,我想给她一点鼓励。”这位邹姓家长告诉记者,女儿小李就读于武汉中学。为了让孩子有个舒适的考试环境,家人上上下下都分有任务。昨日上午,邹女士和丈夫将女儿送到学校,等考试铃响后才离开,孩子的外公外婆在家中,准备丰盛的午餐。在回家的路上,邹女士绕道来到一家花店,取走了事先预订的鲜花。邹女士喜欢白玫瑰,便精心挑选了17 朵盛开的白玫瑰,“女儿今年17 岁,17 朵白玫瑰象征着花朵一样的女儿。”看见鲜花后,孩子的外婆责怪邹女士乱花钱,“但我觉得这束花应该买,女儿走出压抑的考场,如果看到鲜花,一定非常高兴”。谈及用鲜花迎接女儿,邹女士透露,她还有一个初衷,希望能再见女儿小时候的天真笑容。邹女士回忆说,女儿最开心的笑大概是在两岁时。“那一年的圣诞节,我给女儿买了一双小袜子,挂在女儿的床头。”第二天早晨,孩子在袜子里发现了最喜爱的泡泡糖,满屋子雀跃欢呼。“那种灿烂的笑容我一辈子都忘不了。我希望这束鲜花,能让她重温那种快乐,再现灿烂的笑容。”11 点半,早来等待女儿的邹女士和丈夫走到考点大门旁迎接女儿。11 点50 分,校门被打开,数百考生蜂拥而出。小李率先走出了校门,邹女士一眼看到了女儿,提醒丈夫赶紧上前,将女儿拉了过来。看到白玫瑰,小李有些意外,笑呵呵地接过鲜花,和父母一起高兴地回家了。

外一篇:

给女儿的一封信

亲爱的女儿:

写这封信,我在你刚上大学时就开始考虑了。

在08年夏天,你高考录取通知书收到,老爸在专门为你写了一篇小短文《女儿,你行!》时,就想给你写这封信,想对你提出一些忠告,谈谈一些观点,说说一些经验,但几次提笔,又几次放下。因为我们之间十几年来从未通过信,认真的交流也几乎没有,况且我知道你是不会喜欢听我严肃的“说教”的,可能多少有点代沟吧。因为我不太会煽情,不太会描述那些艰辛的动人情节,也不太会声情并茂地记录你所走过的点点滴滴,大多数还是十分成人式、概念化和空洞式的大道理说教,不一定你爱听,所以就一拖再拖,直到今天。

只是今年春节时,在家宴中你的一席话,给我很大触动,促使我给你写这封信。我们是应该像朋友那样,好好交流沟通了。即使你不能赞同或者完全不能接受我的意见,但我们总应该彼此了解对方的观点和看法,达到求同存异,和谐发展之效果.也算老爸送给你的一份礼物,一种心意表达吧。

在当时家宴中,欧阳姐姐就找男友一事询问老爸,老爸提出了一点看法。当时你说老爸从没这么认真坦荡地和你聊过学习生活和感情上问题,这使老爸深感愧疚,这是爸爸的不对,对你关心不够,为此老爸应该向你说声道歉。

现在回过头认真想想,从小到大,老爸没有为你的学业操过多少心,在幼儿园,小学,初中,高中我们就很少让你去培优,也不勉强你像其他小孩那样去学画画、弹琴、舞蹈、打球等特长技能,(这点你老妈做的比我稍好,你小时候我只带你去公园玩,学习事甚少过问)我们采用顺其自然的无为学习方法对待你,也不知是对是错?

早期我们也很是担心的,你小学中学甚至到高三毕业时都在普通班,且大部分时间都还不是班上的佼佼者。你也从未当过班干部,更没获过什么学科竞赛奖和三好学生奖,这不能不让我们内心不安,但我们时终都没给你太大的压力。

你高一时,每天中午都在写长篇武打小说(二十万字),班主任老师告诉我们,我们也没干涉制止,只是从正面引导。你高中时段从不愿熬夜学习,一般十一点就上床睡觉,我们也不强迫,因为我们看到你在努力。爸爸始终认为只要你努力,就不可强求。即便高三时,你们老师在家长会上对家长和同学说:

“现在学生太辛苦,家长要督促孩子不要睡太晚,在十二点睡觉就可以了”。

我们听后只是对你一笑,仍然按你要求大约在十一点睡觉。爸爸事业虽不算成功,不能大富大贵,但经济条件也应该在全中国人口百分之五以内,老爸尽量为你提供最宽松最自由氛围和物质上基本无忧的环境,决不会让你因父母经济和物质上原因而失去学习上进的机会,并确保你的生活在你同学中只好不差,这点老爸做到了。但我们对你的具体学习生活关心确实不多,今天你所取的成绩基本是靠你的自觉学习,踏踏实实,一步一个脚印才取得了。你读过很多很多书,严谨认真,不骄不躁,方法得当,虽特爱好历史,但理工课从不放松,心境较平静,不好强争胜,也不轻易言败,默默耕耘才有可能取得现在的成就。

你从小学到高中唯一的一次获奖,是高三快毕业时你获得市政府2007至2008学年高中奖学金。而你们毕业班600人中仅五人获得,全校三个年级也只有十二人获得。我们很看重这个奖,这是你几年辛苦的回报。是很大荣誉,是你的骄傲,更是我们的骄傲,这说明你的努力没白费,我们的方法也有效。我们唯一遗憾是儿童时没强迫你学习个诗琴书画,没有这类爱好,让你少了一些多姿多彩生活调剂技能,和其他同学相比,缺乏业余特长,不易展现自己,这让老爸有点后悔。

你是个十分乖巧的孩子,身材高挑,长得可爱漂亮,还有一个迷人的米酒窝。你执着地注重公德,正直向上爱憎分明,常纠正老爸生活上坏习惯。你与人为善,对朋友真诚热情。你听话又有礼貌,从没有恶言恶语。我们感到你懂事很多,也长大了很多。总体上你在女孩中算是既美丽又有教养的女孩了。但在生活上,你也有个很大问题,就是不会做家务,生活治理能力差。更主要就是你明显的营养不良,这是我常对你说,而你又最不愿听,最反感我说这话。你为身材节食过度!你本就很瘦但还几乎不吃荤菜,由于对健康方面的理解有误区,你为了怕所谓长胖而不愿多吃。荤菜吃得少了,饭量也少,很显然有点营养不足。在学习紧张时睡眠也就不可能好了,这样怎么会有旺盛的精力投入学习呢?生命是很脆弱的,所以孩子,永远记住,做任何事情都把健康与生命放在第一位,哪怕是牺牲掉工作学习和利益。也许我有点杞人忧天,千万不要由于自己的任性或固执而损害了自己的身体和形象,那是最令人痛心的,怎么着也不能让自己的身体吃亏。健健康康一生是人生幸福之本。你一定要加强身体锻炼,增加营养,确保自己身心健康,快快乐乐地生活。

你的优点很多,你特善良,也热心,特清纯,更无邪、你聪明伶俐又好学上进,同时还特别节俭,从不乱花父母一分钱,对物质上要求甚少。我们在你十八岁送的生日礼物一辆甲壳虫汽车,你从不把它开到学校,也不欣喜若狂。更可贵的是你善于思考,是个很有主见的女孩。可你的缺点吗也不少,主要是缺乏自信、内向少言、独行独往、与世无争、淡泊名利、鲜有激情,生性恬静、安逸散漫,常常压抑自己封闭自己,这是老爸最担心的。因为封闭的人往往容易走向偏执走向抑郁。同时你不谙世事,不善与人打交道,不善与人打交道,缺乏生活技能,社会阅历不足,情商远低于智商,今后在社会上会很吃亏的。老爸不要求你成为女强人,老爸只希望你开心快乐地生活。你的一生幸福是我的最大的愿望和指望。记住,长大后的你做任何事情都必须与自己是否幸福相联系,必须与未来前途相联系。

你一定要克服毫无来由的自卑感,这是你人生中碰到的第一个魔咒。

你应当自信,你本就是最棒的。况且至今为止,你都是成功者,并没有经历过失败,你那么棒,那么有才华,为什么你在顺境与成功中还不自信呢?我知道你有一个很大的心病魔,那就是特别害怕失败,也特别不敢面对失败,这让我百思不解。

每次我们听到你说的总是自己这不行那不好,似乎样样不如别人,我们都很焦急,可结果呢基本都是相反的,让我们哭笑不得。你总是不能客观评价自己,要知道自信不是自傲,自信是对自己的一种肯定。只有你自信的时候,你就会对你想做的任何事情说:“行!我能行!”。而当你自卑的时候,面对任何事物,你会说:“不!我不行”。和那些盲目自信者相比,而你本最有资本也最有战果去表现自信的,却在现实中,你莫名地陷入自卑。

高考时,你说考得不好,连答案都不愿对,也不愿估分。(据班主任说你私下估分500分左右,当时老师完全惊呆了,和我当年有一拼)我们看你每晚十一点之前就休息,又是武汉一般学校普通班,就相信你的话,还为你准备了其他出路----出国留学的准备工作,为此花了不少冤枉钱。你甚至连上网查分数的勇气都没有,可结果呢?你考了六百多分,超过学校重点班绝大多数的同学,考进了名校八年制本硕博连读。大一下学期你考英语四级,你也认为没考好,结果是608高分。大二上学期考英语六级,出考扬你就信心不足,打算来年再考。结果呢?考了604分,在班级名到前茅。(我特意随机查阅北大学生六级成绩,查北大准考号11001009220181x前后总共约二十位,结果一个六百分以上,19号为652分,其余均四五百分左右,尚有五个没通过,你不比当年天之骄子状元们差呀)确实你可能是你班唯一一个高中非重点班的学生,但你后劲充足,你虽不像他们那样熬夜学习,但你效率高,这两年来成绩从不输他们,你有理由自信,我们也为你取得的成绩感到骄傲。

退一步说,即使以后你碰到失败,也并不可怕呀。

记住女儿:永远不要怕失败!谁的一生没经历过失败呢?一个人不经历失败、挫折、痛苦、被骗的过程,一生中似乎是不可能的。创伤与打击,失败与欺骗可能是你人生成长的一部分,是你生活经验的积累,是你走向成熟的重要环节。不可设想人一辈子都在鲜花、成功、欢乐、顺境中成长,除非是温室里花朵和自我封闭的妄想狂。

可怕的是意志消沉,可怕的是无法面对生活,只要珍惜生命,善待人生,没有什么坎不能过,没有什么困难不能克服,未来和生命是最美好的!

这是我几十年积累的经验和对生命的理解,还望你能体会和接受。

你要记住,人活着会常有艰辛,也会各种各样的压力和形形色色的挑战,我们无法躲避。今天你已有公民权了,有义务有权利自然有责任,你一定是勇敢地面对生活,不怕苦难,乐观积极,生活一定会是美好的。

未来的人生,你一定要保持一种自信的精神,保持一种快乐的状况,保持一种向上的心态,你的生活才会充满阳光。快乐是人生的动力,自信是智慧的源泉。老爸盼着你身上能出现自信的目光,自信的语言,自信的行为,因为你是最棒的。女儿,你行!

大学是个陶冶人的地方,在这里学到的不仅仅是知识,更多的受到那种环境和学术的熏陶,接受思维和方法的训练、培养完美和健全的人格、造就理想人生和高尚的情操。也就是说在大学里学习的主要是方法和能力。大学将是你人生最重要的时光,也是最美好的时光。

在大学里,你会学会做人的道理,发现学习的真谛,求索科学的真理。

大学强调培养学生的主动学习精神,这种教学模式与你中学时相比差距很大,但大学的学习模式更适宜人的成长。一定要养成主动、自觉、灵活的学习习惯,努力锻炼自己思维能力和表达能力.千万不要急功近利,有些现在看起无用的知识,无聊的话题,说不定未来对你作用甚大。广泛吸取知识养分,成功机会一定是给有准备的人。大学生活要过得丰富多彩,大学生活对每个人的一生都起着不可限量的作用,一定要好好把握。

另外特别要说明的是,英语对你未来很重要,要切记。

但英语学习是一个漫长持久的过程,一刻也不能放松。你应当尽可能用英语写日记,多英语会话,看英文网站和英语电影,持之以恒,这样才有可能精通英语。不会英语,在这样一个知识爆炸、全球化信息化的网络时代,会丧失很多机会!这一点老爸体会很深,如果老爸英语好点,事业会很大,视野会更宽,生活会更富裕。英语不好是老爸一生的遗憾,你一定要向你爷爷学习,他老年才学英语,现在竟然比你在美国工作生活的叔叔的英语单词量还丰富。你一定要把英语的听写读说能力掌握好,你有这个基础也有这个能力,有了英语你就有了一张融入世界的通行证。

你从学校到学校,虽然念大学了,几乎没有什么社会交往经验。目前你能交往的只有同学、同学的朋友、老师和网友。在大学里你一定要多交一些朋友,尤其是大学同学。老爸经验告诉你,大学同学往往是自己一生中最好的朋友。因为在大学里,你和同学能够较长时间的、不带功利色彩的、近距离的、坦诚开心的交往。你们一起学习,一起玩乐,一起成长,一起独立,很自然地你们会产生一种特殊的情谊,你们会成为知己、朋友、战友和死党。你应该在大学生活这段时间内,交往培养一批这样的同学,使他们能成为你的真诚诚恳的知己朋友,别在乎他们的爱好、成绩、外表甚至性格。你中学时朋友不多但你很喜欢,她们都很善良优秀,但她们代替不了大学同学,你要以最大的善意去对人,要宽容,要真诚,要信任他们,大学的友谊是你人生中最宝贵的财富,也是你进入社会的最重要的人脉,是你未来事业成功的最大助推器。你切不可也不要把全部的时间都花在中学同学身上,改变思路多交大学新朋友。你大学八年,有充分时间了解同学,你要逐步改变自我封闭状况,使你自由时间最多的八年学习生涯成为你最美好的回忆。老爸从不怀疑你的智商,但总担心你的情商。你不善交往,也不太愿意与别人打交道,沟通能力不够,沉静有余活泼不足,不善于表现自己,缺乏社团活动的热情,大门不出,朋友不多,典型一个宅女。老爸希望这八年内你能有所改变,虽有江山易改本性难移一说,但老爸见过很多像你一样内向的人改变成开朗、活泼、大胆、活力四射的人,老爸相信你也能。

网友是一个很复杂的群体,面向社会,良莠不齐,好人多坏人也多,尤其是感情骗子甚多。对一个在校念书十分单纯的大学生的你而言,有时是很难分辨,也容易吃亏上当的。你太单纯,太容易相信别人。你没有防人之心,也不知当今社会的险恶,很难不被虚情假意迷惑。网友不是不能交,但最好不见面。既然网络是虚拟的,那就享受虚拟的美感。可以交流,可以倾诉,可以沟通,但不要见面,尤其不要一人孤身去见网友,不要破坏虚拟社会中的游戏规则,以免给自己带来不必要的伤害和麻烦。认真对待自己,学会保护自己。

独立的人格、独立的思想,独立的思考,网友不可能给你未来有大的益处,而大学朋友的人脉关系是你毕业以后最可宝贵的财富。你现在正处于人生的拐弯处,正从单纯走向成熟,从被动走向自主。我们对你有信心,相信你能管好自己,安排好自己的学习和生活。

当然你成年了,你已经有权利选择了,我们只能提供建议,不会替你做主,大事情就要靠你自己拿主意了。今后,交什么样的朋友,找什么样恋人,选什么课题,从事什么工作,一切都会由你自己做主。但我们一定会向你提供一些参考意见,老爸绝不仅仅只为你提供必要的生活、学习条件,一定会以朋友的身份给你分析问题、提供思路,这是天下父母都无法完全洒脱的地方,我们也很难做到。但我们会尽量不干涉你的自由,你的选择,尽量让你承担你应承担的责任,成为一个负责任的合格守法公民。

在大学里,你会面临生活学习爱情等诸多快乐与烦恼,尤其是爱情。青春期太易冲动,青春是性生命的朦胧期,爱情是一种激情,而激情往往带有盲目性质,往往冲破社会传统评价框架,反抗社会固有思维模式,蔑视社会的物质经济本质。所以大多数清纯少女的确很容易的会爱上坏坏的混混,这点应自己多加小心。 不要因为财产去爱一个人,不要因为外貌去爱一个人,不要因为道德的因素去爱一个人,更不能因为为了同情而强迫自己去爱一个人。一个男人最主要是要有责任感,要有正义感,要有上进心,要有才华,要能保证你们可预见的未来生活高于或等同社会的中产阶级水平,要有孝心,要通情达理的,要善于理解人。这样男孩才能成为终身伴侣。

归根到底,也就是说男人的人品与文化素养最重要。

要学会拒绝。爱情不是怜悯,不是施舍物,万万勉强不得。爱情虽是女人生命中很重要的部分,但这肯定不是最重要部分,更不可能是女人的全部。一定要冲破爱情至上主义桎梏,爱情只是生活的一部分。你很可能会失去爱情,但你切不要认为你失去了整个世界。面包会有的,爱情会再来。没什么不可变更,你要勇敢地生活,等待着下次的机缘。对恋爱的态度要尽可能冷静。初期交往时期,感情容易冲动,往往单凭印象,只看得到对方的优点,看不出他身上的缺点,很容易神化对方,一叶遮目,把假象当实情,缺失了正确判断的能力。

一般来说,找男友下列五种人不能找:

1. 有钱无文化的暴发户。2. 有钱有文化但过去生活特苦的人。3. 女人化的男人。4. 有暴力倾向的男人。5. 爱情至上主义的男人。

暴发户一般聪明灵活有胆识.但大多心狠无法无天,好色且无度,很少有人能约束他。在法律灰色地带发财造成其狂妄斗勇的性格,没有情趣没有格调。第二种人由于过去常受轻视,过度自卑,因家境贫穷和长相较差,在爱情上常受打击和羞辱,一旦有钱后,心态大变,总想补回过去损失和报复别人,仿佛地球要毁灭了,性格变态的多。第三类人是小白脸型,长得有模有型,有身材无知识,一般已婚富太太喜欢,吃软饭的多,让人厌恶。第四类人喜欢打女人,这是现代社会最不耻的,是男人无用的代名词,这种男人往往暴力倾向严重,没有安全感。最后要提醒的是那种为爱死去活来,一切以爱情为中心的男人也十分可怕。这种有爱情至上主义男人比较自我,心眼小,最易走极端,好时看似幸福,分时会纠缠不清,要死要活让你鸡犬不定。他可以不顾一切,自杀,尾随,耍赖,很难缠。实质上他不是爱你,是爱他自己。

总的来说,门当户对是有一定道理的。有知识的人找有知识的人容易找到共同点,生活习惯相差不大的不易产生矛盾,有家庭教养的人总容易沟通。千万不要认为纯洁的爱情只能有一次,从十八岁到二十八岁,人的经历不一样,想法也一定不一样,所以选男友的观念也会变,所以说好的爱情永远在下一次。

在正统正规环境下教育出的女孩,最易出现逆反心理,做出一些不可理喻的事情,特别在感情上往往与长辈对着干,正所谓男人不坏女人不爱。一个明显有重大缺陷,没有前途,油嘴滑舌的问题男孩,因为另类,因为酷帅,因为好奇,对乖乖女产生巨大杀伤力。产生爱情至上的迷幻,为了爱情,什么都可以做,什么都不怕,充满一种神圣宗教使命感。以为这就是爱,就是真正的爱,甚至试图用性去吸引你所爱的人,用生命报答你所爱的人,这是最最可怕的。从没经历过爱情的单纯女孩,第一次碰到这类人,最可能神魂颠倒,自愿上当,这是作老爸很担心的地方。

“男怕选错行,女怕嫁错郎”,这很有道理,要学会自我保护。年青人向往爱情无可非议,但要把握时机和度,爱情也可能造成伤害,也有可能给你的今后人生留下阴影,更有可能毁了你的学业和前途。特别是女生往往受到的伤害更多一些。用情越深,伤心伤身越重,处理不好害人害己。无论感情中遇到什么样大的挫折,都要学会冷处理,要善待自己,珍惜生命。要坚强一些,勇敢的去面对,要相信自己,大不了重头再来。所以孩子,无论如何,不管在你人生的什么阶段,你对哪个男孩子产生了怎样情愫,都要先告诉爸爸妈妈,只要你们的感情是向上的,纯洁的,老爸一定支持你。但老爸必须告诉你,恋爱和婚姻有时是很不同的。在恋爱时,由于双方各自独立且激情四溢,很难考虑与双方家庭的关系。恋爱是两个人的事,而婚姻很可能是两个家族的事。婚后婆媳翁婿的关系,代沟的迷合,资助各方亲属困难的方式,都或多或少影响双方的情感。这在中国,在现代,表现尤为明显。爱情是求新求变的,婚姻是求稳惰性的,两者的矛盾是社会性与自然性的矛盾,人有时真的很矛盾。所以你必须了解双方之间的关系,切不可为情冲昏头脑。大学的8年是你还是要以学业为重,要为你自己命运努力拼搏,感情处理不好很费时费神,你必须慎重认真对待。

爸爸是不赞成婚前有性行为的,这对女孩伤害较大,尤其是怀孕流产对女孩心理生理打击都很大。老爸甚至不太赞成你大四前找男朋友,因为即使你上大四,也才二十岁,年龄真的还小,没必要过早陷进你难以控制的感情之中,把精力放在学习上,成熟点再去考虑这人生重要课题才是最佳选择。老爸更希望你多交非情感的男朋友女朋友,好朋友是越多越好。当然老爸也不会坚决反对你找男朋友,但你一定要明白,大学里找的男朋友成功率很低,最后都以分手结局,只是有了一段这方面生活体验,所以老爸坚决反对婚前有性。

在青春冲动时,在一定机会环境下很容易发生这类事。所以要理智,要学会自我保护,要避免创造那样的环境。你想过没有,如果那人不爱你,有了性他就瞧不起你。如果那人爱你,过早有性会让他内心产生误解,以为你是个轻浮之人,也会轻视你。我觉得真正的爱情,男人一定会尊重女性爱护女性,因为爱的最高境界不是占有,而是尊重和爱护。

如果真的发生了,一定要注意安全与避孕,一定要戴安全套。性病现在流行,十分可怕,而流产对女孩身心损害也很大。

所以一旦发生了,特别是怀孕了,一定要告之父母,切不可为经济、害怕和羞愧而遮掩自己,私自跑去小珍所独自处理,害了一生。

怀孕和性病,是两大特别需要强调的后果。知道了这样的后果,你与生俱来的性冲动就会被理性约束一些。因为欢乐后的痛苦代价女孩子承担得多。有性行为,就会怀孕,怀孕,就要堕胎。堕胎不仅会痛苦,而且对身体有害。还有性病,小小年纪,不应承受得了这样的痛苦和伤害. 女性的生理和心理都经受着飞快的成长和变化,所以你应当慎重对待身体发育和情感问题。心理保护是首要的,感情投入要慎重,女人唯有自强、自立,才能把伤害降到最低点。现在,同居已成为一个明显的社会现象,我不希望你选择同居,把可能受到的伤害降到最低,让事情尽可能避免发生,不然,弄不好会影响你的一生。

别给同一个男孩两次伤害你的机会,别相信花前月下的誓言,也绝不忍受男孩的侮辱和怠慢。要保持纯洁。不要招惹别人的男人,不要招惹浪子,不要招惹文艺青年,不要招惹中年男人,不要招惹太清纯的男孩。

不要后悔,后悔于事无补。

要快乐、要开朗、要坚韧。大气一点,豁达一点,一定要牢记生命是最可宝贵的!为了生命,什么代价都可以付出!一切都可以重来,但生命失去就无法再现。不要为爱情做傻事,也不要为后果承担不必要代价,父母总是爱你的,一定要记住,家的大门永远向你敞开。伤了、累了就回家休养调整。父母是你最坚强的后盾和安全可靠的避风港。老爸从来都不怕你失败,就怕你失败了就不能爬起来!老爸从来都不怕你上当受骗,就怕你承受不了上当受骗的痛苦!人生的路太漫长了,老爸陪你走的只能是很短的一小段,而大部分的路要靠你自己去走!老爸能做到的是放开手让你走。毕竟很多事情只有你经历过了才能明白!人一定要想得开,人生难免经历苦痛挣扎,一点感情挫折你都受不了,就认为还不如死了算,这给活的人带来无尽痛苦。一个人只要意志不垮,外力是很难把他击垮的。亲情是支柱,友情是守护,有了坚强的意志,再加上亲友的帮助,人就一定能战胜困难。当然这些都是假设,都是为了防患于未然,相信你会正确对待的。

最后在感情上我忠告你五句话:

一.是你成年了,有公民权了,你必须承担责任也享有你的权利。二.是你会面临生活学习爱情等诸多快乐与烦恼,这就是人生,不可避免。三.学会保护自己,拒绝婚前性行为。同时在青春冲动时一定要注意安全与避孕。四.是一定要牢记生命是最可宝贵的.为了生命什么代价都可以付出。五。是不要过深的陷入处女的情结, 那是对女性的不公。

我不仅是你的老爸,也是你永远忠实的朋友。你有困惑有问题有心事有苦恼,都可以来找老爸。不要有任何顾虑,老爸还是开明的开通的,也一定会和你共同一起找到解决问题的方法。总之老爸是你最可信赖的朋友。

你生活的这个社会有很多问题与缺点,号称共和,实质专制,没有民主,缺乏自由,有政府腐败,有社会不公,有贫富差距,有欺骗讹诈,特别是这个号称工人阶级代表和工农联盟为基础的党政官僚机构,习惯于明里暗里帮助资本家和权贵阶层剥削工人阶级和弱势群体,工会成了资本家的帮凶,司法成了弱势群体的镇压工具。很多青年人因此十分激愤,很是愤青,但我希望你一定要有感恩心态这个社会虽然不理想,但比起中国古代强多了,在程朱理道学家们改造的儒家社会里,女人完全没有地位。比起当今世界伊斯兰教国家也强多了,那里的妇女是从属的,没有最基本的人权。这一点你要感到庆幸,虽比欧美差点,但比上不足比下有余。就是和老爸那个年轻时代比,你的时代也是难得的,民主自由也进步很多。老爸到高中还穿打补丁衣服,大学毕业时才穿上皮鞋,没有书看,没有电影看,吃得也是配给,没有诉讼法甚至实体法也没几部,正如毛泽东评价他创立的当时社会是"秃子打伞无法(发)无天"。我们家虽是世代书香之家,但六二年老爸的爷爷,外公和姑姑仍活活饿死。所以人要知足,一定要对社会有感恩之心,这样你才会真诚回报社会,才能改造社会。

我们这个家是你的码头,是你的港湾,是你的靠山,是你的加油站,也是你的休养所。提高自己的素质,一般情况下,素质高低和生活质量是成正比的。心态要健康,自信要强化!,快乐与自信是人生两大法宝,老爸可以帮助你,但快乐与自信更需要你自己努力才能达到。

相信我,你的未来一定超过你老爸。

杂杂拉拉写这多,说教味很浓,但愿你不烦。

你的老爸

2010.3.6.

外二篇:

别了,小甲

小甲是谁?小甲不是人,小甲也不是宠物,那小甲是个什么东西呢?不错,小甲就是个东西。

小甲是一辆车,一辆米白色轿车,一辆跟随我们十来年,德国大众公司生产的经典款小车----甲壳虫。

当年女儿念大学二年级,刚满十八岁,暑假考取了驾照,我们带她去看车展,她一眼就看中这辆卡通式的小车。在展厅,她眼光始终盯着那台车,挪不动脚步。夫人见此情景,眼眨都没眨,立马掏钱,预订了这款样车,车展一结束,就把这辆车开回了家。

因为这辆车的型号,我们全家就把它宠称为小甲,已区别家里已有的大灰和大白。

女儿非常喜欢这辆小甲,常常变着花样对它进行个性化改造,车外贴着各类卡通动物照,车内摆放各式卡通异型拟人像,整个车就是个卡通世界,引人注目,端是可爱。

虽然刚进大二就买了这辆车,但七年后毕业离校,她一次也没有把车开进校园,同学都不知道她有辆爱车。她仍骑着自行车穿梭在校内校外,购车十一年多,总共才跑三万九千公里,其中一半还是我们贡献的,实在有点对不起这辆小甲。

小甲个头虽小,但很有型。它自重不轻,超过一般轿车,轮胎也宽大,安全感十足。小甲的前排很宽松,操作方便,驾驶平稳,舒适度甚佳。唯一缺陷是动力尚嫌不够,保养维修费相对较高。

我们这款车是经典车型,好多年前就不再生产,是真正的绝版。当听到整个甲壳虫包括新车型也在全球停产后,我们就感到十分失落和遗憾,这是一代车时代结束,无奈而又现实。

小甲最大贡献是在疫情期间,那半年武汉成为全国关注中心。

封城期间,在中心医院工作的女儿,全靠小甲,奔波在医院和住家之间。工作,忘我的工作,尽心的工作,连轴的工作,小甲是做出了很大贡献的。当年在空无一人的武汉街道,总有一辆小甲壳虫车,不时的奔驰在空旷的大街上,保证了女儿的工作、休息和饮食,在那个特殊时段里,小甲功不可没。

小甲虽跑的路程不长,但毕竟有十一年时间了,为了安全起见,我们决定置换更新,虽然依依不舍,但思前思后,最终还是决定卖掉小甲,更换新车。

对于卖掉小甲,女儿是不太同意的,毕竟这是一辆她十分钟情的车型,是跟随她十多年的爱车,是伴随她度过青春岁月的坐骑。她对它感情深厚,那毕竟是她青春的记忆,似乎成了她生命的一部分,所以非常留恋,十分不舍。我们非常理解她的心态,为了让她安心,为了有个留念,夫人请了一个摄影大师为她和爱车拍摄了不少倩影美片。同时,为了减轻她的失落,我们保证,新车一定按她喜欢的新款型购买。

那天与小甲留影拍照,我们选择长江大桥,晴川阁,铁门关和知音琴台艺术中心这几处为背景,表示知音难舍,武汉生活和古今对比之情怀,为小甲作最后一次道别,缅念已逝去的小甲。

再见了,可爱的小甲。

江城记事之四

妻子(外二篇)

妻子今年已四十四岁,但仍漂亮,身材保持的极好,在同龄中显得很突出。

有风度,有气质,有涵养,见过她的人都这么说。

妻子性格内向,不多言辞,不服输,有韧劲,给人以文静稳重的感觉。

妻子不小气,对待钱的问题上,她该细心时很细心,该粗心时也粗心。尤其在对待我家这边时,比较通情达理,表面上也给我留足了面子。在我假装大方时,也不当面扫我的面子,只要是需要,我拿钱回家给我亲属,她也不会不同意。

我们相识相恋,谈了一个抗战,整整八年恋爱才修正果。应该说基础很牢靠的,完全是自由恋爱。结婚后我工资全交。也不过问家里经济状况,当然也不知道家里有多少存款。但我相信妻子,她不会乱用钱,我们俩有一个共同特点,不太计较经济上的得失,也不会胡乱花费。

一

认识妻子是一九八二年,我二十四岁,她二十岁。

当年我们一批刚毕业的大学生,一同分配到三线军工研究所,大家几乎同时来报到,被人事处全部安排在所招待所里,暂时居住。

来所几十个大学生中,女生很少,大约也就五个。妻子给我第一印象很深,两大特点引人注目,一是个子高,1.71米,鹤立鸡群。二是眼睛大,扑闪扑闪的,很是迷人。所以,后来所里请电影制片厂导演来所,拍所况记录片和产品宣传片时,在所内挑选一男一女两个临时演员,客串专家和记者,穿针引线,贯彻这部宣传影片的始终。男士,请了所里一个很有知识分子气质的室主任。女士,导演就选中了妻子。

妻子说,当年第一眼对我印象不佳。

主要是妻子住的房间灯坏了,到我们房间求助,我们房间三个男人都没有帮她,我还说你连灯都不会换吗?她十分地生气。

她说得十分确切,但我完全不记得。我自以为还算热心肠的人,助人为乐品质还是有的,况且是在异性面前表现呢。估计我是没听到,或是忙别的没留意,但妻子坚决认为我们三个男人是有意的,没有男子汉的绅士风度。

我学工,从事飞行器控制研究。妻子学经济管理,从事计划管理工作。我分在研究室,她分在所机关,我们之间业务上基本没有来往。

但我和妻子住处,分在同一山头。她住三区八幢干打垒平房,我住三区九幢干打垒平房,都属“三八”高地区域,几乎是邻居。

近水楼台先得月,同是天涯异乡人,都是单身,自然接触比其他男生方便、自然。

当然我们开始比较密切来往,是源于元旦晚会。

我们单位在山沟里,离城较远,有自己幼儿园、小学、中学、医院、商场,完全封闭,自成体系,与本地单位几乎没有往来。单位原属部队,集体转业后成为中央直属事业单位。军人氛围浓厚,我们到单位时,部队番号武字242部队仍可使用。所里风气纯朴,思想守旧,所青年男女谈恋爱基本上不敢手挽手走路,那会千夫所指,遭人吐弃的。

我们外来学生,受改革开放政策熏陶,自然对这里环境很不习惯,很受压抑,都想离开这个“被阳光遗忘的角落”。

一九八三年元旦快到了,这是我们七七级、七八级两届近百名大学生第一次在异乡他地,在荒山僻野处迎接元旦新年的到来。为了舒展心中郁闷,缓解心理压力,我向大家提议:自己组织,办一次自己的迎新晚会。

我的提议得到大家积极响应,我的妻子也表现出热情和投入。于是,我自然成为这次晚会组织者,大家分工合作,配合默契。有的去物色布置场地,有的上城购买食品水果和彩纸灯笼。我开始写邀请函和新年贺词,很快一切布置妥当。这是一次未经官方许可,大家自发组织的年欢会,我们这些外地人都很倾心地投入。我们经常在一起安排细节,一起发送邀请函,一起畅谈现状和未来。

晚会非常成功,我的贺年词很短,但我读起激昂澎湃。虽然中间有一个所领导赶到现场观察监督,但大家完全无视领导存在,都很兴奋,接原计划进行唱呀,跳呀,疯到午夜。在那里,我第一次邀请妻子跳舞,她没拒绝.虽然我俩都不会跳交谊舞,但跟随年青同事们一起嘿,一起喊。在这里,舞技已经不是很重要了,重在参与,那次我们玩得很尽兴。

我在所里也一举成名。

自从晚会过后,我们接触就比较频繁了,我也常邀她到我住处吃饭。当年我买菜做饭,在所里那是相当有名的。周末我几乎都会去菜市场买一只鸡回来,或红烧或爆炒,妻子是常来尝鲜的。

看着水到渠成,我决定捅破这块窗纸。那是一天晚上,我们结伴从四区办公大楼回宿舍。路上我犹豫来犹豫去,吞吞吐吐,欲言又止,直到走到她的宿舍门前才鼓起勇气胆却地说出:能否做我的女朋友?妻子一惊,没有马上回答,空气顿时凝固,让人喘不过气来。

时钟一分一分的过去,压抑一步一步的加强,比坐牢还受罪,还胆颤心惊,似乎在等待法官判决。

好久好久,妻子婉转拒绝我的要求。

我一时蒙晕,不知妻子几时回房间,我几时走到我的住处门口。

我站在我住处室外,望着满天星星,又是好久好久。

风吹拂着我的脸庞,没给我一丝清凉,平静不了我的情绪,腿在颤抖,全身无力,心脏似乎跳到胸外,大脑一片空白。

那几天,丢魂式的,干不了活,提不了劲,工作中常常出差错,老师常常异样眼神看着我,这小孩怎么呢,中了邪。

于是,我写道:

生活是这样的空虚,

空虚的像梦幻一般,

梦幻中的我,

苦闷而又彷徨。

天色渐渐的暗淡,

暗淡的让人心寒,

生活中的我,

忧愁而又悲伤.

思絮在晚风中飘扬,

飘扬在山脚路傍,

它在询问我,

失恋和情感.

失恋和黑夜相伴,

侵扰在我青春心上,

可恶这黑夜,.

何时才能驱散?

不过四五天,峰回路转,妻子找到我,说经过深思热虑的考虑,同意做我的女朋友。这是什么路数?一下推入冰窟,一下烈日炎炎,又一次把我打的晕头转向,一时结巴无语,呆呆地看着她,会不过神来。

彩虹总在风雨后,我们相恋了。

我们手牵着手,奔向大山,捡着磨菇,寻着竹笋,笑着闹着,累了就倒在山上野草坪地里,一整天就在大山里转,仿佛整个世界都是我们的,无所顾忌。树林里留下我们的足迹,小道上荡漾我们的笑声,我们相爱在改革开放的年代,我们的爱情虽受到封闭世俗的制衡。但我们仍然我行我素,仍然独立超然,公开压马路,大胆向全所宣示。她曾私下激昂地对我说:“对于幸福和爱,我不遗余力大胆抗争,永远追求美好的梦。”她喜欢理化,文静细腻,我爱好文学,性格开朗,我们个性迥然性格相斥,但我们感情却真诚。我们在一起学习,我们在一起研究,我们在一起畅谈,我们发誓相爱一生。

微风吹打着水面,夜色深藏着朦胧,吐不尽的爱恋,诉不尽的情盟。这是恋人的天下啊,一阵阵悄语,一阵阵细声。

当年我们居住的三八高地住宿

二

一九八四年元月我探亲回老家,和妻子约好,过完春节就返回武汉,拜见老丈人丈母娘。

可是刚跨入我家大门,父亲告诉我,母亲倒在手术台前,至今未能康复。可能是胆结石复发,需要进一步检查。望着母亲疼痛削瘦的脸颊,我的兴奋顷刻消散。

大年初二,一个惊雷般噩耗传来,母亲开腹后发现,胃癌晚期,已转移全身,无法动刀,只得关腹。

那年,我二十六岁不到,虽已青年,但无法承受的突如其来的打击,痛苦,悲伤,大哭,仿佛天塌下来了。晚上我给妻子写信,告诉我家现况,表明不能来武汉了。信里也隐约表示,如果她方便,可否来我家看望一下我母亲,给绝症中的母亲带来一丝温暖和慰藉。

很快,我接到妻子电报,她已乘东方红号轮船从武汉赶往芜湖。

我把电报转给病榻中母亲看,母亲十分兴奋,精神大为好转。很迫切地盼望着见到未来儿媳妇,虽然她已起不了身,但仍像过去一样指大家,安排接待。妻的衣、食、住、行,母亲都一一过问,事无巨细,样样过目,由她做主定夺。

我和同学杨国民一起去芜湖码头接她,那天天很冷,江面风也大,妻子瘦细的身子迎着风,拎着包从船上到码头走来。头发有点散乱,发丝常吹在脸上,我赶紧奔过去,给她披上一件军大衣,帮她拎着包走向公汽。军大衣是母亲再三叮嘱带的,母亲怕她受不了寒冷,还要求家人在房间里升起木炭炉火。

母亲第一次见到妻子,很是投缘,有说不完的话,没有陌生感。母亲兴高采烈,招呼妻子,招呼看望她的朋友,脸上红润,精神气足。妻子到来,让母亲病房有了生气,有了快乐,有了久违的笑语。

当母亲得知二月十六日是妻子生日时,执拗地下床,一定要亲自操办。没办法,我们答应母亲,在她病房给妻子举行一个隆重的生日Party。于是我们买了彩纸灯笼装点病房,订了蛋糕,买了蜡烛,拿来桌子椅子,请来许多朋友,和母亲一起为妻子过一个特别的生日晚会。当妻子吹灭蛋糕上的蜡烛时,母亲兴奋地和大家一起唱起生日歌,祝愿妻子生日快乐。

我很感谢妻子,在母亲人生最后一段路途中,细心暖心爱心地陪伴母亲,给母亲带来久违的欢笑,给大家带来灿烂的阳光。从这一刻,我就认定她是我一生的伴侣。

妻子假期有限,很快她就必须回单位上班。临走那天,妻子和母亲告别,宽慰地对母亲说:明年一定再来看望她,并祝愿她早日康复。母亲没说什么,估计她知道自己情况,只是不愿挑明,给大家徒增悲伤。母亲和妻子拥抱许久,依依不舍,还笑着对妻子说,来年再见。

旁边的我,此情此景,忍不住暗暗落泪。

三

妻子很聪明,脑子灵光,条理清晰,虽是学管理出身,但很用心,自学计算机课程,常去计算机研究室上机,向老师请教,渐渐成了计算机方面专家,许多同时代学该专业的名牌大学毕业生也远不如她。后来调动工作,全凭这项本事。

不过在所里,她在计划处是从事计划管理工作,而且每年都会派她进高校进修学习。1985年她被派到西安西北工业大学学习现代企业管理三个月,在她学习快完结时,我正好也要去西安出差,我与她相约,一同去爬华山。

华山的险,那是名气很大的。我一直很想去探险赏景。能和妻子一起去,那是多么一件令人浪漫快乐的事情。

我一到西安就给她打电话,恰逢她母亲也来西安出差,于是在古都,毛脚女婿拜见丈母娘,虽不正式,但却很自然,不需要那么多繁琐礼节。

随后我们买了第二天西安到华山的火车站,火车下午到华山站。为了赶到山顶看日出,我们立即背起背包出发。从华山站到华山脚下有很长一段路,走起来也不轻松。当时年轻气盛,到了山脚下,没有休整,直接向山顶奔发。

爬山是个力气活,爬华山更是个力气活。

不多久,妻子腿有点不听使唤了,我把行李全背上,让她减轻负担。快到山顶时,我也快筋疲力尽,左右前后都看不到人,天也快黑了,我们相互搀扶着,向山顶小旅馆进发。终于走到小旅馆,已经耗尽了力气,全身除了耳朵不疼,其他地方都酸疼。小旅馆环境太差,没有水,有一个共公卫生间,被子从来没洗过,估计前面来的人嫌脏,鞋也都不脱,就上床休息,床上、被里全是泥土。可当时我们已累的毫无力气,下山是不可能。夜里,山顶上风很大,天气很冷,我们只能在这独此一家的旅店住下。房间里虽不卫生,但能避风挡寒,我们不敢完全躺下,在各自房间(没有结婚证必须开两房)迷迷糊糊熬到天亮前起床,又爬到观景台看日出。